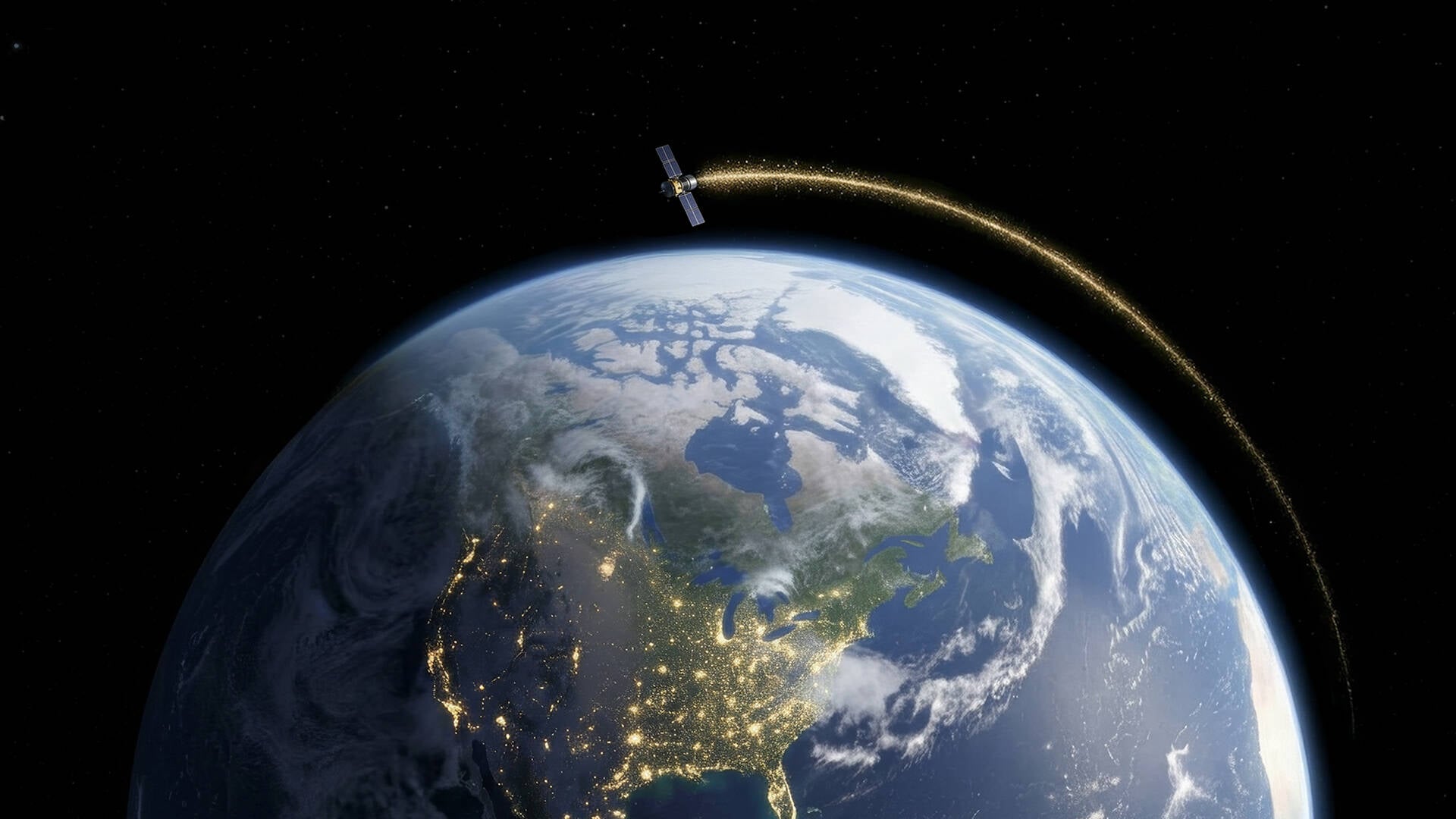

NVIDIA DRIVE Hyperion: i costruttori auto asiatici puntano sull'AI

BYD, Geely, Nissan e Isuzu adottano NVIDIA DRIVE Hyperion per lo sviluppo di veicoli autonomi di livello 4. La piattaforma di NVIDIA si sta affermando come infrastruttura standard nel mercato APAC, offrendo un'architettura di riferimento completa per...