Agenti AI su GitHub: una nuova minaccia per le credenziali

Una recente scoperta da parte di ricercatori di sicurezza ha messo in luce una significativa vulnerabilità che interessa gli agenti AI integrati con GitHub Actions. Attraverso un nuovo tipo di attacco di prompt injection, è stato possibile compromettere tre popolari agenti, riuscendo a sottrarre chiavi API e token di accesso. Questa rivelazione solleva serie preoccupazioni riguardo la sicurezza delle pipeline di sviluppo e l'integrità dei dati aziendali.

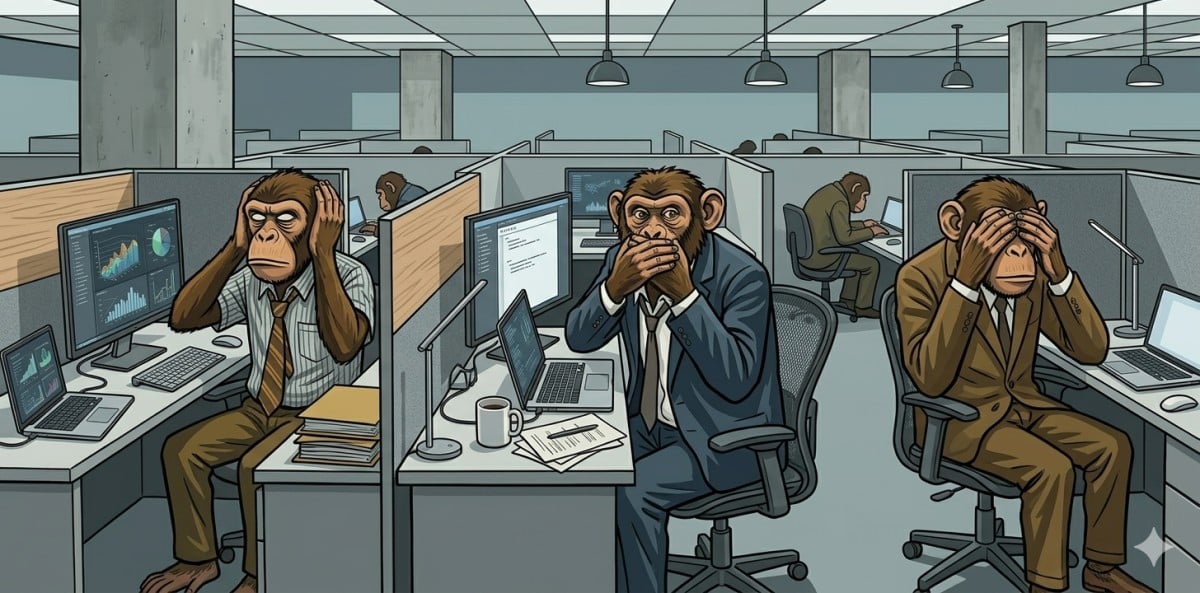

Il problema è aggravato dal fatto che i fornitori di questi agenti, tra cui colossi del settore come Anthropic, Google e Microsoft, non avrebbero ancora divulgato la problematica ai propri utenti. Tale omissione può esporre le organizzazioni a rischi inattesi, compromettendo la fiducia e la trasparenza necessarie nell'adozione di tecnicie basate su Large Language Models (LLM). I ricercatori, che hanno ricevuto ricompense per le loro scoperte, avvertono che la natura della vulnerabilità suggerisce una pervasività ben più ampia di quanto si possa immaginare.

La minaccia del Prompt Injection negli agenti intelligenti

Il prompt injection è una tecnica di attacco che manipola l'input fornito a un LLM per indurlo a eseguire azioni non previste o a rivelare informazioni sensibili. Nel contesto degli agenti AI, che sono progettati per interagire con altri sistemi e automatizzare compiti, questa vulnerabilità assume una gravità particolare. Un agente compromesso può essere ingannato per eseguire comandi arbitrari, accedere a risorse protette o, come dimostrato in questo caso, rubare credenziali di accesso.

Gli agenti AI che si integrano con piattaforme come GitHub Actions hanno spesso permessi elevati per interagire con repository, pipeline di CI/CD e altri servizi. Se un attacco di prompt injection riesce a indurre l'agente a esporre o utilizzare in modo improprio le chiavi API o i token di accesso, le conseguenze possono essere devastanti. Questo tipo di attacco evidenzia una lacuna nella progettazione della sicurezza degli agenti, dove la fiducia nell'input dell'utente (o dell'LLM stesso) non è sufficientemente mitigata.

Implicazioni per la sovranità dei dati e la trasparenza dei vendor

La mancata divulgazione di una vulnerabilità così critica da parte di fornitori di servizi ampiamente utilizzati è un campanello d'allarme per le aziende che dipendono da queste tecnicie. La sovranità dei dati e la compliance normativa richiedono una gestione rigorosa della sicurezza e una trasparenza totale sulle potenziali minacce. Le organizzazioni devono essere consapevoli dei rischi associati all'uso di agenti AI, specialmente quando questi operano con credenziali privilegiate.

Per le aziende che valutano il deployment di LLM in ambienti self-hosted o air-gapped, questa scoperta rafforza l'importanza di un controllo granulare sull'infrastruttura e sui modelli. Anche in un contesto on-premise, la protezione da attacchi di prompt injection e la gestione sicura delle credenziali rimangono sfide cruciali. AI-RADAR, ad esempio, offre framework analitici su /llm-onpremise per valutare i trade-off tra sicurezza, controllo e TCO, sottolineando come la robustezza delle misure di sicurezza sia un fattore determinante, indipendentemente dal modello di deployment.

Verso una maggiore resilienza nella sicurezza degli LLM

La ricerca sulla sicurezza degli LLM è in continua evoluzione, e attacchi come il prompt injection sono solo una delle molteplici sfide che il settore deve affrontare. La scoperta di queste vulnerabilità sottolinea la necessità di un approccio proattivo alla sicurezza, che includa non solo la protezione perimetrale, ma anche la validazione rigorosa degli input e degli output degli LLM.

È fondamentale che i fornitori di tecnicia adottino politiche di divulgazione responsabile e collaborino con la comunità di ricerca per identificare e mitigare le minacce. Le aziende, d'altra parte, devono implementare strategie di sicurezza multi-livello, monitorare costantemente le proprie pipeline e formare il personale sui rischi emergenti. Solo attraverso una vigilanza costante e un impegno congiunto sarà possibile costruire un ecosistema AI più sicuro e resiliente.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!