Un incontro strategico per l'AI di frontiera

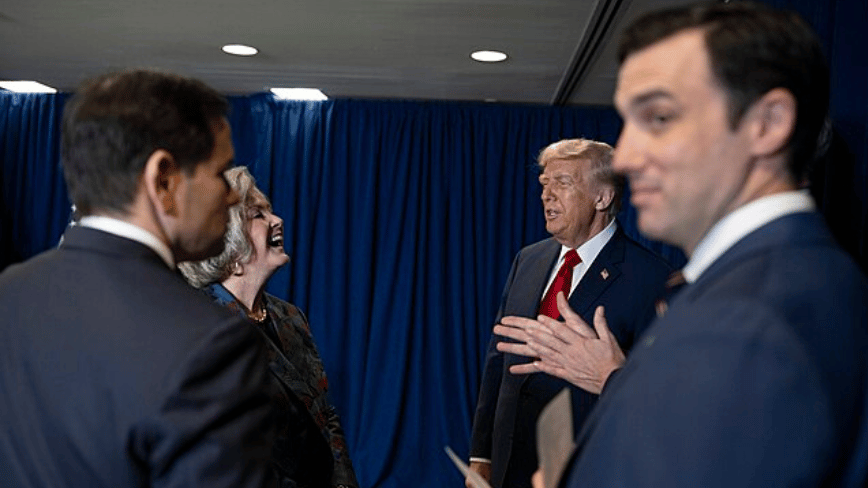

Il CEO di Anthropic, Dario Amodei, ha recentemente incontrato figure chiave dell'amministrazione statunitense: Susie Wiles, Capo di Gabinetto della Casa Bianca, e Scott Bessent, Segretario al Tesoro. L'incontro, avvenuto venerdì, si è concentrato sull'accesso a Mythos, un Large Language Model (LLM) di frontiera sviluppato da Anthropic. La Casa Bianca ha descritto i colloqui come "produttivi e costruttivi", segnalando un potenziale sblocco in una situazione di stallo che circonda questo potente strumento di intelligenza artificiale.

Mythos si distingue per la sua straordinaria capacità di identificare migliaia di vulnerabilità zero-day, rendendolo un asset di rilevanza strategica per la sicurezza informatica. La discussione a livello governativo sottolinea la crescente consapevolezza dell'impatto che gli LLM avanzati possono avere su settori critici, dalla difesa alla protezione delle infrastrutture nazionali. L'interesse delle istituzioni per modelli con tali capacità evidenzia la necessità di bilanciare innovazione tecnicica e controllo strategico.

Il potenziale di Mythos e le implicazioni per la sicurezza

Le vulnerabilità zero-day rappresentano una delle minacce più insidiose nel panorama della cybersecurity. Si tratta di difetti software sconosciuti agli sviluppatori e, di conseguenza, privi di patch di sicurezza. La loro scoperta e sfruttamento può portare a violazioni di dati su larga scala, interruzioni di servizi critici e danni significativi. Un LLM come Mythos, in grado di individuare migliaia di queste vulnerabilità, potrebbe rivoluzionare l'approccio alla sicurezza informatica, offrendo strumenti proattivi per identificare e mitigare i rischi prima che vengano sfruttati da attori malevoli.

Tuttavia, un tale potere comporta anche notevoli sfide. L'accesso e il controllo di un modello con queste capacità diventano questioni di sicurezza nazionale. La gestione di un LLM che può scovare punti deboli in sistemi informatici critici richiede un ambiente estremamente controllato e sicuro, dove la sovranità dei dati e la compliance normativa siano garantite. Questo scenario solleva interrogativi fondamentali sulle modalità di deployment e sull'infrastruttura necessaria per ospitare e operare tali tecnicie.

Sovranità dei dati e deployment on-premise

La discussione sull'accesso a Mythos evidenzia l'importanza cruciale del controllo sui modelli AI, specialmente quelli con implicazioni per la sicurezza. Per organizzazioni governative o aziende che gestiscono dati sensibili, la scelta tra deployment cloud e on-premise assume un peso significativo. Un deployment self-hosted o in un ambiente air-gapped offre un livello di controllo e sicurezza che spesso non è replicabile nel cloud pubblico. Questo approccio garantisce la piena sovranità dei dati, permettendo alle entità di mantenere i propri modelli e i dati di training e inference all'interno dei propri confini fisici e giurisdizionali.

Le considerazioni sul Total Cost of Ownership (TCO) giocano un ruolo fondamentale in queste decisioni. Sebbene l'investimento iniziale per l'hardware (GPU, VRAM, storage) e l'infrastruttura possa essere elevato, i costi operativi a lungo termine e la capacità di personalizzare l'ambiente per specifiche esigenze di sicurezza e performance possono rendere il deployment on-premise una scelta economicamente vantaggiosa e strategicamente superiore. Per chi valuta le diverse opzioni di deployment on-premise per LLM, AI-RADAR offre framework analitici e approfondimenti sui trade-off tra costi, performance e sicurezza, disponibili nella sezione /llm-onpremise.

Prospettive future e trade-off tecnicici

L'incontro tra Anthropic e la Casa Bianca segna un passo importante verso la definizione delle modalità di collaborazione tra il settore privato e le istituzioni governative nell'ambito dell'intelligenza artificiale avanzata. La gestione di modelli come Mythos richiederà un delicato equilibrio tra la promozione dell'innovazione e la garanzia di un utilizzo responsabile e sicuro. I trade-off tecnicici saranno costanti: bilanciare la necessità di performance elevate (misurate in throughput di token o bassa latency) con i requisiti di sicurezza, la capacità della VRAM delle GPU e i costi energetici.

La strada per l'integrazione di LLM di frontiera in contesti critici è complessa, ma il dialogo avviato tra Anthropic e l'amministrazione statunitense suggerisce una volontà comune di affrontare queste sfide. Le decisioni future sul deployment, l'accesso e la governance di Mythos non solo influenzeranno la sicurezza informatica, ma stabiliranno anche precedenti importanti per l'intero ecosistema dell'AI, sottolineando l'importanza di un approccio ponderato e basato sui vincoli reali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!