ASML rivede al rialzo le stime di fatturato 2026: l'AI motore della domanda

ASML, attore fondamentale nella catena di approvvigionamento globale dei semiconduttori, ha annunciato un significativo aumento delle proprie previsioni di fatturato per il 2026. Questa revisione al rialzo è una chiara indicazione della crescente e inarrestabile domanda di chip, un fenomeno trainato in larga parte dall'esplosione dell'intelligenza artificiale e, in particolare, dallo sviluppo e dal deployment dei Large Language Models (LLM).

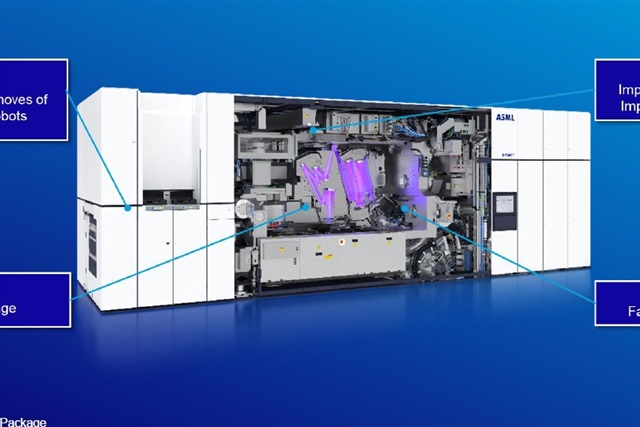

L'azienda olandese, leader nella produzione di sistemi di litografia avanzata, si trova al centro di un ecosistema dove ogni incremento nella produzione di chip ad alte prestazioni dipende direttamente dalle sue tecnicie. La decisione di alzare le previsioni riflette non solo una fiducia nel proprio posizionamento di mercato, ma anche la consapevolezza che l'attuale offerta di semiconduttori fatica a tenere il passo con una domanda che i suoi stessi clienti, i maggiori produttori di chip, stanno sperimentando in modo acuto.

La pressione della domanda AI sulla filiera dei semiconduttori

L'intelligenza artificiale, e in particolare i carichi di lavoro legati agli LLM, richiede una potenza di calcolo senza precedenti. Questo si traduce in una richiesta massiccia di GPU e acceleratori AI specializzati, caratterizzati da elevate quantità di VRAM e capacità di elaborazione parallela. La produzione di questi chip avanzati dipende da processi litografici estremamente complessi, dove le macchine di ASML giocano un ruolo insostituibile.

La domanda per questi componenti non si limita solo al training di modelli su larga scala, ma si estende anche all'inference, che richiede hardware efficiente per gestire milioni di query in tempo reale. Questa pressione si propaga lungo tutta la filiera, dai produttori di wafer ai fornitori di apparecchiature, creando colli di bottiglia e tempi di consegna prolungati che impattano l'intero settore tecnicico.

Implicazioni per i deployment on-premise e il TCO

Per le organizzazioni che valutano il deployment di LLM on-premise, la situazione attuale del mercato dei chip ha implicazioni dirette e significative. La scarsità di hardware AI di ultima generazione, come le GPU ad alta memoria, può comportare tempi di attesa prolungati e costi di acquisizione (CapEx) notevolmente più elevati. Questo impatta direttamente il Total Cost of Ownership (TCO) di una soluzione self-hosted, rendendo la pianificazione infrastrutturale ancora più complessa.

La scelta tra un'infrastruttura cloud e una on-premise, già ricca di trade-off legati a sovranità dei dati, compliance e controllo, diventa ancora più critica in un contesto di offerta limitata. Le aziende devono bilanciare la necessità di controllo e sicurezza con la disponibilità e il costo dell'hardware, considerando attentamente i tempi di ammortamento e la scalabilità futura. Per chi valuta deployment on-premise, esistono trade-off complessi che AI-RADAR analizza in dettaglio sui suoi framework analitici disponibili su /llm-onpremise.

Uno sguardo al futuro della supply chain AI

L'aumento delle previsioni di ASML è un barometro della fiducia del settore nell'espansione continua dell'AI, ma sottolinea anche la fragilità di una supply chain globale sotto stress. La capacità di soddisfare la domanda futura di chip AI dipenderà non solo dall'innovazione tecnicica, ma anche dalla capacità di aumentare la produzione su larga scala, un processo che richiede investimenti massicci e anni per essere realizzato.

Le decisioni strategiche prese oggi dai produttori di chip e dai loro fornitori come ASML determineranno la velocità e l'efficienza con cui le aziende potranno implementare le loro strategie AI nei prossimi anni. La gestione proattiva della supply chain e la diversificazione delle opzioni di deployment diventeranno fattori critici per il successo delle iniziative basate su LLM e altre applicazioni di intelligenza artificiale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!