La Crescita di ASPEED Trainata dai Server AI

ASPEED, un attore chiave nel settore dei semiconduttori, sta registrando una crescita sostenuta, un trend direttamente collegato all'impennata della domanda di server dedicati all'intelligenza artificiale. Questo scenario non solo consolida la posizione dell'azienda, ma rafforza anche le prospettive di mercato per i Baseboard Management Controller (BMC), componenti fondamentali per la gestione dell'infrastruttura IT moderna. L'espansione del mercato dei server AI segnala una chiara direzione verso l'adozione diffusa di carichi di lavoro complessi, che richiedono soluzioni hardware e di gestione sempre più robuste e affidabili.

La crescente adozione di Large Language Models (LLM) e altre applicazioni di intelligenza artificiale da parte delle aziende sta spingendo la necessità di infrastrutture capaci di supportare training e inference su larga scala. Questo si traduce in un aumento della richiesta di server ad alte prestazioni, spesso equipaggiati con GPU specializzate e sistemi di gestione avanzati. In questo contesto, la capacità di monitorare, controllare e diagnosticare l'hardware in modo efficiente diventa un fattore critico per garantire l'operatività e ottimizzare le risorse.

Il Ruolo Cruciale dei BMC nell'Ecosistema AI

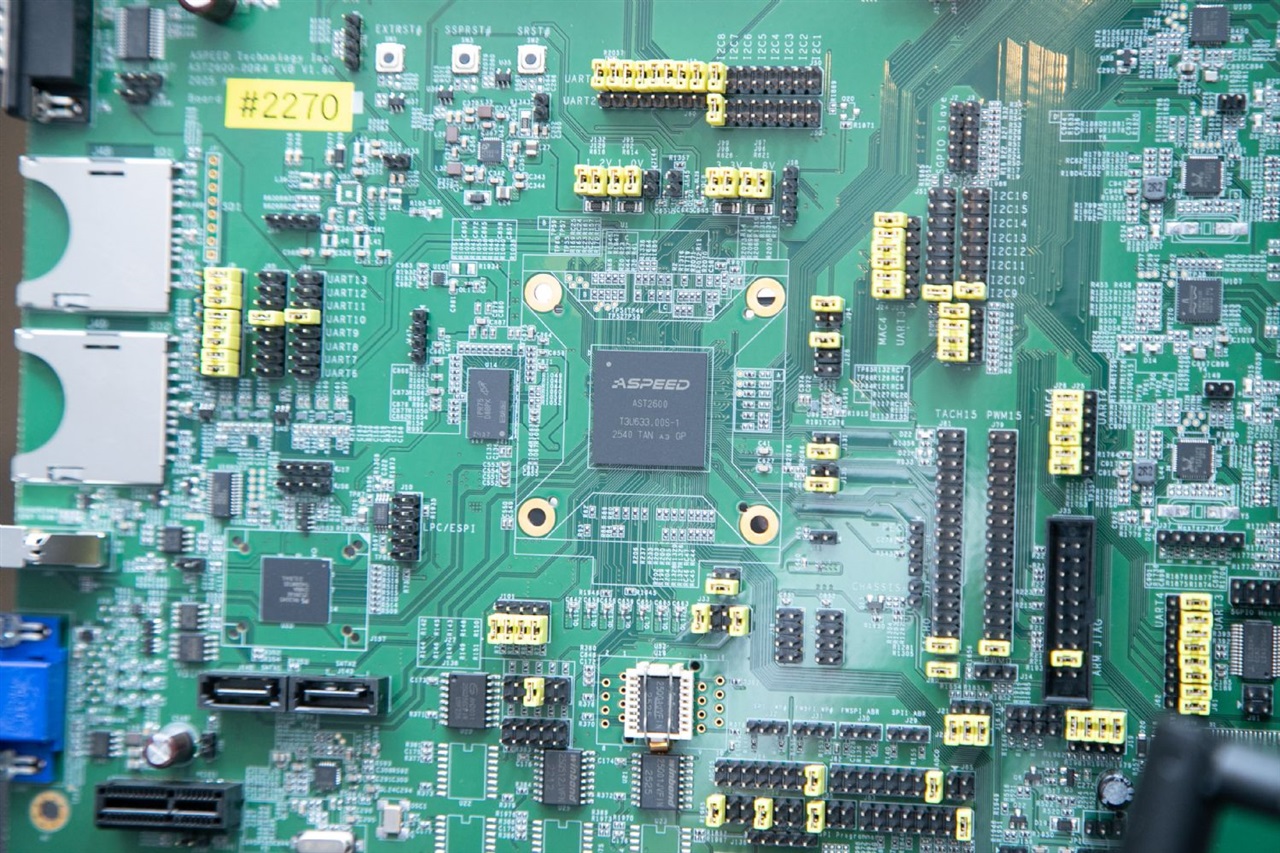

I Baseboard Management Controller (BMC) sono microcontrollori integrati nelle schede madri dei server, responsabili della gestione remota e del monitoraggio dell'hardware. Le loro funzioni includono il controllo dell'alimentazione, il monitoraggio della temperatura, la gestione della ventola, la diagnostica degli errori e l'accesso remoto al sistema operativo, anche quando il server principale è spento o non risponde. In un'infrastruttura AI, dove i server operano spesso sotto carichi intensi e continui, l'affidabilità e la capacità di gestione remota offerte dai BMC sono indispensabili.

Per i data center e gli ambienti di calcolo ad alte prestazioni, i BMC consentono agli amministratori di sistema di mantenere l'operatività con interventi minimi in loco. Questo è particolarmente vantaggioso per i deployment su larga scala o per le installazioni in località remote. La loro importanza è amplificata dalla complessità dei server AI, che integrano un numero elevato di componenti ad alta potenza e generano calore significativo, rendendo il monitoraggio costante e la gestione termica funzioni vitali per prevenire guasti e prolungare la vita utile dell'hardware.

Implicazioni per i Deployment On-Premise

La spinta verso i server AI e l'importanza dei BMC hanno ripercussioni significative per le organizzazioni che scelgono strategie di deployment on-premise o self-hosted. Optare per un'infrastruttura locale offre vantaggi in termini di sovranità dei dati, sicurezza e controllo diretto sull'ambiente operativo, aspetti cruciali per settori regolamentati o per aziende con esigenze specifiche di compliance. Tuttavia, la gestione di queste infrastrutture richiede strumenti e competenze adeguate, e i BMC rappresentano una colonna portante di questa capacità di gestione.

Per chi valuta deployment on-premise, esistono trade-off significativi tra costi iniziali (CapEx), scalabilità e controllo operativo. Un'infrastruttura self-hosted ben gestita, supportata da BMC robusti, può offrire un Total Cost of Ownership (TCO) competitivo nel lungo termine, riducendo la dipendenza da servizi cloud esterni e garantendo ambienti air-gapped se necessario. AI-RADAR offre framework analitici su /llm-onpremise per approfondire queste valutazioni e aiutare le aziende a navigare le complessità delle decisioni di deployment.

Prospettive Future e Sfide Tecnologiche

Il mercato dei server AI è destinato a un'ulteriore espansione, guidato dall'innovazione continua nei modelli di intelligenza artificiale e dalla loro integrazione in un numero crescente di settori. Questa crescita comporterà una domanda persistente di hardware specializzato e di soluzioni di gestione avanzate. Aziende come ASPEED, che forniscono componenti critici come i BMC, si trovano in una posizione strategica per beneficiare di questa tendenza.

Le sfide future includono la gestione della crescente densità di calcolo, l'ottimizzazione del consumo energetico e la necessità di garantire la massima affidabilità in ambienti sempre più complessi. L'evoluzione dei BMC dovrà tenere il passo con queste esigenze, offrendo funzionalità più sofisticate per il monitoraggio predittivo, la sicurezza e l'automazione. La capacità di fornire un'infrastruttura AI resiliente e gestibile sarà un fattore determinante per il successo delle strategie di intelligenza artificiale a livello aziendale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!