Auras e le modifiche al progetto Nvidia Vera Rubin: un segnale di resilienza

Auras, un attore chiave nella catena di fornitura tecnicica, ha recentemente comunicato che le modifiche apportate al progetto Nvidia Vera Rubin non avranno ripercussioni sulle sue operazioni. Questa dichiarazione arriva in un momento di forte crescita per l'azienda, che ha registrato un significativo incremento sia nei ricavi che nei profitti. La notizia, riportata da DIGITIMES, offre uno spaccato interessante sulla dinamica delle supply chain nel settore dell'hardware dedicato all'intelligenza artificiale.

Il contesto è quello di un'industria in rapida evoluzione, dove la disponibilità e la stabilità dei componenti sono fattori critici. Per le aziende che pianificano deployment di Large Language Models (LLM) e altri carichi di lavoro AI on-premise, la certezza nella fornitura di hardware è fondamentale per garantire la continuità operativa e la prevedibilità dei costi.

Il significato delle modifiche e le implicazioni tecniche

Sebbene i dettagli specifici delle modifiche al "gold-plating" del progetto Nvidia Vera Rubin non siano stati divulgati, è possibile contestualizzare il loro potenziale impatto. Nel settore dell'elettronica ad alte prestazioni, il "gold-plating" si riferisce all'applicazione di uno strato d'oro su contatti elettrici o schede a circuito stampato per migliorare la conduttività, la resistenza alla corrosione e la durabilità. Una modifica in questo processo potrebbe indicare diverse strategie: ottimizzazione dei costi, miglioramento della disponibilità dei materiali, o persino un'evoluzione nel design per performance specifiche.

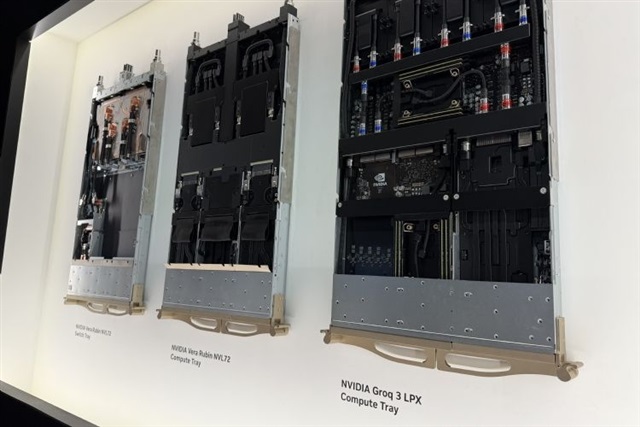

Nvidia Vera Rubin, pur non essendo ancora una piattaforma ufficialmente annunciata con questo nome per il pubblico, si inserisce probabilmente nella roadmap di sviluppo di architetture GPU e piattaforme di calcolo ad alte prestazioni. Queste architetture sono il cuore pulsante dei sistemi di inference e training per LLM, richiedendo componenti di altissima qualità e precisione. La capacità di Auras di assorbire tali cambiamenti senza interruzioni operative sottolinea una robusta gestione della supply chain e una flessibilità produttiva essenziali in un mercato così dinamico.

Resilienza operativa e impatto sul TCO per i deployment on-premise

La fiducia espressa da Auras riguardo alla continuità delle proprie operazioni, nonostante le modifiche di Nvidia, è un segnale rassicurante per l'intero ecosistema. Per le organizzazioni che investono in infrastrutture AI self-hosted, la stabilità della supply chain hardware è direttamente correlata al Total Cost of Ownership (TCO). Interruzioni o ritardi nella fornitura di componenti critici possono infatti generare costi aggiuntivi significativi, sia in termini di CapEx che di OpEx, a causa di tempi di inattività o della necessità di reperire alternative più costose.

L'aumento di ricavi e profitti di Auras riflette la forte domanda di componenti e servizi legati all'infrastruttura AI. Questo trend è guidato dalla crescente adozione di soluzioni AI in vari settori, spingendo le aziende a valutare attentamente le opzioni di deployment, tra cui quelle on-premise, per ragioni di sovranità dei dati, compliance e controllo diretto sulle risorse computazionali.

Prospettive per l'ecosistema AI e le decisioni di deployment

L'episodio che coinvolge Auras e Nvidia Vera Rubin evidenzia l'importanza di partner affidabili e di supply chain resilienti per chiunque stia pianificando o espandendo la propria infrastruttura AI. La capacità di un fornitore di componenti di adattarsi a cambiamenti tecnici senza impattare la produzione è un indicatore chiave della sua affidabilità a lungo termine.

Per i CTO, i responsabili DevOps e gli architetti infrastrutturali che valutano le alternative self-hosted rispetto alle soluzioni cloud per i carichi di lavoro AI/LLM, la stabilità della catena di approvvigionamento hardware è un fattore determinante. AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra diverse strategie di deployment, considerando aspetti come il TCO, la sovranità dei dati e le specifiche hardware concrete. L'evoluzione continua del panorama hardware AI richiede un'attenta pianificazione e una comprensione approfondita delle dinamiche di mercato e di fornitura.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!