Coinbase: una settimana tra tagli, perdite e un blackout infrastrutturale

Coinbase ha attraversato una delle settimane più complesse della sua storia recente, segnata da decisioni aziendali significative e da un'interruzione operativa imprevista. L'azienda ha annunciato il taglio di 700 posti di lavoro, una mossa che riflette le attuali dinamiche del mercato e le strategie di ottimizzazione interna. A ciò si è aggiunta la comunicazione di una perdita trimestrale di 394 milioni di dollari, un dato che ha evidenziato le sfide finanziarie che l'exchange sta affrontando.

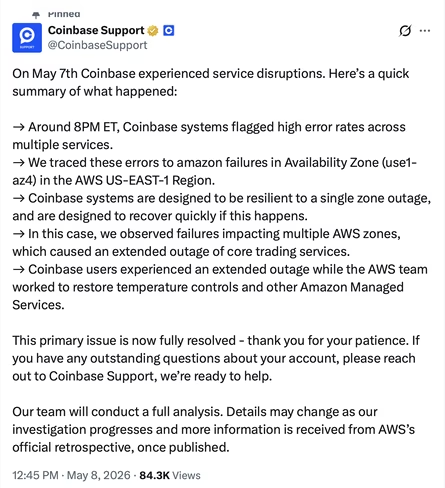

Il culmine di questa serie di eventi si è verificato con un blackout di sette ore che ha colpito la piattaforma. Questo incidente ha messo in luce la vulnerabilità delle infrastrutture critiche, anche per operatori di primo piano nel settore delle criptovalute. La concomitanza di questi fattori ha generato un framework di incertezza, sollevando interrogativi sulla resilienza operativa e sulla strategia a lungo termine dell'azienda in un contesto di mercato volatile.

L'incidente del data center: un monito sull'affidabilità

L'interruzione del servizio di Coinbase è stata direttamente attribuita al surriscaldamento di un data center situato in Virginia. Questo evento ha causato un'indisponibilità prolungata della piattaforma, impedendo agli utenti di accedere ai propri asset e di effettuare transazioni per un periodo significativo. Un surriscaldamento in un data center può derivare da molteplici fattori, inclusi malfunzionamenti dei sistemi di raffreddamento, sovraccarichi energetici o guasti hardware, tutti elementi che possono compromettere gravemente la stabilità di un'infrastruttura.

L'episodio sottolinea l'importanza cruciale di una gestione robusta dell'infrastruttura fisica. Indipendentemente dal fatto che un'azienda opti per un deployment self-hosted o si affidi a fornitori di servizi cloud, la resilienza dei data center rimane un pilastro fondamentale. Per le organizzazioni che stanno esplorando l'integrazione di Large Language Models (LLM) e altre soluzioni di intelligenza artificiale, la stabilità dell'ambiente operativo è un prerequisito indispensabile per garantire l'affidabilità e la continuità dei servizi basati su AI.

Implicazioni per le strategie di deployment AI

L'incidente di Coinbase offre uno spunto di riflessione per CTO, DevOps lead e architetti infrastrutturali che stanno valutando le proprie strategie di deployment per carichi di lavoro AI/LLM. La stessa Coinbase aveva precedentemente comunicato ai propri ingegneri il potenziale dell'intelligenza artificiale di accelerare processi che richiederebbero settimane, riducendoli a pochi giorni. Questa dichiarazione contrasta nettamente con la realtà di un'interruzione causata da un problema infrastrutturale di base.

Questo scenario evidenzia che, per quanto avanzate possano essere le capacità degli LLM e degli stack locali, il loro funzionamento dipende intrinsecamente dalla solidità dell'infrastruttura sottostante. Le decisioni relative al deployment, che si tratti di soluzioni on-premise, ibride o basate su cloud, devono sempre considerare la resilienza fisica, la ridondanza e i piani di disaster recovery. Il Total Cost of Ownership (TCO) di una soluzione AI non si limita ai costi di hardware e software, ma include anche i potenziali costi derivanti da interruzioni, perdita di reputazione e mancate opportunità. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare trade-off complessi tra controllo, sovranità dei dati e costi operativi.

Lezioni per la resilienza operativa nell'era dell'AI

La settimana turbolenta di Coinbase serve da promemoria che, anche nell'era dell'intelligenza artificiale e dell'automazione avanzata, le fondamenta fisiche dell'infrastruttura tecnicica rimangono insostituibili. La capacità di un'azienda di sfruttare appieno il potenziale degli LLM e di altre tecnicie AI è direttamente proporzionale alla robustezza e all'affidabilità del suo ambiente operativo.

Per i decision-maker tecnici, è fondamentale adottare un approccio olistico alla pianificazione infrastrutturale. Ciò include non solo la selezione delle GPU e la configurazione dei cluster per l'inference e il training, ma anche la garanzia che i data center siano dotati di sistemi di raffreddamento adeguati, alimentazione ridondante e protocolli di sicurezza rigorosi. Solo così le promesse di efficienza e innovazione offerte dall'AI potranno tradursi in benefici concreti e sostenibili, senza essere vanificate da guasti prevedibili a livello infrastrutturale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!