Il Richiamo dell'Indipendenza: Una Lezione Trasversale

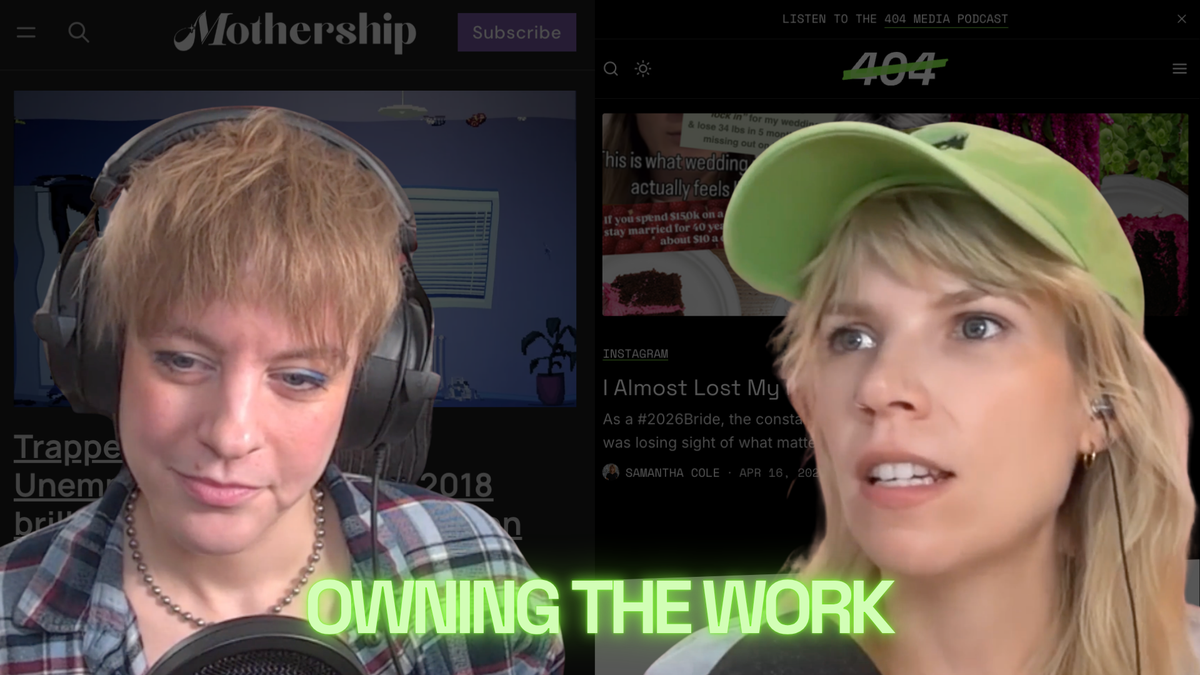

Nel panorama mediatico contemporaneo, l'emergere di iniziative indipendenti rappresenta una tendenza significativa, spinta dal desiderio di maggiore autonomia e controllo editoriale. Un esempio lampante è quello di Maddy Myers, caporedattrice di Mothership, una pubblicazione indipendente che ha co-fondato a gennaio con Zoë Hannah. Mothership si distingue per il suo focus su genere e videogiochi, ed è gestita da donne e persone queer, riflettendo una chiara visione editoriale e un impegno verso l'indipendenza.

La storia di Myers, che ha ripercorso le sue prime esperienze nel giornalismo videoludico fino alla decisione di avviare la propria piattaforma, evidenzia un tema cruciale: l'importanza di "possedere il proprio lavoro". Questo desiderio di autonomia e controllo, sebbene espresso nel contesto del giornalismo, risuona profondamente con le sfide che le aziende affrontano nel panorama tecnicico odierno, specialmente per quanto riguarda il deployment di soluzioni di intelligenza artificiale.

Sovranità dei Dati e Controllo Frameworkle nell'Era degli LLM

Per le organizzazioni che gestiscono dati sensibili o che operano in settori regolamentati, la sovranità dei dati non è un'opzione, ma un requisito imprescindibile. Il deployment di Large Language Models (LLM) on-premise o in ambienti self-hosted offre un controllo granulare sull'intera pipeline, dalla fase di fine-tuning all'inference. Questo approccio permette di scegliere l'hardware più adatto, come GPU con specifiche VRAM elevate (es. A100 80GB o H100 SXM5), e di ottimizzare le configurazioni per throughput e latenza specifici, elementi critici per carichi di lavoro AI intensivi.

Inoltre, una pianificazione accurata del Total Cost of Ownership (TCO) può rivelare che, a lungo termine, gli investimenti iniziali in infrastruttura bare metal possono tradursi in risparmi significativi rispetto ai costi operativi ricorrenti delle soluzioni cloud. La capacità di gestire direttamente le risorse consente di evitare costi imprevisti legati al trasferimento dati o all'utilizzo di servizi specifici, garantendo una maggiore prevedibilità finanziaria e un controllo più stretto sul budget.

I Vantaggi del Deployment On-Premise: Sicurezza e Personalizzazione

Il controllo diretto sull'infrastruttura AI porta con sé numerosi vantaggi in termini di sicurezza e personalizzazione. Ambienti air-gapped, ad esempio, garantiscono che i dati e i modelli rimangano completamente isolati, soddisfacendo i più stringenti requisiti di sicurezza e conformità, come il GDPR. La capacità di personalizzare lo stack tecnicico, dai framework di orchestrazione ai motori di inference, consente alle aziende di adattare le soluzioni AI alle proprie esigenze uniche, senza dipendere dalle limitazioni o dalle politiche dei fornitori di servizi cloud.

Questo livello di controllo si estende anche alla gestione della sicurezza, permettendo audit interni e l'implementazione di protocolli proprietari per proteggere la proprietà intellettuale e le informazioni riservate. La flessibilità di un deployment on-premise facilita inoltre l'integrazione con sistemi esistenti e la creazione di pipeline di sviluppo e rilascio (deployment) su misura, accelerando l'innovazione e riducendo la dipendenza da ecosistemi esterni.

Oltre la Piattaforma: Una Visione Strategica per il Futuro dell'AI

La scelta tra un deployment cloud e uno self-hosted per gli LLM non è meramente tecnica, ma strategica. Essa riflette la volontà di un'organizzazione di mantenere il controllo sui propri asset più preziosi: i dati e l'intelligenza che ne deriva. Proprio come i giornalisti indipendenti cercano di possedere la loro voce e la loro piattaforma, le aziende cercano di possedere la loro capacità di innovazione AI, garantendo che le loro operazioni siano resilienti, sicure e allineate con gli obiettivi a lungo termine.

Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi iniziali, costi operativi, performance e requisiti di sicurezza, fornendo una base solida per decisioni informate. In un'era in cui l'AI è sempre più al centro delle strategie aziendali, la capacità di gestire e controllare la propria infrastruttura AI diventa un fattore distintivo per la competitività e la resilienza, consentendo alle organizzazioni di sviluppare e implementare soluzioni AI con piena autonomia e fiducia.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!