La domanda di server AI spinge i ricavi ODM/EMS nel 2026

Il settore degli Original Design Manufacturer (ODM) e degli Electronics Manufacturing Services (EMS) ha registrato un'impennata significativa nei ricavi a marzo 2026. Questa crescita è direttamente attribuibile alla forte domanda di server dedicati all'intelligenza artificiale, un segmento in rapida espansione che sta ridefinendo le priorità nella produzione di hardware. Le aziende ODM ed EMS, fondamentali nella catena di fornitura tecnicica, sono responsabili della progettazione e produzione di componenti e sistemi per conto di altri marchi, e la loro performance è un indicatore chiave della salute e delle direzioni del mercato.

L'accelerazione nella richiesta di infrastruttura AI riflette l'adozione sempre più diffusa di Large Language Models (LLM) e di altre applicazioni di intelligenza artificiale in vari settori. Questo scenario pone nuove sfide e opportunità per i produttori, che devono adattare rapidamente le proprie capacità per soddisfare esigenze tecniche sempre più stringenti.

L'infrastruttura AI: un ecosistema in evoluzione

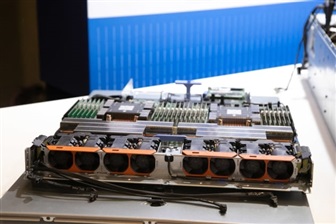

I server AI non sono semplici evoluzioni dei server tradizionali; rappresentano sistemi altamente specializzati, progettati per gestire carichi di lavoro intensivi che richiedono enormi capacità di calcolo parallelo. Al centro di questi sistemi si trovano le GPU ad alte prestazioni, spesso equipaggiate con grandi quantità di VRAM e interconnessioni ad alta velocità, essenziali per l'addestramento (training) e l'esecuzione (inference) di modelli complessi. La domanda per queste componenti ha un effetto a cascata su tutta la filiera, dalla produzione di silicio alla fabbricazione di schede madri e sistemi completi.

La complessità di questi server richiede competenze specifiche nella progettazione termica, nell'alimentazione e nell'integrazione di componenti avanzati. Le aziende ODM ed EMS che riescono a padroneggiare queste sfide si posizionano strategicamente per capitalizzare la crescita del mercato. La capacità di fornire soluzioni complete e ottimizzate diventa un fattore critico di successo.

Implicazioni per i deployment on-premise e il TCO

La crescente domanda di server AI ha profonde implicazioni per le organizzazioni che valutano strategie di deployment on-premise per i loro carichi di lavoro di intelligenza artificiale. Optare per soluzioni self-hosted offre vantaggi in termini di sovranità dei dati, controllo diretto sull'infrastruttura e potenziale ottimizzazione del Total Cost of Ownership (TCO) a lungo termine, specialmente per carichi di lavoro consistenti e prevedibili. Tuttavia, richiede un investimento significativo in hardware specializzato e competenze interne per la gestione e la manutenzione.

La disponibilità e il costo dei server AI influenzano direttamente la pianificazione CapEx per le infrastrutture locali. Le aziende devono bilanciare l'esigenza di potenza di calcolo con la complessità di gestione di ambienti bare metal o ibridi. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi iniziali, operativi e benefici strategici rispetto alle alternative cloud.

Prospettive future e la corsa all'innovazione

Il trend di crescita nella domanda di server AI non mostra segni di rallentamento, proiettando un futuro in cui l'infrastruttura di calcolo sarà sempre più orientata all'intelligenza artificiale. Questa evoluzione spinge l'innovazione non solo nelle GPU, ma anche in altre aree come le soluzioni di storage ad alta velocità, le reti a bassa latenza e i sistemi di raffreddamento avanzati. La capacità della filiera produttiva di tenere il passo con questa domanda e di innovare costantemente sarà cruciale.

Le sfide includono la gestione delle interruzioni della catena di approvvigionamento, la necessità di investimenti continui in ricerca e sviluppo e la formazione di forza lavoro specializzata. La performance delle aziende ODM ed EMS in questo contesto sarà un barometro importante per la salute complessiva del mercato dell'intelligenza artificiale e la sua capacità di sostenere l'adozione su larga scala.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!