L'Espansione del Mercato dei Server AI a Taiwan

Il settore dei server dedicati all'intelligenza artificiale a Taiwan sta registrando una notevole crescita, segnalando un'evoluzione che va oltre il tradizionale dominio di TSMC nel panorama della produzione di semiconduttori. Questa tendenza suggerisce che i benefici economici e tecnicici legati alla crescente domanda di infrastrutture AI si stanno diffondendo a un più ampio spettro di attori all'interno dell'ecosistema taiwanese. Per le organizzazioni che pianificano l'adozione di soluzioni AI, questa espansione del mercato globale dei server AI è un indicatore chiave della disponibilità e della diversificazione delle opzioni hardware.

La domanda di capacità computazionale per l'addestramento e l'Inference di Large Language Models (LLM) continua a trainare gli investimenti in hardware specializzato. La capacità di Taiwan di rispondere a questa esigenza, non solo attraverso le sue fonderie di chip ma anche tramite i produttori di server e componenti, è un fattore critico per la supply chain globale. Questa dinamica è particolarmente rilevante per le aziende che valutano strategie di deployment on-premise, dove la scelta dell'hardware e la robustezza della supply chain sono elementi fondamentali.

La Diversificazione della Supply Chain AI

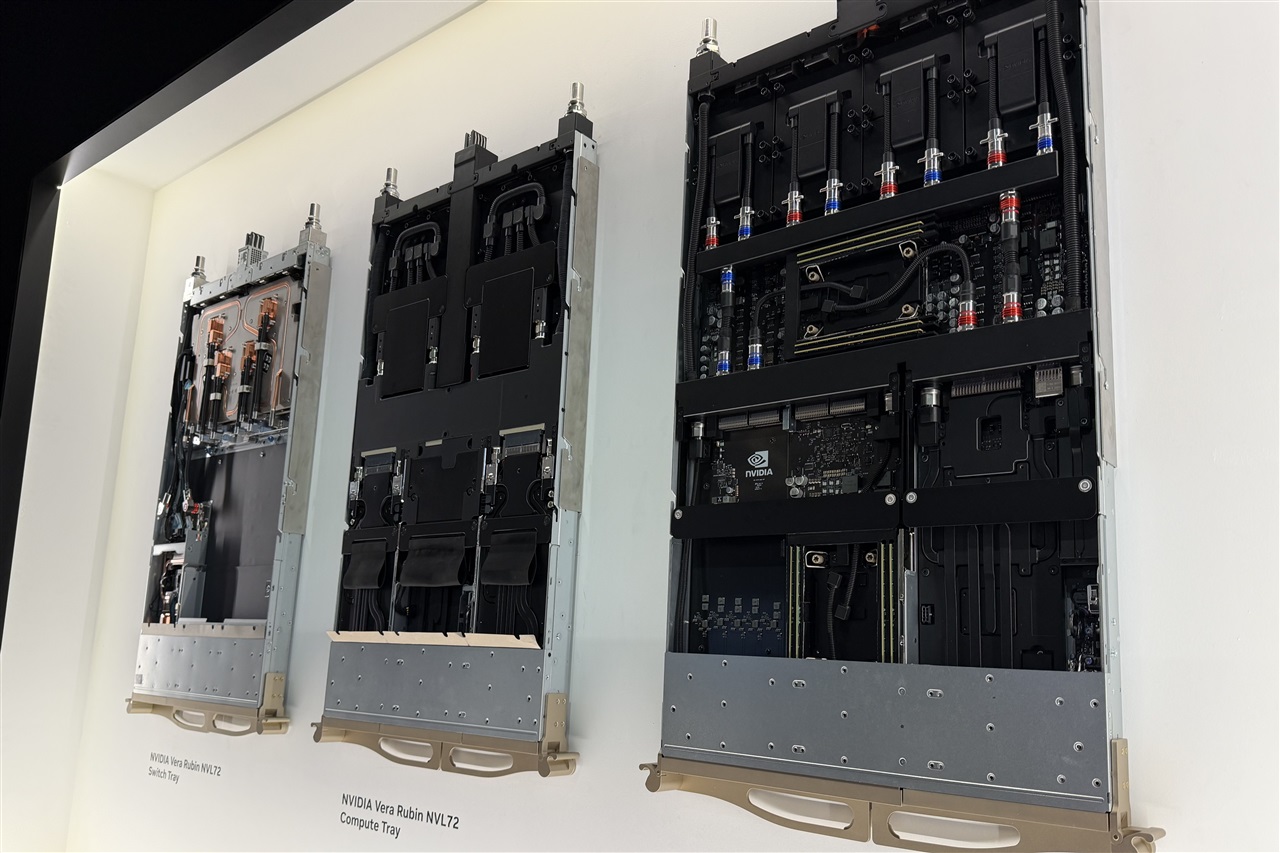

Tradizionalmente, TSMC è stata un pilastro insostituibile nella produzione di chip avanzati, inclusi quelli essenziali per l'AI. Tuttavia, la notizia che i guadagni nel settore dei server AI si stanno estendendo oltre questa singola entità indica una maturazione e una diversificazione della supply chain. Questo potrebbe significare una maggiore partecipazione di Original Design Manufacturers (ODM), produttori di schede madri, fornitori di sistemi di raffreddamento e altri specialisti hardware che contribuiscono all'assemblaggio e alla personalizzazione dei server AI.

Per i CTO e gli architetti di infrastruttura, una supply chain più ampia e resiliente si traduce in una maggiore flessibilità e potenzialmente in migliori condizioni per l'approvvigionamento di hardware. La capacità di accedere a un ventaglio più ampio di fornitori può mitigare i rischi legati alla dipendenza da un singolo attore e favorire l'innovazione attraverso la competizione. Questo scenario è cruciale per chi deve pianificare investimenti a lungo termine in infrastrutture AI, dove la disponibilità e la scalabilità sono priorità assolute.

Implicazioni per i Deployment On-Premise e il TCO

L'espansione del mercato dei server AI a Taiwan ha dirette implicazioni per le strategie di deployment on-premise. Le aziende che optano per soluzioni self-hosted per i loro carichi di lavoro LLM necessitano di hardware specifico, spesso caratterizzato da GPU con elevata VRAM e interconnessioni ad alta velocità. La maggiore disponibilità di server AI diversificati può facilitare l'acquisizione di sistemi ottimizzati per l'Inference o il Fine-tuning, consentendo una maggiore personalizzazione in base ai requisiti specifici di performance, come throughput e latenza.

La valutazione del Total Cost of Ownership (TCO) diventa un fattore determinante in questo contesto. Sebbene l'investimento iniziale (CapEx) per l'hardware on-premise possa essere significativo, i costi operativi a lungo termine, inclusi quelli energetici e di manutenzione, devono essere attentamente bilanciati rispetto ai modelli basati su OpEx del cloud. La sovranità dei dati e le esigenze di compliance, specialmente in settori regolamentati, spesso rendono i deployment air-gapped o self-hosted una scelta obbligata, e la disponibilità di un mercato hardware robusto è fondamentale per supportare tali decisioni. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off.

Prospettive Future e Sfide per l'Framework AI

Il continuo sviluppo del mercato dei server AI a Taiwan riflette una tendenza globale verso l'intensificazione dell'adozione dell'intelligenza artificiale in tutti i settori. Tuttavia, questa crescita porta con sé anche sfide significative. La gestione dell'enorme consumo energetico dei data center AI, la necessità di sistemi di raffreddamento avanzati e la complessità della gestione di stack hardware e software eterogenei sono solo alcune delle considerazioni che le aziende devono affrontare.

Guardando al futuro, la capacità dell'ecosistema taiwanese di continuare a innovare e a diversificare la propria offerta sarà cruciale. Per i decision-maker tecnicici, la comprensione di queste dinamiche di mercato è essenziale per formulare strategie infrastrutturali che non solo soddisfino le esigenze attuali, ma siano anche scalabili e resilienti di fronte all'evoluzione rapida delle tecnicie AI. La scelta tra soluzioni cloud e on-premise rimarrà un dibattito centrale, con la disponibilità di hardware specializzato che gioca un ruolo sempre più importante.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!