Le tensioni legali tra Musk e OpenAI

Il panorama dell'intelligenza artificiale è spesso teatro di dinamiche complesse, non solo sul fronte dell'innovazione tecnicica, ma anche su quello legale e strategico. Un recente sviluppo ha gettato nuova luce sulle tensioni tra Elon Musk e OpenAI, l'organizzazione che ha contribuito a fondare. Due giorni prima dell'inizio del processo, Musk ha tentato di avviare un dialogo per un possibile accordo.

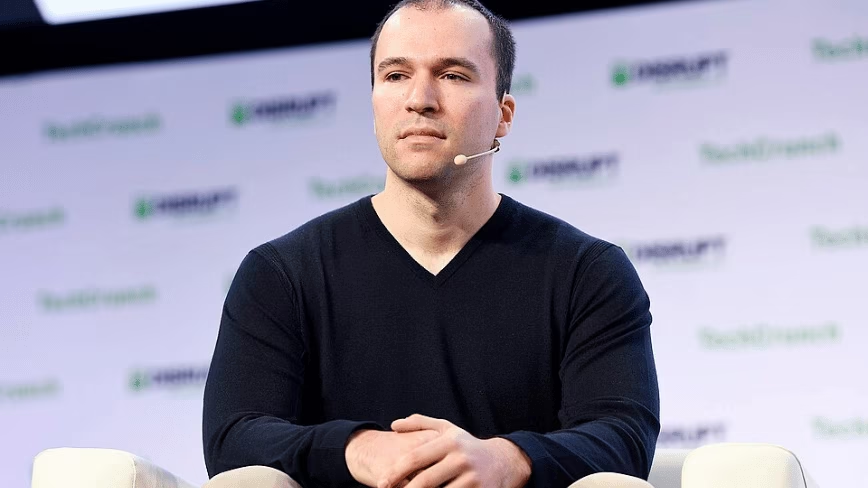

Lo scambio, avvenuto tramite messaggi con Greg Brockman, co-fondatore di OpenAI, mirava a esplorare le vie per una risoluzione extragiudiziale. Tuttavia, la proposta di Brockman di ritirare tutte le accuse contro gli individui coinvolti nella disputa ha segnato una svolta nelle trattative, portando a una reazione inattesa da parte di Musk.

Lo scambio di messaggi e le implicazioni

La risposta di Elon Musk alla controproposta di Brockman è stata diretta e carica di tensione. Musk ha replicato che, se Brockman avesse insistito sulla sua richiesta, lui e Sam Altman sarebbero diventati "gli uomini più odiati d'America entro la fine della settimana". Questa dichiarazione, seguita dall'affermazione "Se insistete, così sarà", sottolinea la profondità del conflitto e la determinazione delle parti.

L'intero scambio è stato reso pubblico attraverso un documento depositato in tribunale, offrendo uno spaccato delle dinamiche personali e professionali che animano le figure chiave del settore AI. Questi episodi, sebbene non direttamente legati a specifiche tecniche di deployment o hardware, riflettono un contesto di incertezza che può influenzare le decisioni strategiche delle aziende che si affidano a questi attori per le proprie infrastrutture AI.

Contesto e impatto sul panorama AI

Per CTO, responsabili DevOps e architetti di infrastruttura, la stabilità e la visione a lungo termine dei fornitori di Large Language Models sono fattori critici. Le dispute legali e le turbolenze interne ai leader del settore possono generare preoccupazioni riguardo la continuità del supporto, lo sviluppo futuro dei modelli e la solidità complessiva delle partnership tecniciche. Questo è particolarmente rilevante per le aziende che valutano deployment self-hosted o on-premise di LLM, dove gli investimenti in hardware, licenze e personale sono significativi e a lungo termine.

La scelta di un partner tecnicico per carichi di lavoro AI, che sia per l'inference o il training, non si basa solo sulle specifiche di VRAM o sul throughput, ma anche sulla fiducia nella leadership e nella strategia aziendale. Eventi come quello tra Musk e OpenAI evidenziano la necessità di una due diligence approfondita che vada oltre la mera analisi tecnica, includendo la valutazione della governance e della stabilità organizzativa dei fornitori di soluzioni AI.

Prospettive future e decisioni di deployment

Le dinamiche interne e le controversie legali tra i giganti dell'AI possono avere ripercussioni sul mercato, influenzando la percezione del rischio e le strategie di adozione. Per le organizzazioni che mirano a mantenere la sovranità dei dati e il controllo sui propri stack AI attraverso deployment on-premise o air-gapped, la scelta di un ecosistema stabile e prevedibile è fondamentale. La trasparenza su queste dinamiche, anche se scomoda, è cruciale per una pianificazione strategica informata.

AI-RADAR si impegna a fornire analisi neutrali sui vincoli e i trade-off associati alle diverse scelte di deployment, senza raccomandazioni dirette. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise che possono aiutare a ponderare non solo i costi operativi e di capitale (TCO), ma anche i fattori di rischio legati alla stabilità dei fornitori e del mercato. Questi eventi sottolineano come il contesto aziendale e legale sia parte integrante della valutazione tecnicica complessiva.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!