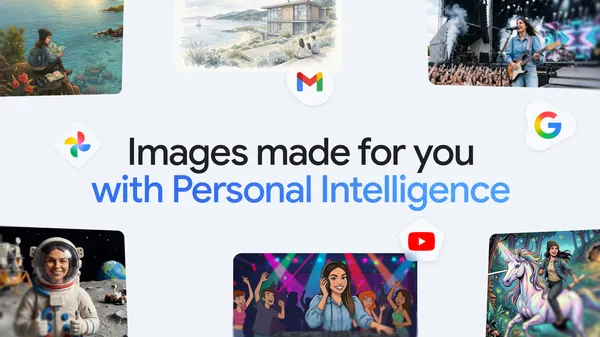

Gemini e la Nuova Frontiera delle Immagini Personalizzate

L'ecosistema dell'intelligenza artificiale generativa continua a evolvere, spingendosi verso livelli sempre maggiori di personalizzazione. Un esempio recente di questa tendenza emerge dall'applicazione Gemini, che ha integrato nuove funzionalità per la creazione di immagini. Al centro di questa innovazione si trova il modello Nano Banana 2, progettato per sfruttare il contesto personale dell'utente e le sue Google Foto al fine di generare immagini che riflettano la sua vita e le sue esperienze uniche.

Questa capacità di attingere a dati così specifici e sensibili segna un passo significativo nell'interazione tra utente e AI. Se da un lato promette un'esperienza utente più ricca e pertinente, dall'altro solleva immediatamente questioni fondamentali relative alla privacy, alla gestione dei dati e alla loro sovranità. Per le aziende e le organizzazioni, in particolare quelle che operano in settori regolamentati, l'approccio alla personalizzazione basata su dati privati rappresenta un campo di analisi critico.

Il Modello Nano Banana 2 e la Generazione Contestuale

Il funzionamento di un sistema come Nano Banana 2, sebbene i dettagli specifici non siano stati divulgati, si basa probabilmente sull'integrazione di tecniche avanzate di Large Language Models (LLM) e modelli generativi multimodali. Questi modelli sono addestrati per comprendere e interpretare sia il linguaggio naturale che i dati visivi. La capacità di utilizzare il "contesto personale" implica che il modello può accedere a informazioni derivanti dalle interazioni dell'utente, dalle sue preferenze e, in questo caso specifico, dal vasto archivio di immagini custodito in Google Foto.

La sfida tecnica risiede nel creare un ponte efficace tra questi diversi tipi di dati – testuali e visivi – e nel tradurli in prompt o input che guidino la generazione di immagini coerenti e personalizzate. Questo processo richiede non solo una profonda comprensione semantica, ma anche la capacità di mantenere la coerenza stilistica e tematica con il materiale di riferimento dell'utente. La personalizzazione spinta a questo livello richiede un'architettura robusta e una gestione sofisticata degli embeddings e delle pipeline di generazione.

Implicazioni per la Sovranità dei Dati e i Deployment On-Premise

L'utilizzo di dati personali e sensibili, come le fotografie private, per alimentare modelli di intelligenza artificiale, pone l'accento sulla questione della sovranità dei dati. Per le imprese, specialmente quelle che gestiscono informazioni proprietarie o soggette a normative stringenti (come GDPR o HIPAA), la decisione su dove e come elaborare tali dati è cruciale. Un servizio cloud consumer-oriented, per quanto avanzato, potrebbe non soddisfare i requisiti di compliance e controllo che un'infrastruttura self-hosted o air-gapped può offrire.

Le organizzazioni che valutano l'adozione di LLM con requisiti stringenti di privacy e controllo, come la necessità di mantenere i dati all'interno dei propri confini aziendali o nazionali, devono analizzare attentamente i trade-off tra soluzioni cloud e self-hosted. Il Total Cost of Ownership (TCO) di un deployment on-premise, che include l'investimento in hardware (GPU con VRAM adeguata, server), infrastruttura e personale specializzato, deve essere bilanciato con i benefici in termini di sicurezza, controllo e conformità. AI-RADAR offre framework analitici su /llm-onpremise per approfondire queste decisioni, fornendo strumenti per valutare le specifiche hardware e i vincoli architetturali.

Prospettive Future e Sfide Tecniche per l'AI Personalizzata

La direzione intrapresa da Gemini con Nano Banana 2 prefigura un futuro in cui l'AI sarà sempre più integrata nella vita quotidiana, offrendo esperienze iper-personalizzate. Tuttavia, questa evoluzione non è priva di sfide. Dal punto di vista tecnico, la scalabilità di tali sistemi, la gestione efficiente delle risorse computazionali per l'inference e la necessità di aggiornare continuamente i modelli con nuovi dati personali, rappresentano ostacoli significativi. La quantization dei modelli e l'ottimizzazione per l'hardware specifico diventano essenziali per garantire throughput e latenza accettabili.

Inoltre, la fiducia degli utenti e la trasparenza sui meccanismi di utilizzo dei dati saranno fattori determinanti per l'adozione su larga scala. Per le imprese, la capacità di implementare soluzioni AI che offrano personalizzazione senza compromettere la sicurezza e la sovranità dei dati sarà un vantaggio competitivo cruciale. La scelta tra un deployment in cloud e un'infrastruttura bare metal o ibrida dipenderà sempre più dalla capacità di bilanciare innovazione, costi e, soprattutto, la protezione delle informazioni più sensibili.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!