Google ridefinisce l'infrastruttura AI con nuove TPU e Axion Arm

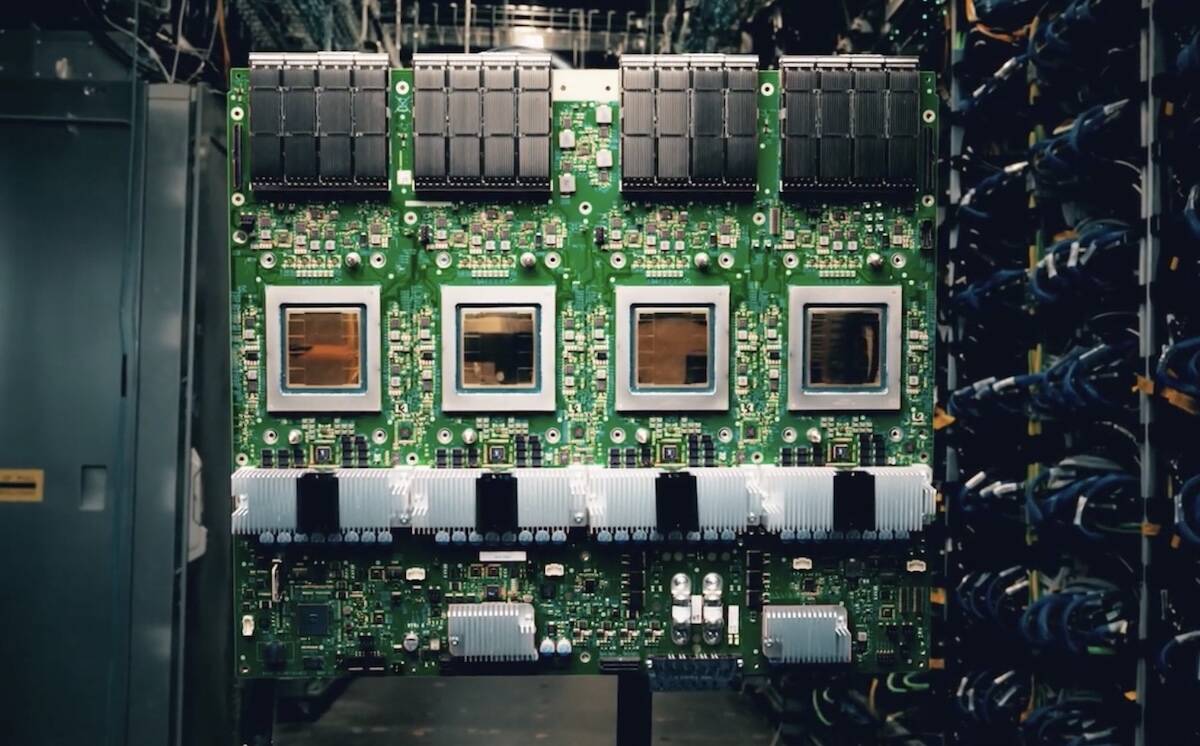

Google ha recentemente catturato l'attenzione del settore tecnicico durante la sua conferenza annuale Cloud Next a Las Vegas, presentando due nuovi acceleratori AI proprietari. Questa mossa sottolinea la crescente tendenza dei giganti tecnicici a investire massicciamente nello sviluppo di silicio personalizzato, con l'obiettivo di ottimizzare le performance e l'efficienza energetica per i carichi di lavoro di intelligenza artificiale.

L'annuncio è particolarmente significativo perché introduce un approccio duale: un acceleratore è specificamente progettato per velocizzare le operazioni di training dei Large Language Models (LLM) e altri modelli AI complessi, mentre l'altro mira a ridurre drasticamente i costi associati al serving dei modelli, ovvero la fase di Inference. Questa distinzione è cruciale, poiché i requisiti hardware e le ottimizzazioni per il training e l'Inference possono variare notevolmente, influenzando direttamente il Total Cost of Ownership (TCO) delle infrastrutture AI.

Il binomio TPU-Axion: un cambio di paradigma architetturale

Una delle novità più rilevanti è l'abbinamento delle nuove TPU di Google con core Axion basati su architettura Arm. Questa scelta rappresenta un chiaro allontanamento dall'architettura x86, tradizionalmente dominante nei data center. L'adozione di processori Arm per affiancare le TPU suggerisce una strategia volta a massimizzare l'efficienza e la flessibilità.

I processori Arm sono noti per la loro efficienza energetica e per la capacità di offrire performance competitive in specifici carichi di lavoro, rendendoli una scelta interessante per l'orchestrazione e la gestione dei dati all'interno di un sistema di accelerazione AI. Questa integrazione potrebbe consentire a Google di ottenere un controllo più granulare sull'intera pipeline di elaborazione, ottimizzando la comunicazione tra CPU e acceleratori e riducendo le latenze, fattori critici sia per il training distribuito che per l'Inference a bassa latenza.

Implicazioni per il deployment e il TCO

La spinta verso il silicio personalizzato, come quello di Google, ha profonde implicazioni per le aziende che valutano le proprie strategie di deployment AI. Se da un lato le soluzioni cloud-based che sfruttano questi acceleratori possono offrire accesso a risorse all'avanguardia senza l'onere dell'investimento iniziale (CapEx), dall'altro le organizzazioni con esigenze di sovranità dei dati, compliance stringenti o requisiti di ambienti air-gapped potrebbero preferire soluzioni self-hosted o ibride.

Per chi valuta deployment on-premise, la disponibilità di hardware specializzato, anche se non direttamente accessibile come prodotto stand-alone, influenza il panorama competitivo e le scelte tecniciche future. La capacità di un'infrastruttura di supportare carichi di lavoro di training intensivi o di gestire milioni di richieste di Inference al secondo con un TCO controllato dipende fortemente dall'efficienza dell'hardware sottostante. Le architetture come quella proposta da Google evidenziano come l'ottimizzazione a livello di chip sia fondamentale per raggiungere questi obiettivi.

La corsa all'innovazione nel silicio AI

L'annuncio di Google si inserisce in un contesto più ampio di intensa competizione nel settore del silicio per l'AI. Molte aziende stanno investendo nello sviluppo di chip proprietari, riconoscendo che l'hardware è un fattore abilitante critico per l'avanzamento dell'intelligenza artificiale. Questa "corsa agli armamenti" tecnicica non riguarda solo la potenza di calcolo bruta, ma anche l'efficienza, la programmabilità e la capacità di integrare strettamente hardware e software.

Per le imprese, comprendere queste dinamiche è essenziale per pianificare investimenti futuri e scegliere le piattaforme più adatte alle proprie esigenze. La scelta tra soluzioni basate su GPU generiche, FPGA o ASIC personalizzati, e l'architettura della CPU di supporto (x86 o Arm), comporta trade-off significativi in termini di performance, flessibilità, costi e requisiti di integrazione. Il mercato continuerà a evolversi rapidamente, offrendo opzioni sempre più specializzate per affrontare le sfide dei carichi di lavoro AI.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!