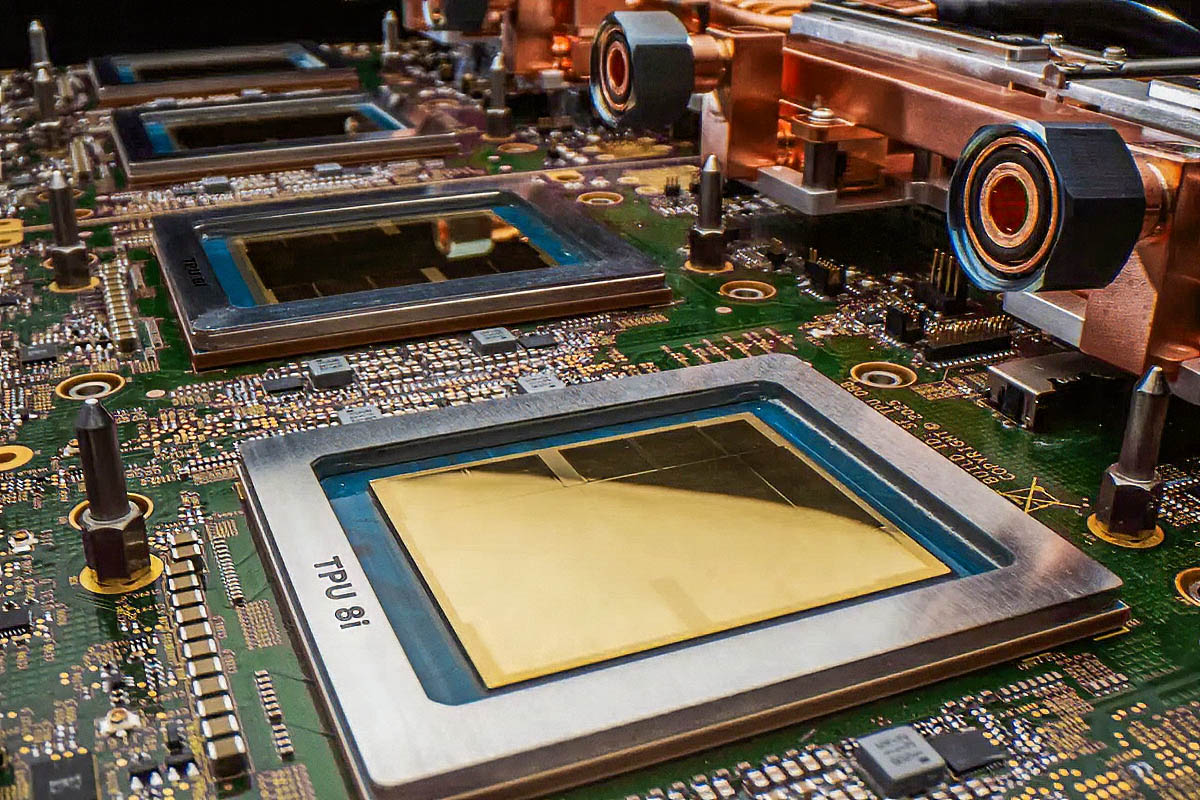

Google Svela le TPU di Ottava Generazione per l'AI

Google ha recentemente annunciato l'introduzione delle sue nuove unità di elaborazione tensoriale (TPU) di ottava generazione: la TPU 8i e la TPU 8t. Queste nuove iterazioni del silicio proprietario di Google sono state progettate con un focus specifico, distinguendo chiaramente tra i requisiti computazionali dell'inference e quelli del training dei modelli di intelligenza artificiale.

La TPU 8i è stata sviluppata per gestire i carichi di lavoro di inference AI, mentre la TPU 8t è dedicata alle operazioni di training. Questa specializzazione riflette una tendenza consolidata nel settore, dove l'ottimizzazione dell'hardware per compiti specifici è fondamentale per massimizzare l'efficienza e le performance nell'era dei Large Language Models (LLM).

Dettaglio Tecnico e Ruolo nel Panorama AI

La distinzione tra hardware per inference e training è cruciale per le aziende che operano con carichi di lavoro AI intensivi. Il training di un LLM richiede una potenza di calcolo massiva, elevata larghezza di banda della memoria (VRAM) e la capacità di gestire operazioni in virgola mobile con alta precisione per periodi prolungati. L'obiettivo è addestrare modelli complessi su dataset di dimensioni enormi, un processo che può durare giorni o settimane.

L'inference, d'altra parte, si concentra sulla rapidità di esecuzione e sul throughput per elaborare un gran numero di richieste in tempo reale o quasi. Qui, la latenza è un fattore critico, e spesso si ricorre a tecniche come la Quantization per ridurre l'ingombro del modello e accelerare le risposte, pur mantenendo una precisione accettabile. Le nuove TPU di Google si inseriscono in questo contesto, offrendo soluzioni ottimizzate per ciascuna fase, sebbene all'interno del proprio ecosistema cloud.

Implicazioni per i Deployment On-Premise e Ibridi

L'annuncio di Google, pur riguardando hardware proprietario per il proprio cloud, sottolinea una tendenza più ampia che ha profonde implicazioni per le organizzazioni che valutano deployment self-hosted o ibridi. La necessità di silicio specializzato per l'AI, sia per il training che per l'inference, è un fattore chiave nella pianificazione dell'infrastruttura.

Per le aziende che optano per soluzioni on-premise, la scelta dell'hardware diventa una decisione strategica che impatta direttamente il Total Cost of Ownership (TCO), la sovranità dei dati e la compliance. La disponibilità di GPU con specifiche adeguate, come una VRAM sufficiente e un throughput elevato, è essenziale per eseguire LLM in locale. La valutazione di questi trade-off è complessa e richiede un'analisi approfondita delle esigenze specifiche del carico di lavoro, dei requisiti di sicurezza per ambienti air-gapped e delle capacità di gestione dell'infrastruttura bare metal. AI-RADAR offre framework analitici su /llm-onpremise per supportare queste valutazioni, evidenziando i vincoli e le opportunità dei deployment locali.

Prospettive Future e Scelte Strategiche

L'evoluzione continua del silicio dedicato all'AI, come dimostrato dalle nuove TPU di Google, evidenzia l'importanza crescente delle decisioni hardware nel panorama dell'intelligenza artificiale. Le organizzazioni devono considerare attentamente se le soluzioni cloud proprietarie, con i loro vantaggi in termini di scalabilità e gestione, si allineano con le proprie esigenze di controllo, sicurezza e costi a lungo termine.

La scelta tra un approccio cloud-first e un deployment on-premise o ibrido non è mai banale. Fattori come la sensibilità dei dati, le normative di settore e la prevedibilità dei costi operativi giocano un ruolo determinante. La disponibilità di hardware specializzato, sia esso offerto da fornitori cloud o da terze parti per installazioni locali, continuerà a essere un elemento chiave per sbloccare il pieno potenziale dell'AI in contesti aziendali diversificati.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!