La Nuova Generazione di TPU: Una Strategia a Doppio Chip

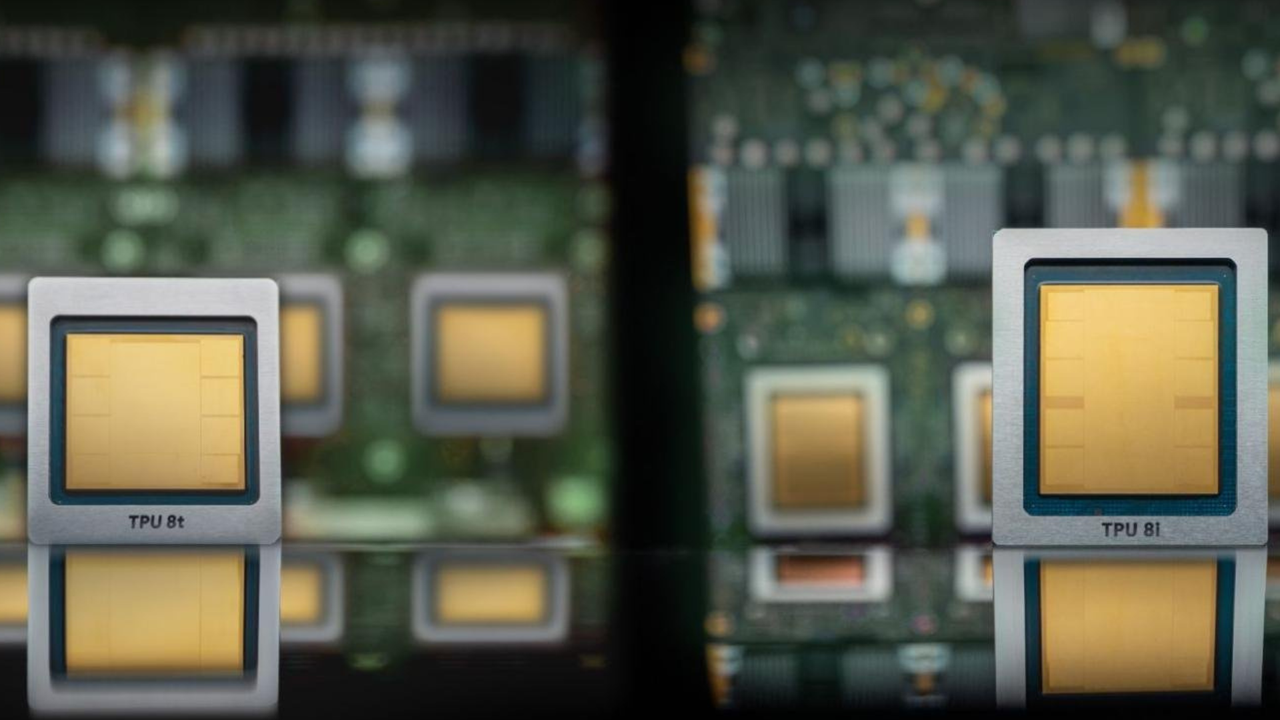

Google ha recentemente svelato la sua ottava generazione di Tensor Processing Units (TPU), introducendo i modelli 8i e 8t. Questa mossa strategica sottolinea l'impegno dell'azienda nello sviluppo di silicio proprietario per l'intelligenza artificiale, un settore in rapida evoluzione dove l'ottimizzazione hardware è cruciale per sostenere la crescita dei Large Language Models (LLM) e di altri carichi di lavoro computazionalmente intensivi.

La scelta di presentare due chip distinti, il TPU 8i e il TPU 8t, suggerisce un approccio mirato a indirizzare due compiti fondamentali nell'ambito dell'AI. Tradizionalmente, l'hardware per l'intelligenza artificiale viene ottimizzato per la fase di training (addestramento) o per quella di inference (esecuzione). È plausibile che i due modelli siano stati progettati per eccellere in queste due aree complementari, offrendo soluzioni più efficienti per l'intero ciclo di vita di un modello AI.

Ottimizzazione per Carichi di Lavoro Specifici e Scalabilità

La strategia di Google con i TPU 8i e 8t si concentra sull'ottimizzazione per carichi di lavoro specifici. Mentre un chip potrebbe essere configurato per massimizzare il throughput durante il training di modelli complessi, richiedendo ampie capacità di VRAM e interconnessioni ad alta velocità, l'altro potrebbe essere ottimizzato per l'inference, dove la latenza e l'efficienza energetica per token sono parametri critici. Questa differenziazione consente agli sviluppatori e alle aziende di scegliere la soluzione più adatta alle proprie esigenze, massimizzando le prestazioni e contenendo i costi operativi.

Un aspetto chiave evidenziato dalla strategia è il vantaggio offerto dalla scalabilità di questi chip rispetto ad altri acceleratori AI, inclusi quelli di Nvidia. La capacità di scalare in modo efficiente è fondamentale per gestire modelli sempre più grandi e dataset voluminosi, riducendo i tempi di training e migliorando la reattività dei sistemi di inference. Per le aziende che operano con LLM di dimensioni considerevoli, la scalabilità non è solo un fattore di performance, ma anche un elemento determinante per il Total Cost of Ownership (TCO).

Implicazioni per il Deployment On-Premise e la Competizione Hardware

Sebbene i TPU di Google siano storicamente associati all'infrastruttura cloud dell'azienda, l'introduzione di nuove generazioni di hardware come i TPU 8i e 8t ha implicazioni significative per l'intero mercato degli acceleratori AI, inclusi i deployment self-hosted. La pressione competitiva esercitata da Google spinge l'innovazione in tutto il settore, portando a soluzioni hardware sempre più performanti ed efficienti anche per ambienti on-premise.

Per CTO, DevOps lead e architetti infrastrutturali che valutano alternative self-hosted vs cloud per carichi di lavoro AI/LLM, l'evoluzione del silicio proprietario come i TPU di Google evidenzia l'importanza di analizzare attentamente i trade-off. Fattori come la sovranità dei dati, la compliance, la necessità di ambienti air-gapped e il TCO complessivo rimangono prioritari. La disponibilità di acceleratori specializzati sul mercato, anche se non direttamente accessibili on-premise, influenza le scelte dei vendor che offrono soluzioni per infrastrutture bare metal, spingendoli a migliorare le proprie offerte in termini di VRAM, throughput e latenza. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise per valutare questi trade-off.

Prospettive Future nel Panorama dell'AI Hardware

La strategia TPU V8 di Google riflette una tendenza più ampia nel settore dell'intelligenza artificiale: la crescente specializzazione dell'hardware per affrontare le sfide uniche poste dai carichi di lavoro AI. Con l'aumento della complessità e delle dimensioni dei modelli, la necessità di silicio progettato specificamente per il training e l'inference diventa sempre più pressante. Questa corsa all'innovazione hardware è destinata a continuare, con un focus costante su efficienza energetica, capacità di memoria e velocità di calcolo.

Le decisioni di deployment per l'AI, sia in cloud che on-premise, dipenderanno sempre più dalla capacità di bilanciare le esigenze di performance con i vincoli di costo, sicurezza e controllo. L'introduzione dei TPU 8i e 8t da parte di Google non solo rafforza la sua posizione nel cloud AI, ma stimola anche l'innovazione in tutto l'ecosistema hardware, offrendo nuove opportunità e sfide per le aziende che cercano di sfruttare appieno il potenziale dell'intelligenza artificiale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!