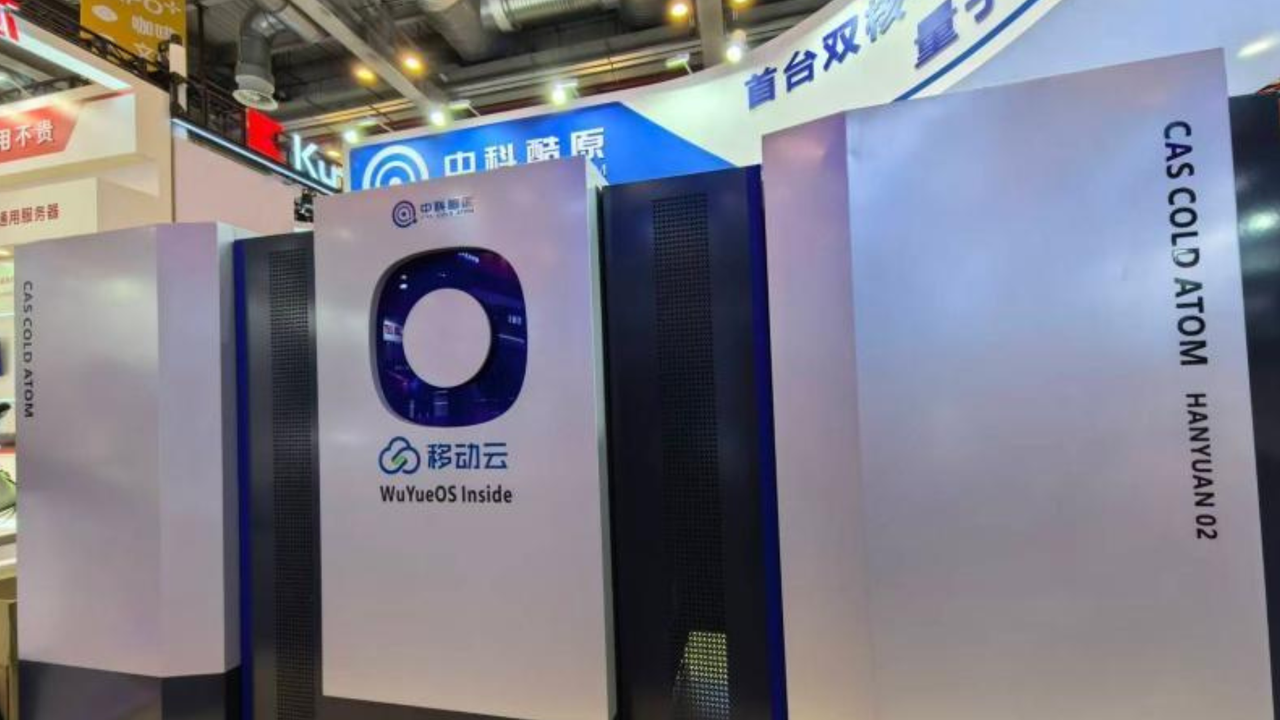

Il debutto di Hanyuan-2: promesse e incertezze nel quantum computing

La Cina ha annunciato il debutto di Hanyuan-2, un sistema che si presenta come il primo computer quantistico dual-core al mondo. Con una capacità dichiarata di 200 qubit, questa macchina rappresenta un passo significativo nell'ambiziosa corsa globale verso il dominio del calcolo quantistico. La sua introduzione evidenzia il rapido progresso e l'intensa competizione nel settore, dove ogni nuova architettura o incremento di qubit viene osservato con grande attenzione.

Un aspetto particolarmente enfatizzato dai suoi sviluppatori è l'incredibile efficienza energetica del sistema. In un'epoca in cui il consumo di energia dei data center e delle infrastrutture di calcolo ad alte prestazioni è una preoccupazione crescente, la promessa di un'elevata efficienza è senza dubbio attraente. Tuttavia, la validità di tali affermazioni, per quanto promettenti, rimane da verificare in assenza di dati concreti e comparabili.

L'importanza dei benchmark nel panorama tecnicico

Nonostante le rivendicazioni di Hanyuan-2, un elemento cruciale manca all'appello: i benchmark prestazionali. Nel mondo della tecnicia, e in particolare in settori emergenti come il quantum computing o i Large Language Models (LLM), i benchmark rappresentano la pietra angolare per la valutazione oggettiva delle capacità di un sistema. Essi consentono di misurare il throughput, la latenza, la scalabilità e l'efficienza rispetto a standard riconosciuti, fornendo un framework chiaro delle prestazioni reali.

Per CTO, DevOps lead e architetti di infrastrutture che devono prendere decisioni strategiche sui deployment, l'assenza di benchmark è un ostacolo significativo. Senza metriche standardizzate, diventa estremamente difficile confrontare Hanyuan-2 con altre soluzioni quantistiche esistenti o future, o valutarne il potenziale impatto su carichi di lavoro specifici. Questo principio si applica universalmente, sia che si tratti di un computer quantistico all'avanguardia o di un'infrastruttura per l'inference di LLM su hardware bare metal.

Efficienza energetica vs. prestazioni: un trade-off da validare

La rivendicazione di un'incredibile efficienza energetica da parte di Hanyuan-2 è un punto di forza potenziale, soprattutto considerando il TCO (Total Cost of Ownership) delle infrastrutture di calcolo. Ridurre il consumo energetico può tradursi in costi operativi significativamente inferiori e un minore impatto ambientale. Tuttavia, l'efficienza da sola non è sufficiente se non è accompagnata da prestazioni adeguate per i compiti che il sistema è chiamato a svolgere.

Il bilanciamento tra efficienza e performance è un trade-off costante in ogni ambito dell'hardware computing, dalle GPU per il training di LLM ai processori per l'edge computing. Senza benchmark che dimostrino come l'efficienza si traduca in un vantaggio pratico per la risoluzione di problemi quantistici, la sua reale utilità per applicazioni enterprise rimane un'incognita. La necessità di una validazione indipendente e trasparente è quindi più che mai evidente.

Prospettive future e l'esigenza di trasparenza

Il debutto di Hanyuan-2 sottolinea l'accelerazione della ricerca e sviluppo nel campo del quantum computing a livello globale. Mentre la tecnicia quantistica è ancora nelle sue fasi iniziali e lontana da un deployment diffuso per la maggior parte delle applicazioni aziendali, i progressi come quelli di Hanyuan-2 sono importanti per spingere i confini dell'innovazione. Tuttavia, la maturità di qualsiasi tecnicia, inclusi gli LLM e le loro infrastrutture di supporto, dipende dalla capacità della comunità di valutarla in modo rigoroso.

Per i decision-maker che valutano l'adozione di nuove tecnicie, la trasparenza sui dati prestazionali e l'adesione a standard di benchmark riconosciuti sono fondamentali. Questo approccio basato sui fatti è essenziale per mitigare i rischi e ottimizzare gli investimenti, sia che si tratti di esplorare il potenziale del quantum computing o di scegliere la migliore strategia per i deployment di LLM on-premise. AI-RADAR offre framework analitici su /llm-onpremise per valutare trade-off e vincoli in contesti di deployment critici, enfatizzando l'importanza di dati concreti per ogni decisione infrastrutturale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!