Holtek: Aumento Prezzi MCU, Espansione in Raffreddamento Server AI e Comunicazioni Ottiche

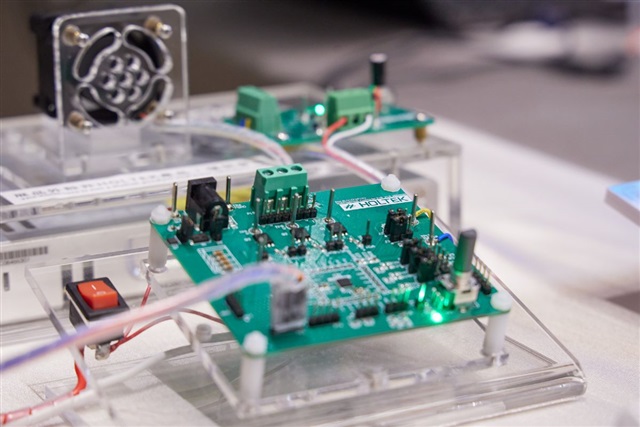

Holtek, un attore consolidato nel panorama della produzione di microcontrollori (MCU), ha recentemente annunciato una revisione della propria strategia commerciale. L'azienda ha comunicato l'intenzione di aumentare i prezzi per i suoi MCU a basso margine, una mossa che segnala un riposizionamento volto a ottimizzare la redditività e a concentrare le risorse su segmenti di mercato più promettenti. Questa decisione si inserisce in un contesto globale di fluttuazioni della domanda e di pressioni sui costi, spingendo i produttori a riconsiderare il proprio portafoglio prodotti.

Parallelamente a questa strategia di pricing, Holtek ha rivelato piani ambiziosi per espandere significativamente le proprie attività in due settori tecnicici emergenti e di cruciale importanza: il raffreddamento per server AI e le comunicazioni ottiche. Questa duplice espansione evidenzia una chiara direzione strategica verso l'infrastruttura di calcolo ad alte prestazioni, in particolare quella dedicata ai carichi di lavoro di intelligenza artificiale e ai Large Language Models (LLM).

L'Importanza del Raffreddamento per l'Framework AI

L'espansione di Holtek nel settore del raffreddamento per server AI risponde a un'esigenza sempre più pressante nel mondo del calcolo ad alte prestazioni. I moderni server AI, equipaggiati con GPU di ultima generazione, generano quantità di calore considerevoli durante le operazioni di training e inference di LLM. Questo calore, se non gestito efficacemente, può compromettere le performance, ridurre l'affidabilità dell'hardware e aumentare drasticamente il Total Cost of Ownership (TCO) di un data center.

Per le aziende che valutano deployment on-premise di infrastrutture AI, soluzioni di raffreddamento avanzate sono un fattore critico. Sistemi di raffreddamento a liquido, ad esempio, possono offrire un'efficienza superiore rispetto ai metodi tradizionali ad aria, consentendo densità di calcolo maggiori e contribuendo a mantenere le temperature operative ottimali per componenti come le VRAM delle GPU. La capacità di dissipare il calore in modo efficiente è direttamente correlata alla sostenibilità e alla scalabilità delle architetture AI locali.

Il Ruolo Strategico delle Comunicazioni Ottiche

Contemporaneamente, l'ingresso di Holtek nel campo delle comunicazioni ottiche sottolinea un'altra componente fondamentale per l'infrastruttura AI. La crescente complessità e dimensione dei Large Language Models richiedono non solo una potenza di calcolo massiva, ma anche una capacità di interconnessione tra le GPU e i server estremamente elevata e a bassa latenza. Le comunicazioni ottiche, grazie alla loro capacità di offrire throughput elevatissimi su distanze maggiori rispetto ai tradizionali collegamenti in rame, sono diventate indispensabili in questo scenario.

Sia per il training distribuito che per l'inference su larga scala, la velocità con cui i dati possono essere trasferiti tra i nodi di calcolo è un fattore limitante. Le soluzioni basate su fibra ottica permettono di costruire cluster AI con un'architettura più flessibile e performante, riducendo i colli di bottiglia e massimizzando l'utilizzo delle risorse di calcolo. Questo è particolarmente rilevante per gli ambienti self-hosted, dove l'ottimizzazione di ogni componente dell'infrastruttura contribuisce a migliorare l'efficienza complessiva e a garantire la sovranità dei dati.

Implicazioni per i Deployment On-Premise e la Sovranità dei Dati

Le mosse strategiche di Holtek riflettono una tendenza più ampia nel settore tecnicico, dove la domanda di componenti specializzati per l'AI è in forte crescita. Per CTO, DevOps lead e architetti di infrastruttura che considerano deployment on-premise per i propri carichi di lavoro LLM, la disponibilità di soluzioni avanzate per il raffreddamento e le comunicazioni ottiche è fondamentale. Questi elementi non solo influenzano direttamente le performance e il TCO, ma sono anche cruciali per la compliance e la sovranità dei dati, aspetti prioritari per molte organizzazioni.

La possibilità di costruire e gestire un'infrastruttura AI robusta e performante in un ambiente controllato, come un data center air-gapped, dipende dalla qualità e dall'efficienza di ogni singolo componente. L'espansione di aziende come Holtek in questi settori chiave contribuisce a rafforzare l'ecosistema di fornitori per le soluzioni self-hosted, offrendo maggiori opzioni e innovazioni per chi cerca alternative al cloud pubblico. Per chi valuta deployment on-premise, esistono trade-off complessi tra CapEx iniziale, costi operativi a lungo termine e i benefici in termini di controllo e sicurezza, e la scelta dei componenti infrastrutturali gioca un ruolo determinante.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!