Iceotope ottiene 26 milioni di dollari per il raffreddamento a liquido nell'era AI

Iceotope, azienda britannica all'avanguardia nel raffreddamento a liquido di precisione, ha annunciato la chiusura di un round di finanziamento Series B da 26 milioni di dollari. L'operazione è stata guidata da Barclays Climate Ventures e Two Seas Capital, con la partecipazione anche di investitori esistenti come ABC Impact, Northern Gritstone, Edinv e British Patient Capital. Questo significativo investimento è destinato a supportare l'espansione della linea di prodotti e del portafoglio brevetti di Iceotope, in un momento in cui l'industria dell'intelligenza artificiale sta spingendo i limiti delle infrastrutture di calcolo.

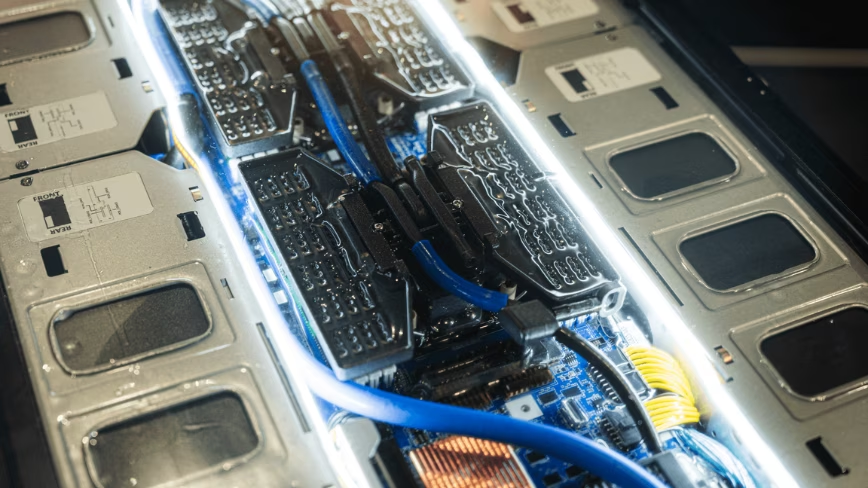

La necessità di soluzioni di raffreddamento avanzate è diventata pressante. L'attuale ciclo di sviluppo dell'hardware AI, caratterizzato da un'elevata densità di componenti nei rack dei data center, sta superando le capacità dei sistemi di raffreddamento ad aria tradizionali. Le GPU di ultima generazione, essenziali per il training e l'Inference dei Large Language Models (LLM), generano quantità di calore sempre maggiori, rendendo indispensabili approcci innovativi alla gestione termica.

Il ruolo strategico del raffreddamento a liquido nell'AI

L'evoluzione dei carichi di lavoro AI richiede una potenza di calcolo senza precedenti, concentrata in spazi sempre più ridotti. Questo si traduce in un aumento esponenziale della densità di potenza per rack, con conseguenti sfide significative per il raffreddamento. I sistemi ad aria, pur essendo stati lo standard per decenni, faticano a dissipare efficacemente il calore prodotto da configurazioni multi-GPU e da server ad alte prestazioni, portando a problemi di throttling, instabilità e, in ultima analisi, a una riduzione della vita utile dell'hardware.

Il raffreddamento a liquido di precisione offre una soluzione mirata, permettendo di rimuovere il calore direttamente dalle sorgenti più critiche, come i processori e le schede grafiche. Questa tecnicia consente di mantenere temperature operative ottimali, migliorando l'affidabilità e le prestazioni dell'hardware AI. Per le organizzazioni che implementano stack locali per LLM, la capacità di gestire efficacemente il calore è fondamentale per massimizzare il throughput e minimizzare la latenza, garantendo al contempo un funzionamento efficiente e sostenibile.

Implicazioni per i deployment on-premise e la sovranità dei dati

L'adozione di soluzioni di raffreddamento a liquido ha implicazioni dirette per le strategie di deployment on-premise. Le aziende che scelgono di mantenere i propri carichi di lavoro AI in ambienti self-hosted o air-gapped, spesso per ragioni di sovranità dei dati, compliance o controllo sul TCO, beneficiano enormemente di queste tecnicie. Il raffreddamento a liquido consente di concentrare una maggiore potenza di calcolo in uno spazio fisico ridotto, ottimizzando l'utilizzo del data center e riducendo i costi operativi legati all'energia.

In un contesto dove la sicurezza e la residenza dei dati sono priorità assolute, la possibilità di implementare infrastrutture AI ad alte prestazioni localmente, senza dipendere da servizi cloud esterni, è un vantaggio competitivo. Il raffreddamento a liquido è un fattore abilitante per questi scenari, permettendo di costruire e gestire cluster di calcolo AI robusti e scalabili direttamente in sede. Per chi valuta i trade-off tra deployment on-premise e cloud, AI-RADAR offre framework analitici su /llm-onpremise per supportare queste decisioni strategiche.

Prospettive future e l'evoluzione dell'infrastruttura AI

L'investimento in Iceotope sottolinea una tendenza più ampia nel settore tecnicico: la crescente importanza delle infrastrutture fisiche che supportano l'avanzamento dell'intelligenza artificiale. Man mano che i Large Language Models diventano più complessi e richiedono risorse di calcolo sempre maggiori, la capacità di raffreddare efficacemente l'hardware diventerà un fattore discriminante per l'innovazione. L'espansione della linea di prodotti e del portafoglio brevetti di Iceotope riflette questa visione strategica, posizionando l'azienda al centro di un mercato in rapida crescita.

Il futuro dell'AI non dipenderà solo dagli algoritmi o dalla potenza dei chip, ma anche dalla capacità di gestire l'ambiente fisico in cui questi operano. Le soluzioni di raffreddamento a liquido, come quelle sviluppate da Iceotope, sono destinate a diventare un componente standard per i data center di nuova generazione, garantendo che le promesse dell'intelligenza artificiale possano essere realizzate su scala, con efficienza e affidabilità.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!