Benvenuti alla Scrivania dell'Editore di AI-Radar.

Sono entusiasta di presentarvi la nostra ultima analisi approfondita sul cuore pulsante dell'ingegneria del software moderna.

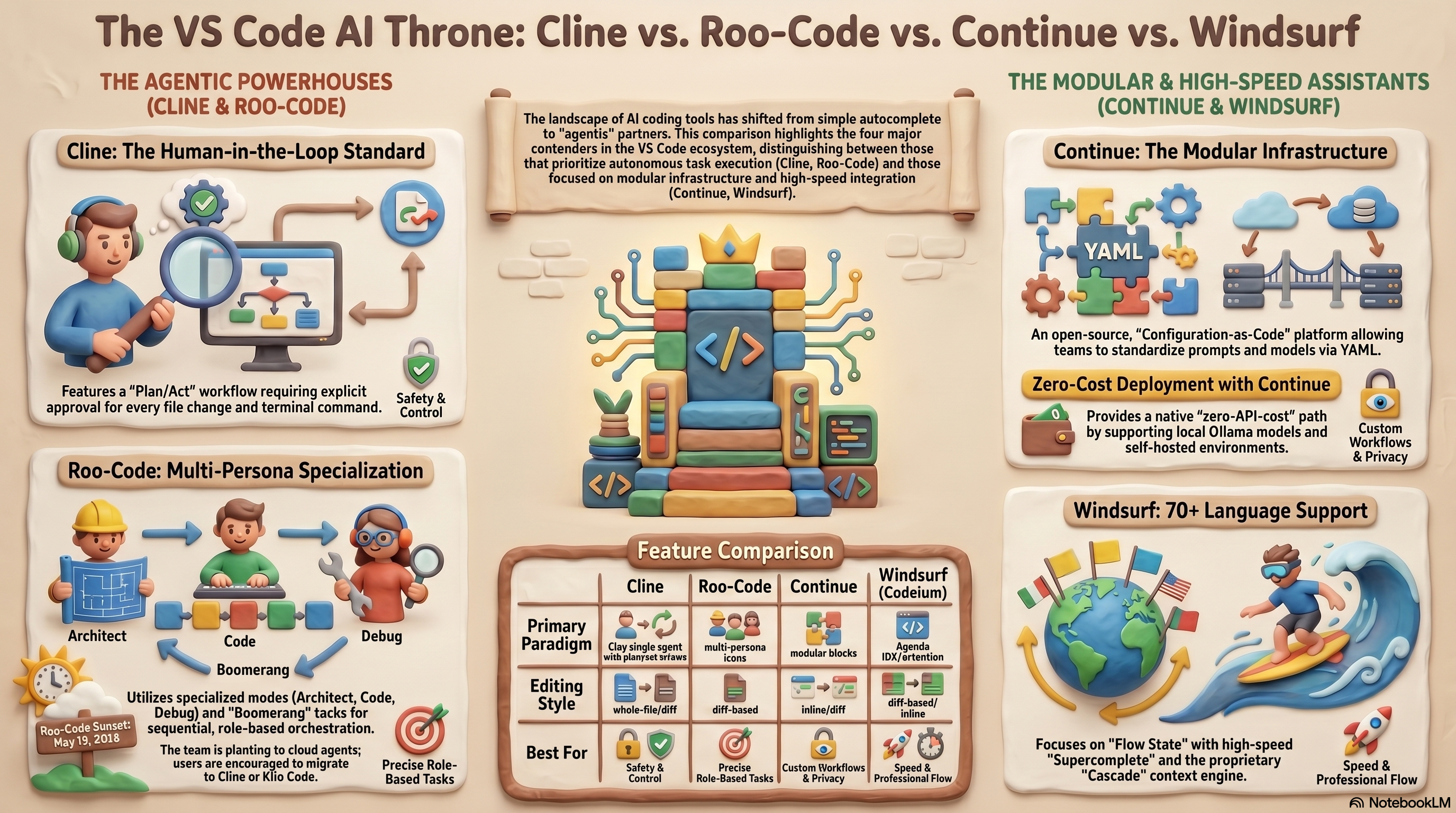

Se nel 2023 mi aveste detto che nel 2026 gli sviluppatori avrebbero passato le loro giornate a "orchestrare" agenti AI invece di digitare furiosamente codice boilerplate, avrei riso. Ma eccoci qui. Oggi, un sorprendente 42% di tutto il nuovo codice è assistito dall'IA, e l'85% degli sviluppatori si affida regolarmente a strumenti AI. Abbiamo superato l'era dell'autocomplete glorificato. Siamo ora saldamente nell'era dell'IDE agentico, dove gli strumenti non si limitano a prevedere la riga di codice successiva, ma leggono autonomamente codebase, eseguono comandi da terminale e redigono complesse pull request.

Ma questa rivoluzione ha generato una nuova crisi sia per gli sviluppatori che per i leader IT: Il Dilemma di VS Code.

Abbandoni il tuo ambiente Visual Studio Code attentamente curato per un fork elegante e nativo AI come Windsurf o Cursor? Oppure rafforzi la tua configurazione VS Code esistente con potenti estensioni "bring-your-own-key" (BYOK) come Cline, Roo Code e Continue?

In questo editoriale completo, mettiamo sotto la lente d'ingrandimento i principali contendenti—Continue, Cline, Roo-Code e Codeium (Windsurf). Esploreremo i loro pro e contro, dissezioneremo le loro filosofie architettoniche e, soprattutto, li analizzeremo attraverso una lente Enterprise e On-Premise. Perché ammettiamolo: dare a un'IA autonoma pieno accesso al tuo codice proprietario in ambito sanitario o della difesa è un po' come dare a un bambino un trapano elettrico—il lavoro viene fatto velocemente, ma devi davvero tenerlo d'occhio.

Prendi il caffè. Incoroniamo un re.

Il Cambiamento di Paradigma: Da Copilot ad Agenti Autonomi

Prima di dissezionare gli strumenti, dobbiamo comprendere il campo di battaglia. Il mercato si è frammentato in filosofie distinte:

IDE Nativi AI (I Fork): Strumenti come Windsurf (di Codeium) che "forkano" l'architettura di VS Code per ricostruire l'editor con l'IA al suo centro. Offrono integrazioni profonde e native con l'editor ma ti costringono a migrare a una nuova applicazione.

Estensioni BYOK: Strumenti come Cline, Roo Code e Continue. Vivono nella tua sidebar di VS Code esistente come estensioni. Porti le tue chiavi API, mantieni il tuo editor attuale e conservi il controllo assoluto sui modelli che utilizzi.

L'attrito tra questi due approcci è il dibattito che definisce il 2026. Incontriamo i contendenti.

- Cline: Il Collaboratore Premuroso (e Trasparente)

Cline (precedentemente Claude Dev) è il campione in carica del mondo delle estensioni open-source, vantando oltre 5 milioni di installazioni. Funziona come estensione della sidebar di VS Code e si basa interamente su un modello BYOK, il che significa che inserisci le tue chiavi API (Anthropic, OpenAI, Gemini, DeepSeek o Ollama locale).

La Filosofia: Human-in-the-Loop

L'architettura di Cline si basa su una metodologia "Plan and Act". Non si limita a procedere "alla cieca" nel tuo repository. Analizza lo spazio di lavoro, propone un piano dettagliato e attende esplicitamente la tua approvazione prima di scrivere su un file o eseguire un comando da terminale.

I Pro

Estensibilità Ineguagliabile: Cline è stato un pioniere nell'adozione del Model Context Protocol (MCP). Attraverso l'MCP Marketplace, puoi estendere le capacità di Cline per recuperare ticket Jira, gestire istanze AWS EC2 o interrogare database Postgres.

Flessibilità del Modello Massima: Poiché non sei vincolato all'abbonamento di un fornitore, puoi usare Claude 3.7 Sonnet per architetture complesse e passare a un modello locale economico per refactoring di base.

Privacy per Impostazione Predefinita: Il tuo codice va esattamente dove la tua chiave API gli dice di andare. Non c'è nessun intermediario che raccoglie la tua telemetria.

I Contro

La Trappola dei Costi: Poiché Cline fornisce un contesto profondo all'LLM per ogni azione, è incredibilmente affamato di token. Gli utenti intensivi possono accidentalmente bruciare da 50 a 200 dollari al mese in costi API.

Nessun Autocompletamento Inline: Cline è un agente, non un motore di autocompletamento. Se desideri quell'esperienza magica di "premi Tab per finire il mio pensiero", dovrai abbinarlo a un altro strumento.

Il Fattore "Andiamo sul Nucleare": A volte, se la finestra di contesto si confonde, Cline potrebbe proporre una riscrittura massiccia e non richiesta della tua logica di gestione dello stato. Devi tenerlo al guinzaglio corto.

- Roo Code: L'Innovatore Multi-Persona (e Sopravvissuto)

Roo Code ha iniziato la sua vita come un fork comunitario di Cline, costruito per affrontare alcune delle limitazioni dello strumento originale. Ha rapidamente guadagnato un enorme seguito di culto, superando 1,5 milioni di installazioni, introducendo le Modalità Personalizzate.

La Filosofia: Esecuzione Basata sui Ruoli

Invece di un agente generico che cerca di fare tutto, Roo Code divide la sua intelligenza in persona specializzate:

Architetto: Pianifica modifiche complesse senza toccare una singola riga di codice.

Codice: Esegue i diff.

Debug: Diagnostica i problemi e isola le cause principali.

Chiedi: Spiega la funzionalità senza rischiare modifiche accidentali.

I Pro

Modifiche Mirate Basate su Diff: A differenza delle prime versioni di Cline che faticavano con le sostituzioni di file interi, Roo Code utilizza un editing ottimizzato basato su diff, che riduce drasticamente l'utilizzo di token e accelera le modifiche ai file.

Modelli Persistenti: Puoi assegnare un modello pesante e costoso (come Opus) alla modalità Architetto, e un modello veloce ed economico (come Haiku o DeepSeek) alla modalità Codice.

Guidato dalla Comunità: Roo Code presenta un vivace marketplace per la condivisione di prompt e modalità personalizzate.

I Contro (e Il Dramma)

Il Pivot di Sunset: Nell'aprile 2026, il team aziendale originale dietro Roo Code ha annunciato che avrebbe dismesso l'estensione per passare a un agente basato su cloud chiamato "Roomote", affermando con sicurezza che "gli IDE non sono il futuro della codifica".

Incertezza sulla Manutenzione: Sebbene un appassionato team della comunità sia immediatamente intervenuto per rilevare il repository open-source, i leader aziendali sono spesso riluttanti ad adottare strumenti che hanno recentemente subito una tale brusca turbolenza organizzativa. (Nota: Kilo Code è emerso come un fork pesantemente finanziato che cerca di reclamare la corona abbandonata di Roo).

- Continue.dev: La Potenza Modulare RAG

Continue.dev adotta un approccio fondamentalmente diverso al contesto. Mentre Cline e Roo Code si affidano pesantemente all'inserimento di file manualmente taggati nella finestra di contesto dell'LLM, Continue mira a costruire una comprensione persistente e semantica dell'intero repository.

La Filosofia: Configuration-as-Code e Ricerca Semantica

Continue è altamente modulare, configurato interamente tramite un file YAML locale (config.yaml). La sua arma segreta è l'architettura RAG (Retrieval-Augmented Generation) sottostante, alimentata da LanceDB. Continue analizza il tuo codebase in Abstract Syntax Trees (AST), incorpora i chunk e li memorizza in LanceDB direttamente sul tuo disco.

I Pro

Contesto "Just-in-Time": Quando fai una domanda a Continue, LanceDB esegue una ricerca semantica in meno di 10 ms per recuperare solo gli snippet di codice pertinenti, mantenendo l'utilizzo di token incredibilmente basso.

Indipendente dall'IDE: A differenza di Cursor, Continue funziona splendidamente sia in VS Code che negli IDE JetBrains (IntelliJ, PyCharm), rendendolo un favorito per ambienti aziendali con IDE misti.

Supremazia degli LLM Locali: Continue è probabilmente il miglior strumento sul mercato per la connessione a modelli locali tramite Ollama o vLLM.

I Contro

Attrito di Configurazione: Continue richiede una configurazione tecnica significativamente maggiore rispetto ai suoi concorrenti. Modificare file YAML e configurare modelli di embedding non è per i deboli di cuore.

Finitura dell'Interfaccia Utente: L'interfaccia e i motori di rendering dei diff sono occasionalmente citati dagli sviluppatori come leggermente più buggati o meno rifiniti rispetto a Cursor o Roo Code.

- Codeium (e Windsurf): Il Demone della Velocità Enterprise

Codeium è una bestia affascinante. Esiste sia come estensione gratuita estremamente popolare su oltre 40 IDE, sia ora, come Windsurf, un fork autonomo di VS Code nativo AI progettato per competere testa a testa con Cursor.

La Filosofia: Stato di Pipeline e Automazione

Codeium crede nel flusso di lavoro ininterrotto dello sviluppatore. In seguito alla sua acquisizione da parte di OpenAI (o della sua società madre Cognition AI, a seconda della cronologia aziendale), Windsurf è stato costruito per dare priorità alla velocità pura e all'autonomia agentica profonda tramite il suo motore Cascade.

I Pro

Velocità Fulminea: Il modello proprietario SWE-1.5 di Codeium vanta latenze di autocompletamento inferiori a 150 ms—una frazione del tempo impiegato dalle API cloud standard per rispondere.

Agente Cascade: L'agente di Windsurf crea un "Grafo di Consapevolezza" persistente del tuo repository. Può correggere automaticamente gli errori di linting, eseguire comandi da terminale e coordinare complessi refactoring multi-file quasi istantaneamente.

Prezzi: A 15 dollari al mese per il livello Pro (e un livello gratuito incredibilmente generoso), riduce significativamente i prezzi di Cursor pur offrendo funzionalità comparabili.

I Contro

La Scatola Nera: Windsurf è proprietario. A differenza di Cline o Continue, hai meno visibilità su quale contesto l'agente stia esattamente iniettando nei suoi prompt.

Ecosistema del Fornitore: Man mano che la piattaforma si integra più profondamente con i modelli della sua società madre, il supporto per modelli di terze parti (come Claude di Anthropic) ha occasionalmente passato in secondo piano su certi livelli.

Il Dilemma Esecutivo: L'IA da una Prospettiva On-Premise

Per gli hobbisti, scegliere uno strumento AI riguarda l'UX. Per gli Architetti Enterprise nei settori farmaceutico, della difesa o della finanza, è una questione di sopravvivenza legale. Quando un singolo algoritmo proprietario trapelato potrebbe costare milioni, l'offerta SaaS standard è una squalifica automatica.

Dobbiamo valutare questi strumenti attraverso la lente della Sovranità dei Dati, della Conformità e delle implementazioni On-Premise.

- Codeium Enterprise: Il Golia Chiavi in Mano

Codeium ha aggressivamente conquistato il mercato enterprise. Codeium Enterprise può essere implementato interamente on-premise air-gapped o all'interno di un VPC. Attraverso partnership con Dell e VMware Private AI Foundation, le aziende possono eseguire Codeium sul proprio hardware (ad esempio, Dell PowerEdge R760xa con GPU NVIDIA L40).

- Tabnine: Il Purista della Privacy

Tabnine merita una menzione d'onore qui. Essendo uno dei primi attori, Tabnine è stato costruito da zero per una rigorosa governance aziendale.

- Continue.dev + LLM Locali: Lo Stack Open-Source Sovrano

Per le organizzazioni che desiderano il controllo totale dell'infrastruttura senza pagare le licenze SaaS enterprise, Continue.dev abbinato a modelli locali (tramite Ollama o vLLM) è il santo graal.

Il Vantaggio: Esegui modelli open-weight (come Llama 3 o Qwen) sui tuoi server interni. Continue gestisce l'integrazione con l'IDE. Non costa nulla se non potenza di calcolo ed elettricità.

Il Paradosso dell'Agente LLM Locale

Tuttavia, l'implementazione di AI locali comporta un grave avvertimento: Il Paradosso dell'Agente LLM Locale. Gli strumenti di codifica agentici (come Cline o Roo Code) iniettano prompt di sistema massicci (a volte oltre 15.000 token) pieni di tag XML e istruzioni di tool-calling. Mentre i modelli all'avanguardia (Claude 3.7, GPT-5) li elaborano facilmente, i modelli locali più piccoli (come Qwen 3.6 35B) spesso allucinano la sintassi dello strumento, rimangono bloccati in loop di ragionamento infiniti o producono JSON malformato. Ottenere flussi di lavoro agentici stabili e autonomi su hardware completamente locale richiede ancora significative acrobazie di prompt-engineering.

Matrici Confronto Diretto

Per fare chiarezza, ecco come si presenta il panorama per il 2026.

Tabella 1: Architettura e Pipeline di Lavoro Principali

| Caratteristica | Continue.dev | Cline | Roo-Code | Codeium (Windsurf) |

|---|---|---|---|---|

| Forma Primaria | Estensione (VS Code / JetBrains) | Estensione (VS Code) | Estensione (VS Code) | IDE (VS Code Fork) & Estensione |

| Paradigma AI | Modulare / RAG-centrato | Plan & Act (Human-in-loop) | Modalità Multi-Persona | Agente Autonomo (Cascade) |

| Indicizzazione Codebase | Ricerca Vettoriale AST LanceDB | Regex & @menzioni esplicite | @menzioni esplicite & semantica | "Grafo di Consapevolezza" Profondo |

| Autocompletamento Inline | Sì (tramite configurazione) | No (Solo Chat/Agente) | No (Solo Chat/Agente) | Sì (Supercomplete <150ms) |

| Flessibilità del Modello | Massima (BYOK, Locale, Qualsiasi API) | Alta (BYOK, OpenRouter) | Alta (BYOK, Profili personalizzati) | Curato (Proprietario, GPT, Claude) |

Tabella 2: Prezzi e Valore

| Strumento | Livello Gratuito | Livello a Pagamento / Pro | Prezzi Enterprise | Costi Nascosti / API |

|---|---|---|---|---|

| Continue | 100% Gratuito / OSS | N/A | Variabile (Self-hosted) | Paghi direttamente il tuo fornitore LLM. |

| Cline | 100% Gratuito / OSS | N/A | Contatta Vendite (Hosted) | BYOK. L'uso intenso può raggiungere 100$+ al mese. |

| Roo-Code | 100% Gratuito / OSS | Roo Cloud (5$/ora) | N/A | BYOK. Le modifiche basate su diff risparmiano sui costi dei token. |

| Codeium | 25 crediti Agente/mese | 15$/mese | ~39−60/utente/mese | Nessuno. Tariffa di abbonamento fissa. |

Tabella 3: La Lente On-Premise e della Sicurezza

| Caratteristica | Continue.dev | Cline

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!