L'Evoluzione dei Nodi di Processo: Il Ruolo di Intel 18A-P

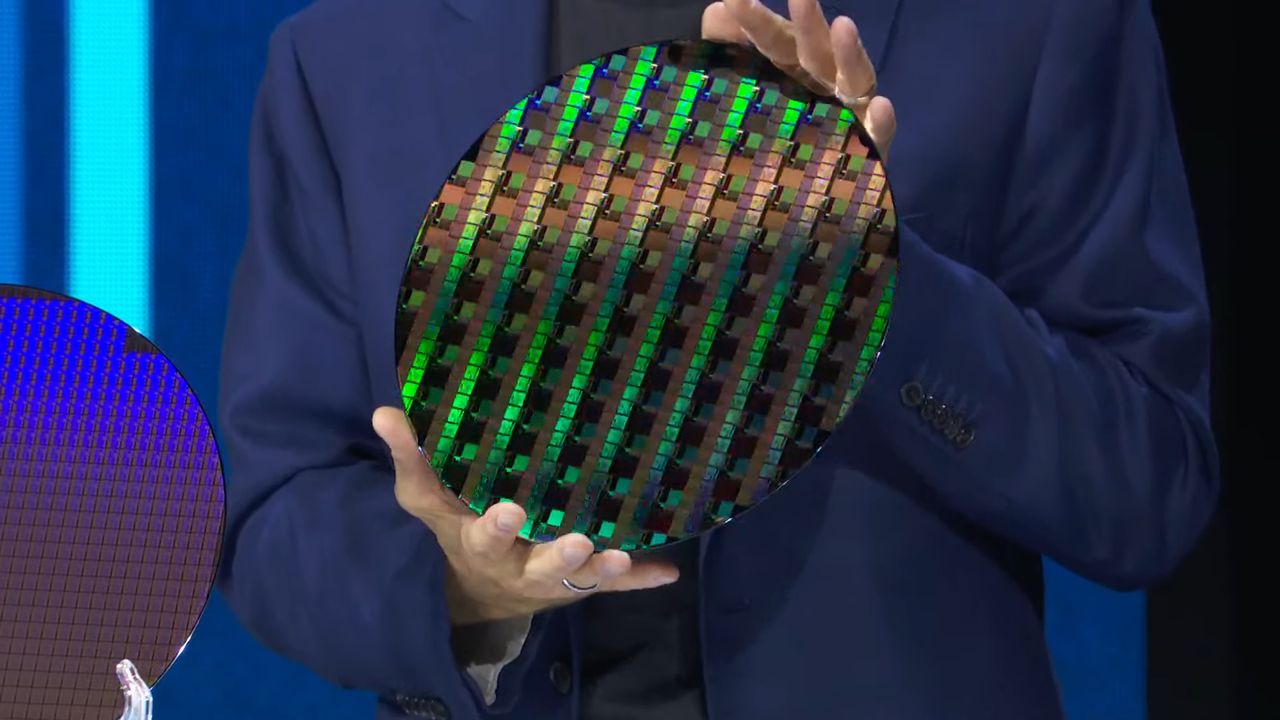

Nel panorama in continua evoluzione della produzione di semiconduttori, i progressi nei nodi di processo rappresentano un fattore determinante per le prestazioni e l'efficienza dei chip. Intel, attore storico in questo settore, ha recentemente fornito nuovi dettagli sul suo nodo di processo 18A-P, un'innovazione che promette di ridefinire gli standard per le future generazioni di processori. Questi sviluppi sono di particolare interesse per le aziende che gestiscono carichi di lavoro intensivi, come quelli legati ai Large Language Models (LLM), e che valutano strategie di deployment on-premise.

La capacità di integrare più transistor in spazi sempre più ridotti, migliorando al contempo le loro caratteristiche operative, è fondamentale per sostenere la domanda crescente di potenza di calcolo. Il nodo 18A-P si posiziona come un passo avanti significativo in questa direzione, con implicazioni dirette per l'architettura dei data center e le strategie di infrastruttura AI.

Dettagli Tecnici: Performance, Consumo e Gestione Termica

I dettagli rilasciati da Intel evidenziano due metriche chiave che sottolineano il potenziale del nodo 18A-P. L'azienda ha dichiarato un incremento del 9% nelle prestazioni, un dato che si traduce in una maggiore capacità di elaborazione per ciclo di clock. Questo miglioramento è essenziale per accelerare l'esecuzione di algoritmi complessi e per ridurre i tempi di latenza nelle operazioni di inference e training degli LLM.

Altrettanto significativo è il miglioramento del 50% nella conduttività termica. Questo aspetto è cruciale per la gestione del calore generato dai processori ad alte prestazioni. Una migliore conduttività termica consente ai chip di operare a temperature più basse o di dissipare il calore in modo più efficiente, contribuendo a ridurre il consumo energetico complessivo e a migliorare l'affidabilità a lungo termine dei componenti. Questi fattori sono vitali per la sostenibilità e l'efficienza operativa dei data center moderni.

Implicazioni per i Deployment On-Premise e il TCO

Per le organizzazioni che privilegiano i deployment on-premise, le innovazioni del nodo 18A-P di Intel offrono vantaggi tangibili. L'aumento delle prestazioni consente di ottenere più potenza di calcolo per unità di rack, migliorando la densità dell'infrastruttura. Parallelamente, la riduzione del consumo energetico e l'ottimizzazione della gestione termica contribuiscono direttamente a un TCO (Total Cost of Ownership) più favorevole. Minori requisiti di raffreddamento e un'efficienza energetica superiore si traducono in costi operativi (OpEx) inferiori, un aspetto fondamentale per chi gestisce infrastrutture su larga scala.

In un contesto dove la sovranità dei dati e la compliance normativa sono priorità assolute, l'adozione di hardware all'avanguardia per soluzioni self-hosted diventa strategica. La capacità di eseguire carichi di lavoro AI complessi su infrastrutture controllate internamente, beneficiando al contempo di efficienza e performance migliorate, rafforza l'argomento a favore dei deployment on-premise. Per chi valuta queste opzioni, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi iniziali (CapEx) e benefici operativi a lungo termine.

Prospettive Future per l'Framework AI

I progressi nei nodi di processo come l'Intel 18A-P sono un pilastro fondamentale per lo sviluppo futuro dell'intelligenza artificiale. Miglioramenti incrementali in performance ed efficienza energetica si sommano nel tempo, abilitando nuove capacità e rendendo i carichi di lavoro AI sempre più accessibili e sostenibili. Questi sviluppi non solo spingono i limiti di ciò che è tecnicamente possibile, ma offrono anche soluzioni concrete alle sfide operative e finanziarie che le aziende affrontano nel deployment di sistemi AI avanzati.

La continua ricerca di maggiore efficienza e prestazioni nel silicio è un motore chiave per l'innovazione, soprattutto per le architetture che supportano gli LLM. L'impegno di Intel in questo campo sottolinea l'importanza di una base hardware robusta e ottimizzata per il successo delle strategie AI, in particolare per quelle che richiedono il massimo controllo e la massima efficienza in ambienti self-hosted e air-gapped.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!