L'assenza di Jensen Huang dalla delegazione in Cina

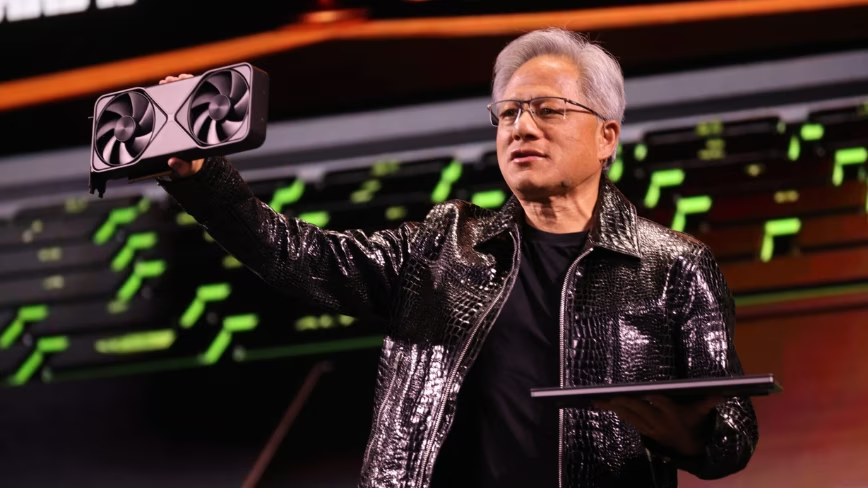

Jensen Huang, CEO di Nvidia, non figura tra i dirigenti statunitensi che prenderanno parte alla delegazione commerciale diretta a Pechino per il vertice tra il Presidente Donald Trump e il Presidente Xi Jinping. La notizia, riportata da Reuters, evidenzia un'assenza significativa da un evento che vede la partecipazione di altre figure di spicco del panorama tecnicico e industriale americano.

Tra i nomi confermati per la missione figurano Tim Cook, CEO di Apple, ed Elon Musk, CEO di Tesla. La delegazione si concentrerà su settori chiave come l'agricoltura, la manifattura e l'aviazione. L'assenza del leader di Nvidia, azienda all'avanguardia nello sviluppo di hardware per l'intelligenza artificiale, solleva interrogativi sulle dinamiche sottostanti le relazioni commerciali e tecniciche tra le due maggiori economie mondiali.

Contesto geopolitico e implicazioni per il settore tech

Le relazioni tra Stati Uniti e Cina sono da tempo caratterizzate da una complessa interazione di cooperazione e competizione, con ricadute dirette sul settore tecnicico. Aziende come Nvidia, che producono componenti cruciali per l'avanzamento dell'IA e del calcolo ad alte prestazioni, si trovano spesso al centro di queste dinamiche. La disponibilità di silicio avanzato e la gestione delle catene di approvvigionamento globali sono aspetti fondamentali che influenzano le strategie di deployment e l'innovazione.

In questo scenario, le decisioni relative alla partecipazione a delegazioni commerciali di alto livello possono riflettere strategie aziendali più ampie, volte a navigare un ambiente geopolitico in continua evoluzione. Per le imprese che dipendono da tecnicie all'avanguardia, la capacità di mantenere l'accesso ai mercati e di garantire la continuità delle proprie pipeline produttive è essenziale, specialmente quando si considerano le opzioni di deployment on-premise o in cloud.

Le dinamiche del mercato e la strategia di Nvidia

Nvidia detiene una posizione dominante nel mercato delle GPU, componenti indispensabili per il training e l'inference dei Large Language Models (LLM) e per altre applicazioni di intelligenza artificiale. La sua strategia di mercato è intrinsecamente legata alla capacità di operare efficacemente in contesti internazionali, bilanciando opportunità di crescita e potenziali restrizioni.

Le scelte di deployment per i carichi di lavoro AI, che spaziano dal cloud pubblico a soluzioni self-hosted o air-gapped, sono spesso influenzate non solo da considerazioni tecniche come la VRAM o il throughput, ma anche da fattori macroeconomici e geopolitici. Il Total Cost of Ownership (TCO) di un'infrastruttura AI, ad esempio, può essere significativamente impattato dalla disponibilità di hardware e dalle politiche commerciali tra paesi.

Prospettive future per i deployment AI

L'ecosistema dell'intelligenza artificiale continua a evolversi rapidamente, con un crescente interesse verso soluzioni che garantiscano maggiore controllo e sovranità dei dati. Questo spinge molte organizzazioni a valutare attentamente i pro e i contro dei deployment on-premise rispetto alle offerte cloud. La necessità di conformità normativa, la sicurezza dei dati e la personalizzazione dell'infrastruttura sono fattori determinanti.

In un contesto dove le tensioni geopolitiche possono influenzare la disponibilità di tecnicie chiave, la pianificazione strategica diventa cruciale per CTO e architetti di infrastruttura. AI-RADAR, ad esempio, offre framework analitici su /llm-onpremise per aiutare a valutare i trade-off tra diverse architetture di deployment, considerando aspetti come la scalabilità, la latenza e i requisiti hardware specifici, indipendentemente dalle decisioni di singole figure aziendali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!