Kakao Mobility accelera sulla mobilità autonoma con robotaxi di Livello 4

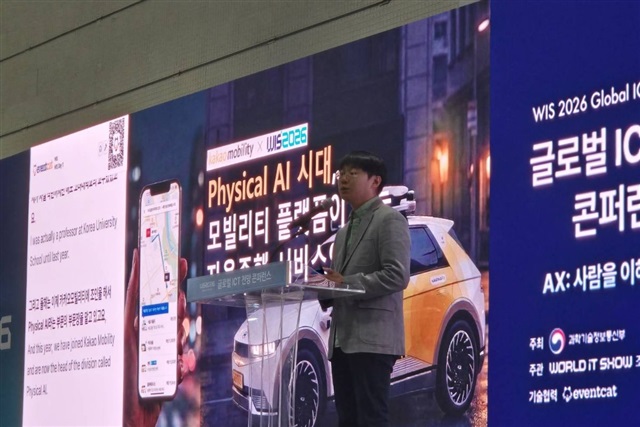

Kakao Mobility ha recentemente annunciato un passo significativo nel settore della mobilità autonoma con il lancio di un robotaxi di Livello 4. Questa iniziativa, che rientra nell'ambito del potenziamento della sua piattaforma di intelligenza artificiale, è guidata da Kim Jin-kyu, a capo della divisione Physical AI dell'azienda. L'introduzione di veicoli a guida autonoma di Livello 4 rappresenta una pietra miliare tecnicica, indicando la capacità del sistema di operare in modo completamente autonomo in condizioni specifiche, senza la necessità di intervento umano.

Questo sviluppo non solo sottolinea l'ambizione di Kakao Mobility nel ridefinire il futuro dei trasporti, ma evidenzia anche le crescenti complessità e i requisiti infrastrutturali associati al deployment di soluzioni AI avanzate su larga scala. La transizione verso una mobilità completamente autonoma richiede un'infrastruttura di supporto robusta e scalabile, capace di gestire enormi volumi di dati e di eseguire complessi modelli di intelligenza artificiale in tempo reale.

Le sfide dell'AI per la mobilità autonoma

Un robotaxi di Livello 4 implica che il veicolo è in grado di gestire tutte le dinamiche di guida in determinate condizioni operative, dal traffico urbano alla navigazione in scenari complessi. Per raggiungere questo livello di autonomia, sono necessari sistemi di intelligenza artificiale estremamente sofisticati, che includono percezione ambientale, pianificazione del percorso e capacità decisionali rapide. Questi sistemi si basano su Large Language Models (LLM) e altri modelli di machine learning che richiedono una notevole potenza di calcolo per l'inference direttamente a bordo del veicolo, spesso su hardware specializzato con elevate quantità di VRAM e throughput.

Il fine-tuning continuo di questi modelli è altrettanto cruciale. I dati raccolti dalla flotta di robotaxi devono essere processati, annotati e utilizzati per migliorare le performance degli algoritmi. Questo processo genera una pipeline di dati e di training intensiva, che necessita di infrastrutture capaci di gestire petabyte di informazioni e di eseguire cicli di training su cluster di GPU ad alte prestazioni. La latenza e la precisione sono parametri critici, sia per le decisioni in tempo reale del veicolo sia per l'efficacia del processo di aggiornamento dei modelli.

Implicazioni per il Deployment e il TCO

La decisione di scalare una piattaforma AI per la mobilità autonoma solleva interrogativi fondamentali sulle strategie di deployment. Le aziende come Kakao Mobility devono valutare attentamente i trade-off tra l'adozione di soluzioni cloud e l'implementazione di infrastrutture self-hosted o ibride. Il deployment on-premise offre vantaggi significativi in termini di sovranità dei dati, controllo diretto sull'hardware e la possibilità di creare ambienti air-gapped per la massima sicurezza, aspetti cruciali quando si gestiscono dati sensibili relativi alla mobilità e alla privacy degli utenti.

Tuttavia, un'infrastruttura on-premise comporta un investimento iniziale (CapEx) più elevato e una gestione operativa complessa. L'analisi del Total Cost of Ownership (TCO) diventa quindi un fattore determinante, considerando non solo i costi hardware e software, ma anche l'energia, il raffreddamento e il personale specializzato. Per l'inference a bordo dei veicoli, l'edge computing è la soluzione obbligata, ma il training e la gestione dei dati a livello di flotta possono beneficiare di un approccio ibrido, bilanciando la flessibilità del cloud con il controllo e la sicurezza dell'on-premise. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise per valutare questi trade-off.

Prospettive future e considerazioni strategiche

L'evoluzione verso i robotaxi di Livello 4 e oltre richiederà un'innovazione continua non solo nei modelli AI, ma anche nell'infrastruttura sottostante. La capacità di integrare rapidamente nuove generazioni di LLM, di gestire dataset sempre più ampi e di garantire un'operatività ininterrotta sarà fondamentale. Le aziende dovranno investire in soluzioni di storage ad alta velocità, networking a bassa latenza e cluster di calcolo scalabili, spesso basati su GPU di ultima generazione.

La complessità di gestire una flotta di veicoli autonomi, ciascuno dei quali genera e processa dati in tempo reale, rende l'architettura di deployment una componente strategica critica. La scelta tra un'infrastruttura bare metal, virtualizzata o containerizzata avrà un impatto diretto sulla flessibilità, sulla scalabilità e sul TCO complessivo. Il successo in questo settore dipenderà dalla capacità di bilanciare innovazione tecnicica, efficienza operativa e conformità normativa, garantendo al contempo la sicurezza e l'affidabilità dei sistemi autonomi.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!