L'esigenza di connettività ad alta velocità per l'AI

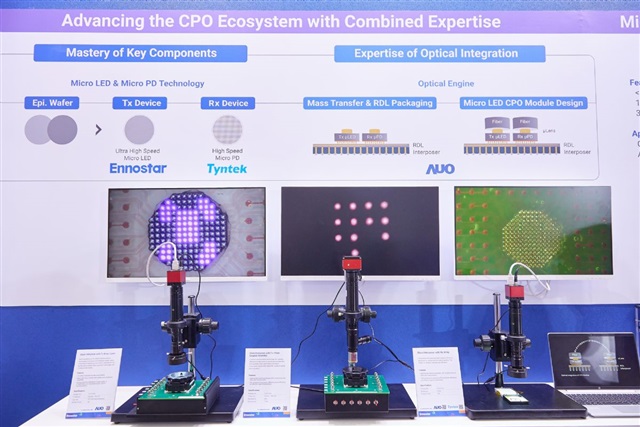

Il panorama tecnicico attuale è dominato dalla rapida espansione dell'intelligenza artificiale, con i Large Language Models (LLM) che rappresentano una delle applicazioni più esigenti in termini di risorse computazionali. La gestione di questi carichi di lavoro non si limita alla potenza di calcolo delle GPU, ma si estende in modo cruciale alla capacità dell'infrastruttura di rete di supportare un trasferimento dati massivo e a bassa latenza. È in questo contesto che si inserisce l'interesse crescente dei fornitori taiwanesi di Micro LED, che stanno orientando i loro sforzi verso lo sviluppo di collegamenti ottici specifici per i data center AI.

Questa tendenza riflette una consapevolezza diffusa nel settore: l'efficienza e la scalabilità dei data center AI dipendono intrinsecamente dalla velocità con cui i dati possono viaggiare tra i vari componenti, dalle GPU ai sistemi di storage. La capacità di elaborare e spostare terabyte di dati al secondo è diventata un collo di bottiglia critico, spingendo l'innovazione verso soluzioni di connettività più performanti e meno energivore.

I collegamenti ottici: una risposta alle sfide della banda larga

I collegamenti ottici, basati sulla trasmissione di segnali luminosi attraverso fibre, offrono vantaggi significativi rispetto ai tradizionali cavi in rame, specialmente in ambienti ad alta densità come i data center AI. La fibra ottica garantisce una banda passante (throughput) notevolmente superiore, consentendo il trasferimento simultaneo di volumi di dati molto più grandi. Questo è fondamentale per il training di LLM complessi, dove milioni di parametri devono essere scambiati tra centinaia o migliaia di GPU in parallelo.

Oltre alla maggiore capacità, i collegamenti ottici riducono drasticamente la latenza, un fattore critico per le operazioni di inference in tempo reale e per l'efficienza dei framework di parallelizzazione distribuiti. La loro immunità alle interferenze elettromagnetiche e la capacità di coprire distanze maggiori senza degrado del segnale li rendono ideali per architetture di data center su larga scala. L'impegno dei fornitori di Micro LED in questo settore suggerisce un'evoluzione nei componenti chiave di questi collegamenti, puntando a soluzioni ancora più efficienti e compatte.

Implicazioni per i deployment on-premise e la sovranità dei dati

Per le organizzazioni che scelgono di implementare carichi di lavoro AI e LLM in ambienti self-hosted o on-premise, la qualità dell'infrastruttura di rete è un pilastro fondamentale. A differenza delle soluzioni cloud, dove la complessità della rete è astratta dal fornitore, un deployment on-premise richiede decisioni strategiche e investimenti diretti in hardware di connettività. L'adozione di collegamenti ottici avanzati diventa quindi essenziale per garantire che l'infrastruttura locale possa competere in termini di performance e scalabilità con le offerte cloud.

Queste scelte infrastrutturali hanno un impatto diretto sul Total Cost of Ownership (TCO), influenzando non solo il CapEx iniziale, ma anche l'OpEx legato al consumo energetico e al raffreddamento. Una rete ottica efficiente può ridurre i costi operativi a lungo termine, contribuendo a un TCO più favorevole. Inoltre, per le aziende con stringenti requisiti di sovranità dei dati, compliance (come il GDPR) o la necessità di operare in ambienti air-gapped, un'infrastruttura on-premise robusta e performante, supportata da tecnicie di connettività all'avanguardia, è indispensabile per mantenere il pieno controllo sui propri asset informativi. Per chi valuta deployment on-premise, l'analisi di queste tecnicie è cruciale. AI-RADAR, ad esempio, offre framework analitici su /llm-onpremise per supportare la valutazione dei trade-off tra diverse soluzioni infrastrutturali.

Prospettive future e l'evoluzione dell'infrastruttura AI

L'investimento dei fornitori taiwanesi di Micro LED nei collegamenti ottici per i data center AI è un indicatore chiaro della direzione che sta prendendo l'infrastruttura per l'intelligenza artificiale. Man mano che i modelli diventano più grandi e complessi, e le esigenze di training e inference si intensificano, la capacità della rete di gestire il flusso di dati diventerà sempre più un fattore limitante. L'innovazione in questo campo è quindi non solo desiderabile, ma necessaria per sbloccare il pieno potenziale delle future generazioni di AI.

Questa competizione e l'orientamento verso soluzioni ottiche più performanti e a basso consumo energetico sono cruciali per l'evoluzione dell'intero ecosistema AI. Le decisioni strategiche relative all'infrastruttura di rete, in particolare per i deployment on-premise, richiederanno un'attenta valutazione dei trade-off tra costi, performance, scalabilità e requisiti di sicurezza e sovranità dei dati. L'adozione di tecnicie come i collegamenti ottici rappresenta un passo fondamentale per costruire data center AI resilienti e pronti per il futuro.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!