L'AI all'Edge: Tra Cloud e Sovranità dei Dati

L'intelligenza artificiale sta rapidamente ridefinendo il nostro modo di lavorare e vivere. Tuttavia, gran parte di questa intelligenza rimane ancora legata al cloud, accessibile tramite API e interfacce web. Questo modello, sebbene efficace per molti scenari, non sempre si adatta alle esigenze emergenti delle aziende.

Sempre più spesso, le organizzazioni cercano di portare l'AI più vicino al punto di utilizzo effettivo, ovvero su dispositivi edge come wearable, telecamere intelligenti e altri sistemi a basso consumo energetico. L'esecuzione locale dell'AI offre vantaggi significativi, tra cui la riduzione della latenza, il miglioramento della privacy e la possibilità di sbloccare nuove capacità in tempo reale. Tuttavia, introduce anche una sfida complessa: come eseguire modelli complessi in modo efficiente su hardware con risorse limitate in termini di memoria, potenza di calcolo e consumo energetico? È in questo contesto che si inserisce ExecuTorch, un'estensione dell'ecosistema PyTorch progettata per affrontare proprio queste problematiche, portando l'inference AI direttamente all'edge.

ExecuTorch su CPU Arm: Efficienza e Ottimizzazione

PyTorch è diventato un framework di riferimento per il training e l'inference di modelli AI nel cloud. ExecuTorch estende questo ecosistema per abilitare l'inference AI locale sui dispositivi edge. Il processo prevede l'esportazione di un modello PyTorch in un formato leggero, il .pte, che contiene sia i pesi del modello sia un grafo di calcolo statico. Questo approccio elimina la necessità di Python a runtime e riduce l'overhead di esecuzione dinamica, superfluo per l'inference.

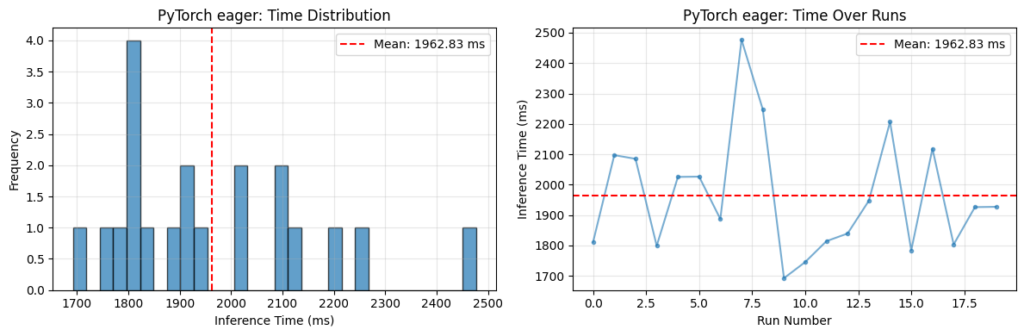

Il passo successivo all'esportazione è il lowering, dove il grafo del modello viene trasformato in una forma compatibile con il backend hardware. È qui che inizia l'ottimizzazione specifica per l'hardware. Il risultato è un artefatto leggero, portatile, con esecuzione prevedibile e adatto per il deployment su sistemi con risorse limitate. Anche su dispositivi come il Raspberry Pi 5, che possono eseguire modelli PyTorch senza ExecuTorch, si possono ottenere miglioramenti significativi delle performance. ExecuTorch raggiunge queste performance delegando parti del modello a backend ottimizzati, come XNNPACK per le CPU Arm. Quando abilitato, operatori supportati come convoluzioni e moltiplicazioni di matrici vengono delegati a implementazioni altamente ottimizzate che sfruttano i microkernel KleidiAI e le funzionalità architetturali Neon. È fondamentale notare che la selezione del backend è cruciale: senza un backend ottimizzato come XNNPACK, ExecuTorch potrebbe non superare PyTorch in termini di latenza, pur mantenendo i benefici di un footprint ridotto e una maggiore portabilità. I test su un modello transformer OPT-125M su Raspberry Pi 5 hanno mostrato una riduzione della latenza con ExecuTorch e XNNPACK, sebbene sia stato osservato un aumento della latenza nelle esecuzioni prolungate, attribuito a effetti termici sulla CPU del Raspberry Pi 5 senza raffreddamento attivo.

Accelerazione Hardware con NPU Arm Ethos-U e TOSA

Per spingersi oltre l'ottimizzazione su CPU, è possibile sfruttare l'accelerazione hardware offerta dalle NPU Arm Ethos-U, spesso abbinate a CPU Cortex-A o Cortex-M. In questo scenario, l'esecuzione diventa eterogenea: ExecuTorch partiziona il grafo del modello, delegando i sottografi supportati alla NPU e facendo ricadere gli operatori non supportati sulla CPU. Le NPU Ethos-U operano tipicamente su modelli quantizzati a interi (spesso INT8), rendendo la quantization un passaggio obbligatorio prima della delega. Questo processo utilizza EthosUQuantizer e una compile_spec specifica per il target Ethos-U, seguendo il flusso di quantization PyTorch 2 Export (PT2E).

Un passaggio chiave è il lowering del modello in TOSA (Tensor Operator Set Architecture), una rappresentazione intermedia progettata per fare da ponte tra i framework di alto livello e i backend hardware. TOSA offre un set di operatori stabile e agnostico dall'hardware, semplificando l'implementazione per i fornitori di hardware. L'API to_edge_transform_and_lower, specificando EthosUPartitioner, serializza il modello in TOSA e utilizza Vela per produrre un flusso di comandi ottimizzato per l'esecuzione sulla NPU. Infine, to_executorch(...) impacchetta il risultato in un file .pte. Comprendere questo flusso è essenziale per analizzare le performance: una delega efficiente si traduce in sottografi ampi e contigui eseguiti sulla NPU. La presenza di operatori non supportati può frammentare il grafo, portando a sottografi più piccoli e a un aumento dell'overhead dovuto a frequenti transizioni tra CPU e NPU. Strumenti come Google Model Explorer, con adattatori sviluppati da Arm, consentono di ispezionare il grafo ExecuTorch (.pte) e visualizzare come viene partizionato tra i backend, oltre a esaminare la rappresentazione TOSA (.tosa), fornendo una visibilità cruciale per le decisioni di ottimizzazione.

Implicazioni per i Deployment On-Premise e Prossimi Passi

La capacità di eseguire modelli AI in modo efficiente su dispositivi edge ha implicazioni significative per le aziende che valutano strategie di deployment on-premise o ibride. Per CTO, DevOps lead e architetti infrastrutturali, la possibilità di mantenere il controllo sui dati, garantire la compliance e operare in ambienti air-gapped è un fattore determinante. I deployment all'edge, abilitati da soluzioni come ExecuTorch, contribuiscono a ridurre la dipendenza dal cloud, offrendo maggiore sovranità dei dati e potenzialmente un TCO più vantaggioso nel lungo termine, bilanciando i costi iniziali (CapEx) con i costi operativi (OpEx).

Per familiarizzare con questi concetti, Arm ha rilasciato una collezione di laboratori Jupyter pratici, progettati per consentire agli sviluppatori di eseguire e modificare il codice sul proprio hardware. Questi laboratori offrono un punto di ingresso concreto per gli sviluppatori ML già esperti di PyTorch o per gli ingegneri embedded che stanno costruendo le proprie basi di Machine Learning. Costruire modelli è solo metà del lavoro; farli funzionare in modo efficiente all'edge è ciò che conta, e ExecuTorch, insieme a queste risorse pratiche, mostra come iniziare rapidamente, comprendendo i concetti sottostanti. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra soluzioni self-hosted e cloud, considerando aspetti come performance, sicurezza e costi.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!