L'AI basata su agenti ridefinisce le esigenze hardware

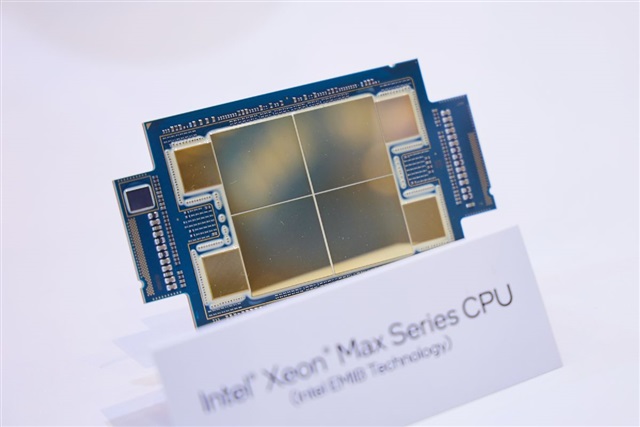

L'avanzamento dell'intelligenza artificiale, in particolare nel campo dell'AI basata su agenti, sta innescando un'evoluzione significativa nelle richieste hardware del settore. Secondo quanto riportato da DIGITIMES, si osserva un'impennata nella domanda di unità di elaborazione centrale (CPU), un segnale che le architetture tradizionali basate prevalentemente su GPU potrebbero non essere sempre sufficienti per le nuove tipologie di carichi di lavoro.

Questa tendenza non si limita solo alle CPU generiche, ma si estende anche ai produttori di circuiti integrati specifici per applicazioni (ASIC) e a quelli specializzati in chip di nicchia. L'AI basata su agenti, che implica sistemi capaci di pianificare, ragionare ed eseguire compiti complessi in autonomia, richiede spesso un'orchestrazione più sofisticata e un'elaborazione sequenziale che le CPU sono in grado di gestire con efficienza, complementando il ruolo delle GPU nell'elaborazione parallela intensiva.

Il ruolo crescente dei processori e dei chip specializzati

Mentre i Large Language Models (LLM) tradizionali beneficiano enormemente della capacità di calcolo parallelo delle GPU per l'inference e il training, i sistemi di AI basata su agenti introducono nuove sfide. Questi agenti spesso interagiscono con vari strumenti, API e basi di conoscenza, richiedendo una gestione della memoria più dinamica, decisioni sequenziali e un'elaborazione del controllo di flusso che può essere più adatta alle CPU. Le CPU eccellono in queste operazioni, fornendo la flessibilità necessaria per gestire le diverse fasi di un workflow agentico, dalla pianificazione all'esecuzione e al monitoraggio.

Parallelamente, la crescente domanda sta stimolando il mercato degli ASIC e dei chip di nicchia. Questi componenti sono progettati per ottimizzare le prestazioni e l'efficienza energetica per compiti specifici, offrendo un vantaggio significativo in termini di Total Cost of Ownership (TCO) per carichi di lavoro AI ripetitivi o altamente specializzati. Per le aziende che cercano di ottimizzare i loro deployment on-premise, l'integrazione di ASIC o altri acceleratori dedicati può rappresentare una strategia chiave per bilanciare performance e costi operativi, riducendo il consumo energetico e l'ingombro fisico.

Implicazioni per i deployment on-premise e la sovranità dei dati

Per CTO, DevOps lead e architetti infrastrutturali, questa evoluzione del panorama hardware ha implicazioni dirette sulle decisioni di deployment. La necessità di supportare l'AI basata su agenti spinge verso architetture infrastrutturali più eterogenee, dove CPU, GPU e chip specializzati coesistono per massimizzare l'efficienza complessiva. La valutazione del TCO diventa ancora più critica, considerando non solo il costo iniziale (CapEx) ma anche le spese operative (OpEx) legate a energia, raffreddamento e manutenzione di un mix di hardware diversificato.

I deployment on-premise, spesso scelti per ragioni di sovranità dei dati, compliance e sicurezza in ambienti air-gapped, beneficiano particolarmente di questa flessibilità hardware. La possibilità di selezionare e combinare componenti specifici consente alle organizzazioni di costruire infrastrutture AI su misura che rispondano precisamente ai loro requisiti di performance, sicurezza e controllo, senza dipendere esclusivamente dalle offerte standardizzate del cloud. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise che possono aiutare a valutare i trade-off tra diverse configurazioni hardware e strategie di deployment.

Prospettive future e strategie di acquisizione hardware

Il futuro dei carichi di lavoro AI, in particolare quelli legati all'AI basata su agenti, suggerisce un'infrastruttura sempre più modulare e adattabile. Le decisioni di acquisizione hardware non potranno più basarsi su un approccio monolitico, ma richiederanno un'analisi approfondita delle specifiche esigenze di ogni componente del sistema AI. Questo include la valutazione della VRAM per i modelli più grandi, la capacità di throughput per l'inference e la latenza per le interazioni in tempo reale, ma anche la robustezza delle CPU per l'orchestrazione e la gestione dei dati.

Le aziende dovranno considerare attentamente i trade-off tra la flessibilità delle CPU generiche, la potenza di calcolo parallelo delle GPU e l'efficienza specifica degli ASIC. L'obiettivo è costruire una pipeline AI resiliente ed economicamente sostenibile, capace di evolvere con le crescenti complessità dell'intelligenza artificiale. Questo approccio strategico è fondamentale per garantire che le infrastrutture self-hosted possano supportare efficacemente le innovazioni future, mantenendo al contempo il controllo sui dati e sui costi operativi.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!