L'Impennata della Domanda per l'Framework AI

L'ascesa esponenziale dell'intelligenza artificiale, in particolare dei Large Language Models (LLM), sta ridefinendo le esigenze infrastrutturali globali. Questa trasformazione non riguarda solo la potenza di calcolo, ma si estende a ogni componente critico che supporta l'operatività di sistemi AI complessi. Un settore che sta vivendo una crescita significativa è quello delle interconnessioni di potenza, elementi fondamentali per garantire l'alimentazione stabile e affidabile delle architetture hardware dedicate all'AI.

In questo scenario, aziende come BizLink e JPC stanno orientando le proprie strategie verso i segmenti di mercato più esigenti. La loro attenzione si concentra sulle soluzioni di fascia alta, progettate per soddisfare i requisiti stringenti imposti dalle nuove generazioni di hardware AI, dove l'efficienza energetica e la capacità di gestire carichi elevati sono parametri non negoziabili.

Le Esigenze Tecniche dell'AI: Oltre la Semplice Potenza

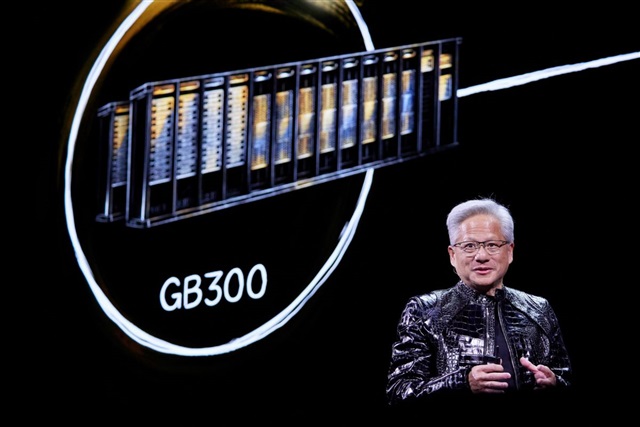

Le moderne architetture AI, specialmente quelle impiegate per il training e l'Inference di LLM su larga scala, richiedono una quantità di energia senza precedenti. GPU di ultima generazione, come le serie H100 o A100, con le loro elevate VRAM e capacità di elaborazione, assorbono potenze considerevoli. Questo si traduce in una necessità critica di interconnessioni di potenza che non solo possano veicolare tali carichi, ma che lo facciano con la massima efficienza, minimizzando le perdite e garantendo la stabilità del sistema.

La progettazione di queste interconnessioni deve tenere conto di fattori come la dissipazione del calore, la resistenza elettrica e la durabilità, aspetti cruciali per prevenire guasti e ottimizzare il Total Cost of Ownership (TCO) delle infrastrutture. Per i deployment on-premise, dove ogni componente è sotto il controllo diretto dell'organizzazione, la qualità e l'affidabilità di queste soluzioni diventano ancora più rilevanti, influenzando direttamente la performance e la longevità dell'intero stack.

Implicazioni per i Deployment On-Premise e la Sovranità dei Dati

La scelta di interconnessioni di potenza di alta qualità è un fattore determinante per le organizzazioni che optano per un approccio self-hosted o air-gapped per i loro carichi di lavoro AI. In questi contesti, la capacità di scalare l'infrastruttura, mantenere elevate performance di throughput e garantire la sovranità dei dati dipende in larga misura dalla robustezza e dall'efficienza dell'hardware sottostante. Le soluzioni di fascia alta offerte da specialisti come BizLink e JPC rispondono a questa esigenza, permettendo di costruire data center e cluster di calcolo che possano gestire il training intensivo e l'Inference in tempo reale con la massima affidabilità.

Per i CTO e gli architetti di infrastruttura, la valutazione di questi componenti va oltre il costo iniziale. Si considerano l'impatto sul consumo energetico, la facilità di manutenzione e la resilienza complessiva del sistema. La possibilità di avere un controllo granulare su ogni aspetto dell'infrastruttura, dalla GPU al cavo di alimentazione, è un vantaggio competitivo per chi deve rispettare normative stringenti sulla privacy o operare in ambienti con requisiti di sicurezza elevati. Per le aziende che valutano deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per approfondire la valutazione dei trade-off tra controllo, performance e TCO.

Il Futuro delle Infrastrutture AI: Efficienza e Affidabilità

L'evoluzione del mercato delle interconnessioni di potenza riflette la maturazione dell'ecosistema AI. Man mano che i Large Language Models diventano più sofisticati e le applicazioni di intelligenza artificiale si diffondono in settori critici, la domanda di componenti infrastrutturali che possano sostenere carichi di lavoro sempre più intensi non farà che aumentare. La specializzazione in soluzioni di fascia alta da parte di attori come BizLink e JPC evidenzia una chiara tendenza del settore: l'investimento in qualità e affidabilità è fondamentale per sbloccare il pieno potenziale dell'AI.

Questo trend sottolinea l'importanza di una pianificazione infrastrutturale meticolosa, specialmente per chi considera deployment on-premise. Le decisioni relative all'hardware, inclusi i componenti apparentemente minori come le interconnessioni di potenza, hanno un impatto diretto sul TCO, sulle performance e sulla capacità di un'organizzazione di mantenere il controllo sui propri dati e modelli.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!