La crescente opposizione ai data center: un ostacolo per l'AI?

La rapida espansione dell'intelligenza artificiale e dei Large Language Models (LLM) sta alimentando una domanda senza precedenti di capacità di calcolo, spingendo le aziende tecniciche a investire massicciamente in nuove infrastrutture. Tuttavia, questa corsa al "compute" si scontra con una crescente resistenza da parte del pubblico. Negli Stati Uniti, un'indagine recente rivela che il 70% degli americani si oppone alla costruzione di data center nelle vicinanze delle proprie abitazioni. Questo dato è significativo, poiché posiziona i data center come meno popolari delle centrali nucleari in termini di accettazione locale, un indicatore chiaro di un cambiamento nel sentiment pubblico.

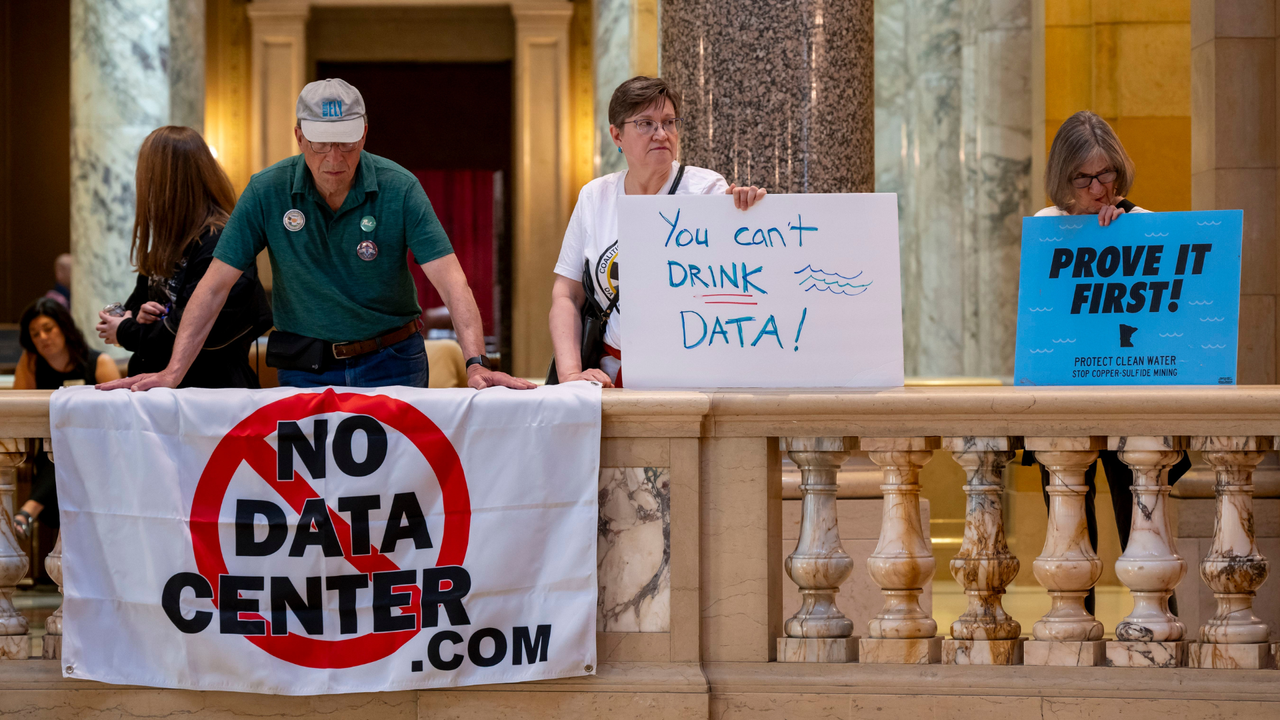

L'opposizione non è solo generica, ma si sta intensificando specificamente nei confronti dell'infrastruttura AI. Manifestazioni, come quella per una moratoria sui data center, evidenziano un malcontento diffuso. Le preoccupazioni spaziano dall'impatto ambientale, legato al consumo energetico e idrico, al rumore generato dalle strutture di raffreddamento, fino alla percezione di un'eccessiva industrializzazione di aree residenziali. Questo scenario crea nuove sfide per le aziende che cercano di espandere le proprie capacità di elaborazione per sostenere lo sviluppo e il deployment di sistemi AI avanzati.

Le esigenze dell'AI e il loro impatto infrastrutturale

I Large Language Models, in particolare, richiedono una potenza di calcolo enorme sia per il training che per l'inference. Questo si traduce nella necessità di array di GPU ad alte prestazioni, come le NVIDIA H100 o A100, con requisiti elevati di VRAM e larghezza di banda. Tali configurazioni generano un calore considerevole, che a sua volta richiede sistemi di raffreddamento complessi e ad alto consumo energetico. Un singolo data center può ospitare migliaia di queste unità, con un impatto significativo sulla rete elettrica locale e sulle risorse idriche, spesso utilizzate per il raffreddamento.

La corsa all'acquisizione di più "compute" da parte delle aziende tecniciche è una risposta diretta a queste esigenze. Tuttavia, la costruzione e l'espansione di queste strutture non sono processi semplici. Richiedono ampi appezzamenti di terreno, accesso a infrastrutture energetiche robuste e, sempre più spesso, devono affrontare un esame minuzioso da parte delle comunità locali. La sfida è bilanciare la necessità di innovazione tecnicica con la sostenibilità ambientale e l'accettazione sociale, un equilibrio che diventa sempre più precario.

Implicazioni per il deployment on-premise e la sovranità dei dati

Per le organizzazioni che valutano il deployment di LLM e altre soluzioni AI, la crescente opposizione ai data center introduce nuove complessità. Le decisioni tra soluzioni cloud e self-hosted, o on-premise, diventano ancora più critiche. Se da un lato il cloud offre scalabilità e flessibilità, dall'altro le soluzioni on-premise garantiscono un maggiore controllo sulla sovranità dei dati, sulla compliance e sulla sicurezza, aspetti fondamentali per settori come la finanza o la sanità. Tuttavia, la realizzazione di un'infrastruttura on-premise richiede non solo un investimento iniziale significativo (CapEx) ma anche la gestione delle sfide legate alla selezione del sito, all'ottenimento dei permessi e all'integrazione con le comunità locali.

Il Total Cost of Ownership (TCO) di un deployment on-premise deve ora considerare non solo i costi hardware, energetici e di personale, ma anche i potenziali ritardi e i costi aggiuntivi derivanti dall'opposizione pubblica o da moratorie. Per chi valuta queste alternative, AI-RADAR offre framework analitici su /llm-onpremise per comprendere i trade-off tra controllo, performance e costi operativi in un contesto di crescente scrutinio pubblico. La capacità di garantire ambienti air-gapped o di soddisfare requisiti specifici di residenza dei dati rimane un fattore chiave per molte aziende, ma la realizzazione fisica di tali ambienti è sempre più sotto pressione.

Prospettive future e la ricerca di soluzioni sostenibili

La tensione tra la domanda insaziabile di capacità di calcolo per l'AI e la resistenza delle comunità locali è destinata a persistere. Le aziende e i decisori politici dovranno esplorare soluzioni innovative per mitigare l'impatto dei data center. Questo potrebbe includere lo sviluppo di tecnicie di raffreddamento più efficienti, l'integrazione con fonti di energia rinnovabile, la scelta di siti in aree industriali o remote, o l'adozione di architetture distribuite che riducano la concentrazione di infrastrutture in un unico luogo.

La discussione non riguarda più solo l'efficienza tecnicica o il TCO, ma anche la "licenza sociale" per operare. Assicurare la trasparenza, coinvolgere le comunità e dimostrare un impegno concreto verso la sostenibilità diventeranno fattori sempre più determinanti per il successo dei progetti infrastrutturali legati all'intelligenza artificiale. Il futuro del deployment AI dipenderà non solo dalla potenza del silicio, ma anche dalla capacità di costruire un consenso e una coesistenza armoniosa con l'ambiente e le persone.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!