La corsa ai 2nm: automotive e networking spingono l'innovazione

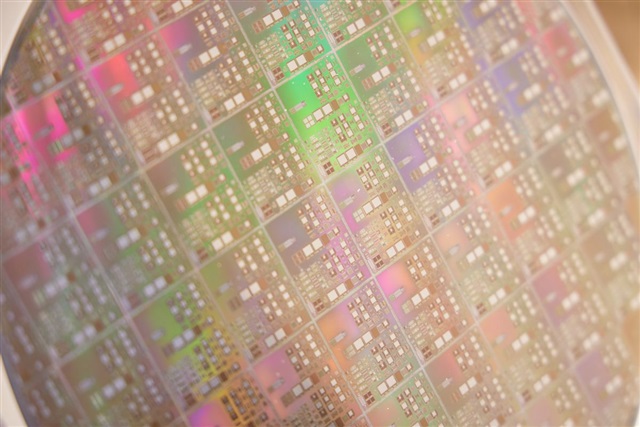

Il panorama dell'industria dei semiconduttori è in costante evoluzione, con una spinta incessante verso nodi di processo sempre più piccoli e performanti. Una delle tendenze più recenti e significative è l'accelerazione dei settori automotive e networking verso il nodo di processo a 2 nanometri (nm). Questa mossa strategica, che in molti casi implica un passaggio diretto da nodi meno avanzati, sottolinea l'urgenza di integrare capacità di calcolo superiori e maggiore efficienza energetica in questi ambiti critici.

La transizione ai 2nm promette transistor più piccoli, che si traducono in una maggiore densità di componenti su un singolo chip, prestazioni migliorate e consumi energetici ridotti. Per l'automotive, questo significa abilitare sistemi avanzati di assistenza alla guida (ADAS), funzionalità di guida autonoma e infotainment sempre più sofisticate. Nel networking, i chip a 2nm sono essenziali per supportare l'aumento esponenziale del traffico dati, le reti 5G e le infrastrutture di data center di nuova generazione, dove la velocità e l'efficienza sono parametri fondamentali.

L'impatto della domanda AI sulla capacità produttiva globale

Parallelamente a questa spinta innovativa, l'industria sta affrontando una sfida crescente: la domanda insaziabile di silicio avanzato da parte del settore dell'intelligenza artificiale. La proliferazione di Large Language Models (LLM) e di altre applicazioni AI ha generato una richiesta senza precedenti di GPU e acceleratori specializzati, che richiedono i nodi di processo più all'avanguardia per massimizzare le prestazioni di training e Inference.

Questa pressione si traduce in una capacità produttiva globalmente limitata presso le principali fonderie, come TSMC e Samsung Foundry. La priorità data alla produzione di chip AI ad alte prestazioni sta inevitabilmente stringendo la disponibilità di nodi avanzati per altri settori. Ciò può comportare tempi di consegna più lunghi e costi potenzialmente più elevati per i chip destinati all'automotive, al networking e ad altre applicazioni che necessitano di tecnicia all'avanguardia.

Implicazioni per il deployment on-premise e la supply chain

Per le aziende che valutano il deployment di carichi di lavoro AI, in particolare LLM, in ambienti self-hosted o on-premise, le dinamiche della supply chain dei semiconduttori assumono un'importanza cruciale. La disponibilità e il costo del silicio avanzato influenzano direttamente il Total Cost of Ownership (TCO) delle infrastrutture AI. La competizione per i nodi a 2nm e 3nm non riguarda solo le GPU di ultima generazione, ma anche i processori, i chip di rete e altri componenti essenziali per costruire uno stack locale robusto.

La pianificazione strategica diventa quindi fondamentale. Le decisioni relative all'hardware, dalla scelta delle GPU con sufficiente VRAM alla configurazione della rete interna per garantire throughput elevati, devono tenere conto delle attuali e future disponibilità del mercato. Per chi valuta deployment on-premise, esistono trade-off complessi tra l'adozione delle tecnicie più recenti e la garanzia di una supply chain stabile e prevedibile, spesso con un occhio alla sovranità dei dati e alla compliance.

Prospettive future e strategie di mitigazione

La tendenza verso nodi di processo sempre più piccoli è inarrestabile, ma le sfide legate alla capacità produttiva e alla supply chain richiederanno strategie di mitigazione innovative. Le aziende potrebbero dover considerare un mix di soluzioni, bilanciando l'uso di hardware di ultima generazione con opzioni più mature ma più facilmente reperibili, o esplorare architetture ibride che combinano risorse on-premise con capacità cloud per gestire i picchi di domanda.

La diversificazione dei fornitori e l'investimento in ricerca e sviluppo per ottimizzare l'utilizzo dell'hardware esistente, ad esempio tramite tecniche di Quantization per ridurre i requisiti di VRAM e migliorare l'Inference su hardware meno potente, diventeranno sempre più rilevanti. La capacità di navigare in questo scenario complesso, caratterizzato da innovazione rapida e vincoli di supply, sarà un fattore chiave per il successo delle strategie AI aziendali nei prossimi anni.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!