La Spinta dei Server AI sull'Framework Fisica

La domanda di server dedicati all'intelligenza artificiale sta vivendo un'impennata senza precedenti, un fenomeno che si riflette direttamente sulla catena di fornitura dell'hardware. Secondo quanto riportato da DIGITIMES, questa crescente richiesta sta portando a una significativa crescita dei ricavi per le aziende specializzate nella produzione di "rail kit", ovvero i sistemi di montaggio per server all'interno dei rack. Questo indicatore, apparentemente di nicchia, rivela una tendenza più ampia e strategica nel panorama tecnicico attuale.

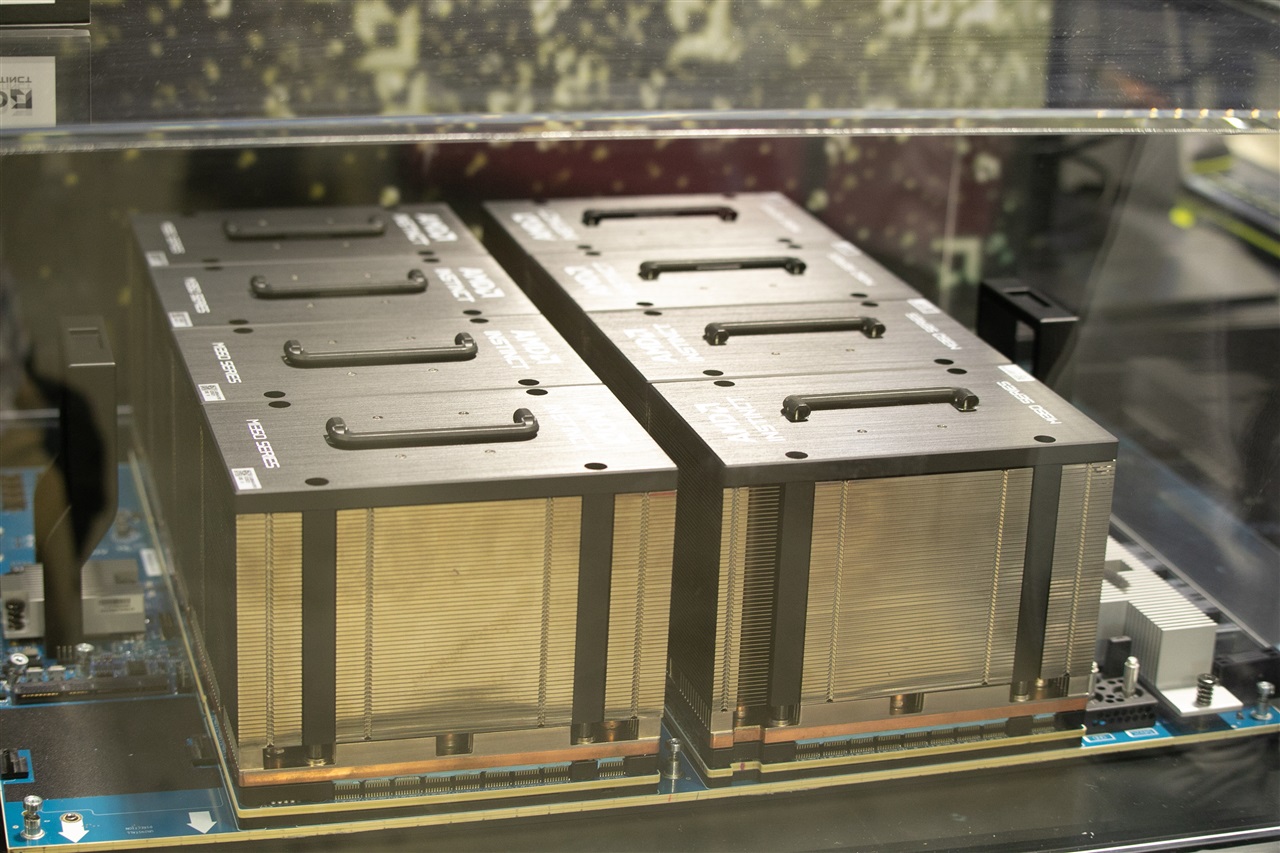

L'adozione diffusa di Large Language Models (LLM) e di altre applicazioni di intelligenza artificiale generativa sta spingendo le organizzazioni a rafforzare le proprie capacità computazionali. Non si tratta più solo di elaborare dati, ma di gestire modelli complessi che richiedono enormi quantità di VRAM e potenza di calcolo, spesso erogata da GPU di ultima generazione come le A100 o le H100. La necessità di ospitare fisicamente queste macchine ad alte prestazioni sta quindi riorientando gli investimenti verso l'infrastruttura hardware tangibile.

Il Ruolo Cruciale dei Componenti Fisici

I "rail kit" sono componenti essenziali per l'installazione e la gestione dei server all'interno dei data center. Permettono di montare in modo sicuro e organizzato le unità server nei rack standard, facilitando la manutenzione, il raffreddamento e l'ottimizzazione dello spazio. L'aumento della loro domanda non è un dettaglio secondario, ma un segnale chiaro che le aziende stanno espandendo attivamente le proprie capacità di calcolo attraverso l'acquisizione e il deployment di nuovi server fisici.

Questo trend suggerisce che, nonostante l'ubiquità del cloud computing, una parte significativa degli investimenti in AI si sta concentrando su soluzioni self-hosted o on-premise. Le ragioni dietro questa scelta sono molteplici e spesso interconnesse, spaziando dalla sovranità dei dati alla necessità di un controllo più granulare sull'ambiente hardware e software. La capacità di gestire direttamente l'infrastruttura diventa un fattore critico per carichi di lavoro AI particolarmente esigenti.

On-Premise vs. Cloud: I Driver della Scelta per gli LLM

La decisione di implementare infrastrutture AI on-premise, piuttosto che affidarsi esclusivamente a servizi cloud, è guidata da diversi fattori strategici. La sovranità dei dati è spesso una preoccupazione primaria, specialmente per settori regolamentati come la finanza o la sanità, dove la localizzazione e la protezione delle informazioni sensibili sono mandatorie. Un ambiente air-gapped o un data center privato offre un controllo senza pari su questi aspetti.

Inoltre, il Total Cost of Ownership (TCO) può giocare un ruolo determinante. Sebbene l'investimento iniziale (CapEx) per l'hardware on-premise sia elevato, i costi operativi a lungo termine per carichi di lavoro AI intensivi possono risultare inferiori rispetto ai modelli basati su OpEx del cloud, soprattutto quando si tratta di training o inference su larga scala. La possibilità di ottimizzare l'utilizzo delle GPU, la gestione del raffreddamento e l'efficienza energetica contribuiscono a rendere l'on-premise una scelta economicamente vantaggiosa per determinate applicazioni. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra le diverse opzioni.

Prospettive Future e Considerazioni Strategiche

L'attuale crescita del mercato dei componenti per server AI sottolinea una fase di maturazione nell'adozione dell'intelligenza artificiale a livello aziendale. Le organizzazioni non stanno più solo sperimentando, ma stanno costruendo infrastrutture robuste e dedicate per supportare le loro pipeline di sviluppo e deployment di LLM. Questo richiede una pianificazione strategica approfondita, che tenga conto non solo delle specifiche hardware, come la quantità di VRAM o il throughput delle GPU, ma anche della resilienza, della scalabilità e della sicurezza dell'intera infrastruttura.

Per CTO, DevOps lead e architetti infrastrutturali, comprendere queste dinamiche è fondamentale. La scelta tra un approccio self-hosted e una soluzione cloud-based non è banale e dipende da un'attenta valutazione dei requisiti specifici del carico di lavoro, dei vincoli di budget e delle esigenze di compliance. Il mercato dei "rail kit" è un barometro che indica come l'industria stia rispondendo a queste sfide, puntando sempre più su soluzioni infrastrutturali concrete e controllabili.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!