L'Impennata della Domanda di Server AI e i Suoi Beneficiari

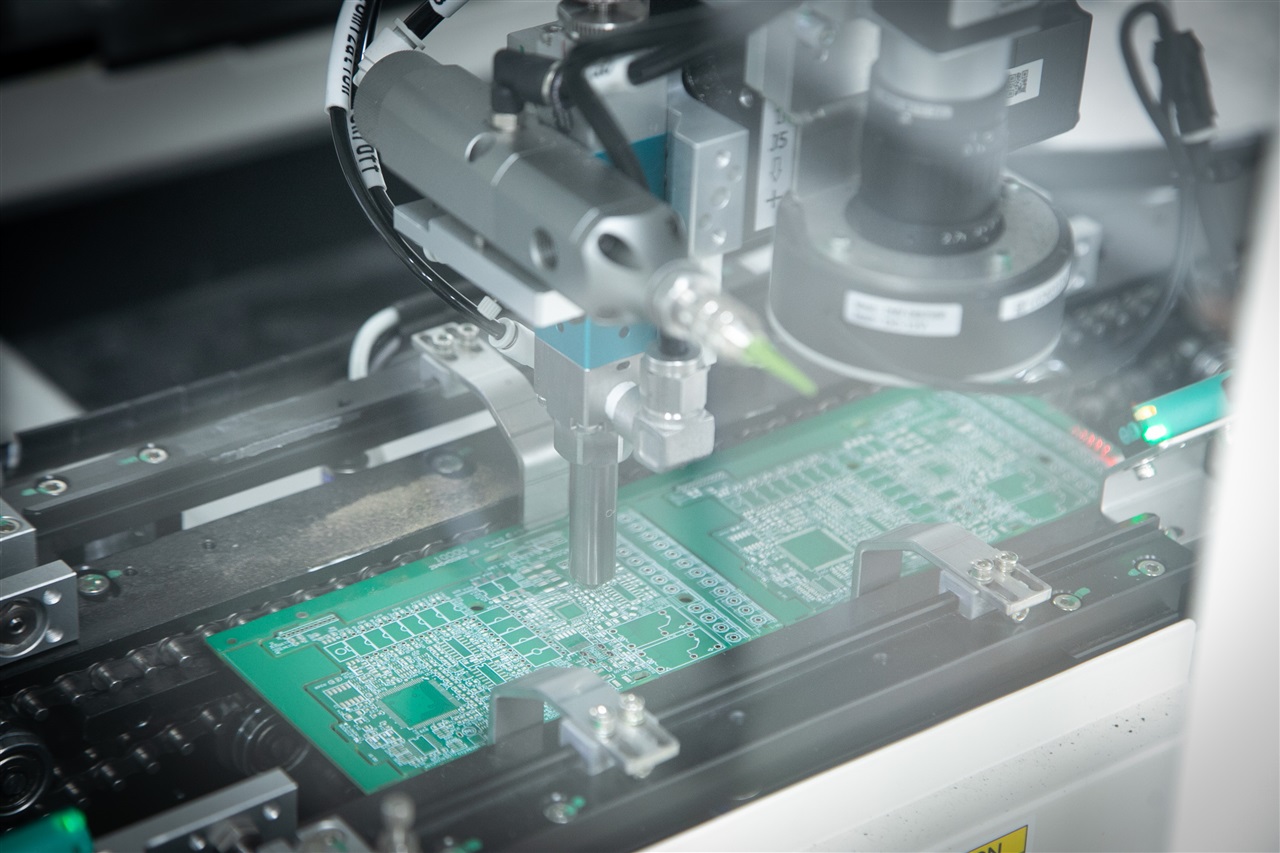

Il panorama tecnicico globale sta assistendo a una trasformazione accelerata, guidata dalla proliferazione dei carichi di lavoro legati all'intelligenza artificiale. Questa espansione si traduce in una richiesta senza precedenti di infrastrutture computazionali avanzate, in particolare server progettati per gestire le complesse operazioni degli LLM e di altri modelli AI. In questo contesto, la domanda di sistemi di alimentazione robusti e ad alta efficienza per server AI è in forte crescita.

Secondo quanto riportato da DIGITIMES, aziende come Lite-On e Delta stanno beneficiando in modo significativo da questa tendenza. Questi fornitori, specializzati in soluzioni di alimentazione e gestione termica, si trovano in una posizione privilegiata per capitalizzare l'esigenza critica di infrastrutture energetiche affidabili e performanti, necessarie per sostenere l'evoluzione e la scalabilità dei deployment AI a livello globale.

Il Cuore dell'Framework AI: Potenza e Raffreddamento

I server AI moderni, equipaggiati con GPU ad alte prestazioni come le NVIDIA H100 o A100, sono noti per il loro elevato consumo energetico. Queste unità di elaborazione grafica, essenziali per il training e l'Inference degli LLM, richiedono una fornitura di potenza costante e stabile, che può superare di gran lunga quella dei server tradizionali. Di conseguenza, i sistemi di alimentazione devono essere progettati per gestire carichi elevati, garantendo al contempo efficienza e affidabilità.

L'aumento della densità di potenza all'interno dei rack dei data center solleva anche sfide significative in termini di raffreddamento. Un'adeguata dissipazione del calore è fondamentale per prevenire il surriscaldamento dei componenti e garantire la longevità e le prestazioni ottimali dell'hardware. Questo implica la necessità di soluzioni di raffreddamento avanzate, che vanno dai sistemi ad aria potenziati al raffreddamento a liquido diretto, tutti elementi che contribuiscono al TCO complessivo di un'infrastruttura AI.

Implicazioni per i Deployment On-Premise

Per le organizzazioni che scelgono di implementare i propri carichi di lavoro AI in ambienti self-hosted o on-premise, la gestione della potenza e del raffreddamento diventa una considerazione primaria. A differenza dei servizi cloud, dove queste complessità sono astratte dal cliente, un deployment on-premise richiede un'attenta pianificazione e investimento in infrastrutture fisiche. La sovranità dei dati, la compliance normativa e la necessità di ambienti air-gapped sono spesso i motori di queste decisioni, ma comportano la responsabilità diretta della gestione energetica.

La scelta di un'architettura on-premise per gli LLM offre un controllo senza pari sui dati e sull'hardware, ma richiede anche un'analisi approfondita del TCO, che include non solo il CapEx per l'acquisto di server e GPU, ma anche l'OpEx legato al consumo energetico, al raffreddamento e alla manutenzione. Per chi valuta deployment on-premise, esistono trade-off significativi tra costi iniziali, operativi e requisiti infrastrutturali, aspetti che AI-RADAR esplora in dettaglio nei suoi framework analitici su /llm-onpremise.

Prospettive Future e Sfide Continua

La domanda di potenza per i server AI è destinata a crescere ulteriormente man mano che i modelli diventano più grandi e complessi, e l'adozione dell'AI si estende a nuovi settori. Questo scenario pone una sfida continua per i produttori di sistemi di alimentazione e per i gestori di data center. L'innovazione sarà cruciale per sviluppare soluzioni sempre più efficienti, compatte e capaci di gestire carichi energetici estremi, riducendo al contempo l'impronta ambientale.

Le aziende come Lite-On e Delta, con la loro esperienza nel settore, giocheranno un ruolo fondamentale nel fornire le fondamenta energetiche necessarie per alimentare la prossima generazione di intelligenza artificiale. La loro capacità di innovare e scalare la produzione di componenti critici sarà determinante per supportare la transizione verso un'infrastruttura AI più potente e sostenibile, sia nel cloud che, in misura crescente, negli ambienti on-premise delle imprese.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!