L'onda della domanda AI e le sue ripercussioni sulla supply chain

L'accelerazione senza precedenti nello sviluppo e nell'adozione dell'intelligenza artificiale, in particolare dei Large Language Models (LLM), sta avendo un impatto profondo non solo sul panorama tecnicico, ma anche sulle fondamenta stesse della sua infrastruttura. La crescente richiesta di potenza di calcolo, necessaria per il training e l'Inference di modelli sempre più complessi, sta mettendo sotto pressione l'intera catena di fornitura globale. Un segnale evidente di questa tensione emerge nel mercato dei materiali per i circuiti stampati (PCB), componenti essenziali per ogni dispositivo elettronico, dalle GPU ai server.

Questa dinamica non è nuova nel settore tecnicico, ma la scala e la velocità con cui la domanda di AI sta crescendo la rendono particolarmente critica. Le aziende che si affidano a soluzioni AI, sia per carichi di lavoro di training intensivi sia per l'Inference su larga scala, si trovano a dover affrontare un mercato in cui la disponibilità di componenti chiave è sempre più limitata e i costi tendono a salire.

Il ruolo cruciale dei PCB nell'infrastruttura AI

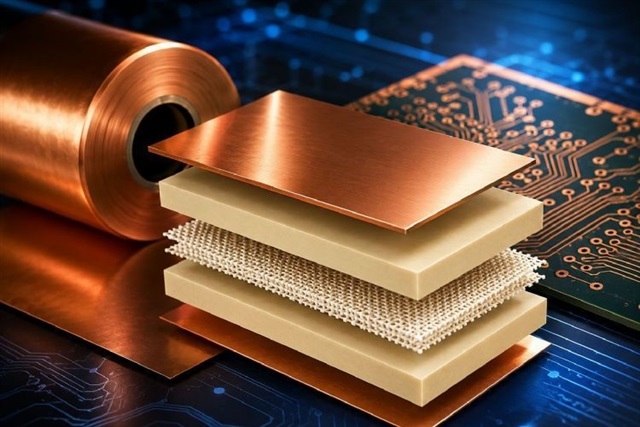

I circuiti stampati (PCB) rappresentano la spina dorsale di ogni sistema di calcolo moderno. Nelle architetture dedicate all'AI, come le schede acceleratrici basate su GPU, i PCB devono soddisfare requisiti estremamente stringenti in termini di densità, dissipazione del calore, integrità del segnale e capacità di gestire elevate potenze. L'evoluzione degli LLM e la necessità di processare enormi quantità di dati richiedono GPU con VRAM sempre maggiore e interconnessioni ad alta velocità, il che si traduce in PCB più complessi e sofisticati.

La produzione di questi PCB avanzati dipende da materiali specifici, spesso con proprietà dielettriche e termiche superiori, la cui disponibilità è limitata. Quando la domanda di prodotti finali (come le GPU di ultima generazione) supera l'offerta di questi materiali di base, si crea un collo di bottiglia che si propaga lungo tutta la catena. Questo scenario ha un impatto diretto sulle aziende che valutano il deployment di infrastrutture AI on-premise, dove l'approvvigionamento hardware è una componente critica del TCO e della pianificazione.

Implicazioni per i deployment on-premise e la sovranità dei dati

Per le organizzazioni che scelgono un approccio self-hosted per i loro carichi di lavoro AI, la stretta sulla catena di fornitura dei materiali PCB si traduce in sfide concrete. Tempi di consegna più lunghi per l'hardware, potenziali aumenti dei prezzi e la necessità di pianificare con largo anticipo diventano fattori determinanti. Questo può influenzare significativamente il Total Cost of Ownership (TCO) di un'infrastruttura AI on-premise, rendendo la gestione dell'inventario e la strategia di procurement ancora più complesse.

La scelta del deployment on-premise è spesso motivata da esigenze di sovranità dei dati, compliance normativa o la necessità di operare in ambienti air-gapped. Tuttavia, la dipendenza da una catena di fornitura globale per i componenti hardware introduce un elemento di vulnerabilità che deve essere attentamente gestito. La capacità di acquisire e mantenere l'hardware necessario diventa un fattore critico per garantire la continuità operativa e l'evoluzione delle capacità AI interne.

Prospettive future e strategie di mitigazione

La pressione sulla catena di fornitura dei materiali PCB è destinata a persistere finché la domanda di AI continuerà la sua crescita esponenziale. Per le aziende, ciò significa che la strategia di procurement hardware non può più essere un'attività reattiva, ma deve diventare una componente proattiva e strategica della pianificazione AI. Valutare fornitori alternativi, esplorare opzioni di design modulare o considerare l'ottimizzazione dell'hardware esistente tramite tecniche come la Quantization per ridurre i requisiti di VRAM, sono tutte strategie che possono aiutare a mitigare i rischi.

In questo contesto, la comprensione approfondita dei trade-off tra diverse architetture hardware e le loro implicazioni sulla supply chain diventa fondamentale. AI-RADAR, ad esempio, offre framework analitici su /llm-onpremise per supportare le decisioni strategiche relative ai deployment on-premise, aiutando le aziende a navigare in un mercato hardware sempre più volatile e competitivo. La resilienza della catena di fornitura sarà un fattore chiave per il successo delle iniziative AI a lungo termine.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!