La spinta dell'AI sulla filiera dei semiconduttori di Taiwan

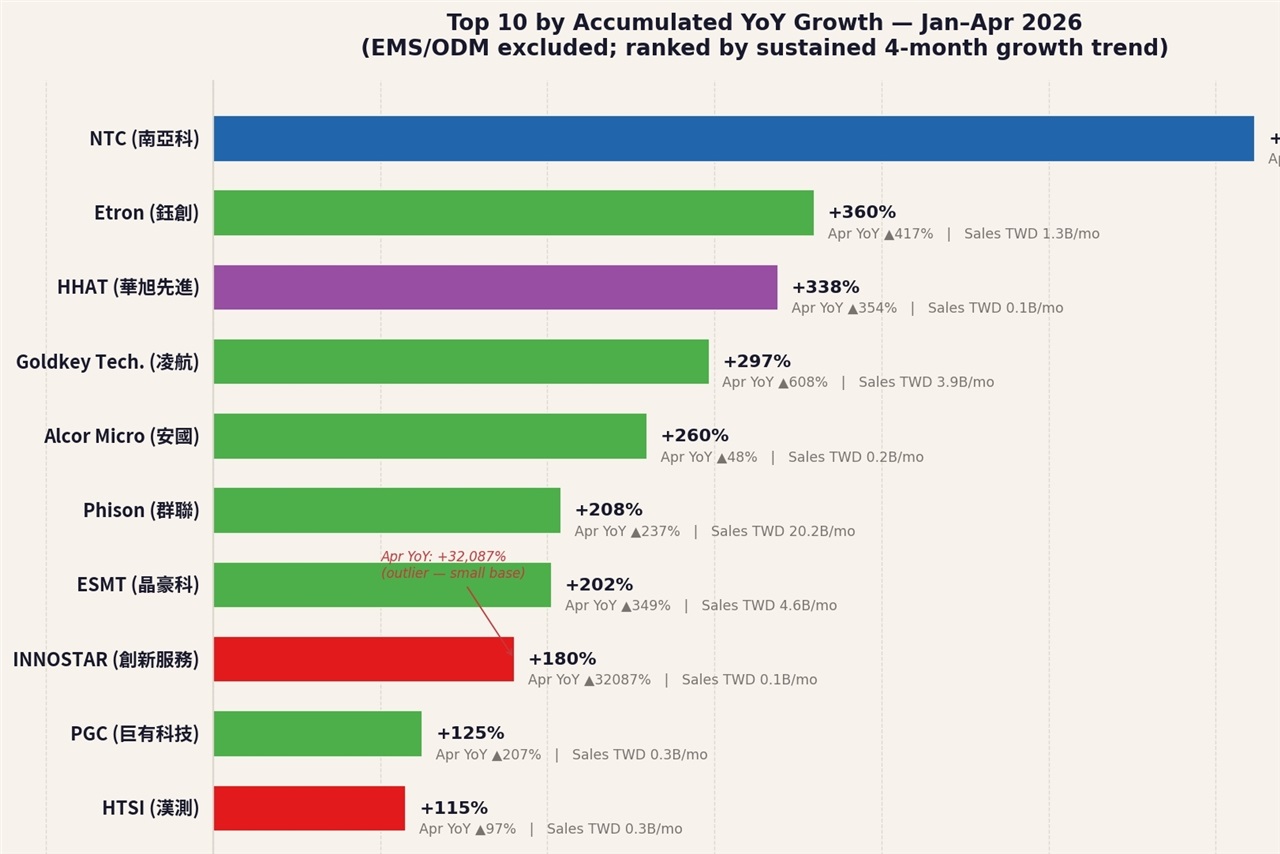

Il mese di aprile ha segnato un periodo di crescita per la filiera taiwanese dei semiconduttori, con risultati complessivamente positivi che riflettono una chiara e inequivocabile domanda proveniente dal settore dell'intelligenza artificiale. Questa tendenza non è isolata, ma si manifesta attraverso l'intero ecosistema, dalle fonderie ai produttori di componenti, segnalando un'accelerazione nell'adozione e nello sviluppo di soluzioni AI a livello globale.

La visibilità di questa domanda per l'AI è un indicatore cruciale per le aziende che pianificano investimenti infrastrutturali. La necessità di processare volumi crescenti di dati e di eseguire complessi modelli di Large Language Models (LLM) richiede un hardware sempre più potente e specializzato, ponendo le basi per un ciclo di investimenti significativo nel prossimo futuro.

Il ruolo cruciale dell'hardware AI e le sue implicazioni

L'incremento della domanda di AI si traduce direttamente in una maggiore richiesta di silicio ad alte prestazioni, in particolare per le unità di elaborazione grafica (GPU) e gli acceleratori dedicati all'Inference e al training di modelli. Componenti come la VRAM ad alta capacità e l'elevato throughput diventano fattori discriminanti per la performance dei sistemi AI. Le organizzazioni che sviluppano e implementano LLM e altri carichi di lavoro AI devono considerare attentamente queste specifiche tecniche per garantire che la loro infrastruttura possa supportare le esigenze di calcolo.

La scelta dell'hardware influenza direttamente la capacità di un sistema di gestire la complessità dei modelli, la dimensione del batch e la latenza delle risposte. Per esempio, la disponibilità di GPU con ampie quantità di VRAM è essenziale per caricare modelli di grandi dimensioni o per gestire finestre di contesto estese, elementi critici per l'efficacia degli LLM in contesti aziendali.

Implicazioni per il deployment on-premise e il TCO

Per i CTO, i responsabili DevOps e gli architetti infrastrutturali che valutano strategie di deployment, la forte domanda di AI nel mercato dei semiconduttori ha implicazioni dirette. La disponibilità e il costo dell'hardware specializzato sono fattori chiave nella decisione tra soluzioni self-hosted e servizi cloud. Un mercato dei semiconduttori robusto può offrire maggiore stabilità nella fornitura, ma anche pressioni sui prezzi, influenzando il Total Cost of Ownership (TCO) di un'infrastruttura AI on-premise.

Il deployment on-premise offre vantaggi significativi in termini di sovranità dei dati, compliance e la possibilità di operare in ambienti air-gapped, ma richiede un investimento iniziale (CapEx) più elevato e una gestione diretta dell'hardware. La capacità di acquisire e mantenere l'hardware AI necessario diventa quindi un elemento strategico. Per chi valuta deployment on-premise, esistono trade-off complessi che AI-RADAR esplora con framework analitici su /llm-onpremise, per bilanciare performance, costi e controllo.

Prospettive future e sfide del mercato

La chiara visibilità della domanda di AI nel settore dei semiconduttori taiwanese suggerisce che il trend di crescita è destinato a continuare. Tuttavia, la filiera globale rimane soggetta a dinamiche complesse, incluse le sfide geopolitiche e la necessità di innovazione continua per soddisfare le esigenze in evoluzione dell'intelligenza artificiale.

Le aziende dovranno continuare a monitorare attentamente le tendenze del mercato dei semiconduttori per pianificare efficacemente le proprie strategie infrastrutturali. La capacità di adattarsi rapidamente ai cambiamenti nella disponibilità e nelle specifiche dell'hardware sarà un fattore critico per mantenere un vantaggio competitivo nell'era dell'AI.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!