La pressione della domanda di AI sulla filiera tecnicica

La rapida espansione dell'intelligenza artificiale, e in particolare dei Large Language Models (LLM), sta generando una domanda senza precedenti di componenti hardware e servizi specializzati. Questa impennata sta esercitando una pressione notevole sull'intera filiera tecnicica, portando a un aumento dei costi di produzione e, di conseguenza, a sfide significative nella gestione dei prezzi per i fornitori. Le aziende che operano in questo settore si trovano ora a dover bilanciare la necessità di soddisfare una richiesta in costante crescita con la realtà di costi operativi e di approvvigionamento sempre più elevati.

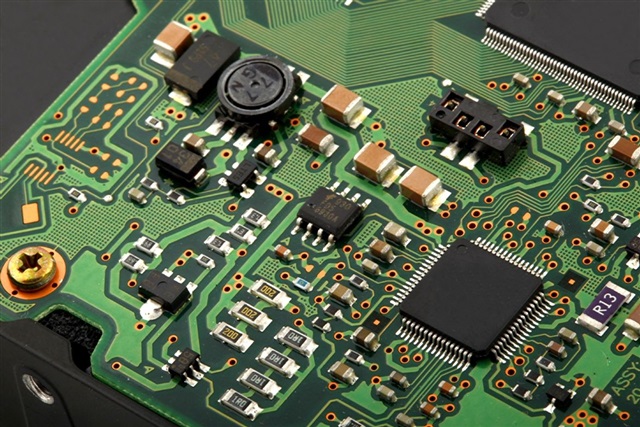

Questo scenario crea un ambiente complesso per i decision-maker tecnicici. La disponibilità di silicio avanzato, memorie ad alta larghezza di banda come la HBM (High Bandwidth Memory) e le GPU di ultima generazione, essenziali per l'inference e il training di modelli AI, è diventata un fattore critico. Le dinamiche di mercato attuali riflettono una tensione palpabile tra l'innovazione accelerata nel campo dell'AI e la capacità della filiera di tenere il passo senza impattare eccessivamente sui costi finali.

L'impatto sui componenti chiave per l'AI

L'aumento dei costi è particolarmente evidente nei segmenti cruciali per lo sviluppo e il deployment dell'AI. Le GPU, ad esempio, sono al centro di questa dinamica. La loro complessità produttiva, unita alla richiesta massiccia per carichi di lavoro di training e inference di LLM, ha spinto verso l'alto i prezzi e i tempi di consegna. Componenti come le memorie VRAM ad alta capacità (es. 80GB per GPU) e le interconnessioni ad alta velocità (come NVLink) sono diventati colli di bottiglia e fattori di costo significativi.

Oltre all'hardware, anche i processi di packaging avanzato e la logistica globale contribuiscono a questo incremento. La scarsità di materie prime specifiche e la complessità delle catene di approvvigionamento globali aggiungono ulteriori strati di costo e incertezza. Questo scenario rende la pianificazione degli investimenti in infrastrutture AI una sfida che richiede un'analisi approfondita del TCO e delle proiezioni di mercato a medio e lungo termine.

Implicazioni per il deployment on-premise

Per le organizzazioni che valutano un deployment on-premise di soluzioni AI, l'attuale contesto di costi crescenti nella filiera tecnicica ha implicazioni dirette. Se da un lato l'approccio self-hosted offre vantaggi in termini di sovranità dei dati, controllo e conformità (specialmente per ambienti air-gapped), dall'altro l'investimento iniziale (CapEx) in hardware può risultare significativamente più elevato e volatile. La pianificazione del TCO per un'infrastruttura AI on-premise richiede una stima accurata non solo dei costi di acquisizione, ma anche di quelli legati all'energia, al raffreddamento e alla manutenzione nel tempo.

La scelta tra un'infrastruttura on-premise e soluzioni basate su cloud diventa quindi una decisione strategica ancora più complessa. Mentre il cloud può offrire flessibilità e un modello OpEx, il controllo sui dati e la personalizzazione dell'hardware per carichi di lavoro specifici rimangono punti di forza del self-hosting. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi iniziali, operativi e i benefici a lungo termine in termini di controllo e sicurezza.

Prospettive e strategie per il futuro

Di fronte a queste sfide, le aziende stanno esplorando diverse strategie per mitigare l'impatto dell'aumento dei costi. L'ottimizzazione dell'utilizzo dell'hardware esistente, l'adozione di tecniche di quantization avanzate per ridurre i requisiti di VRAM e l'esplorazione di architetture di modelli più efficienti sono alcune delle vie percorribili. Anche la diversificazione dei fornitori e la costruzione di relazioni più resilienti con la filiera possono contribuire a stabilizzare i costi e garantire la disponibilità dei componenti.

Il mercato dell'AI è in continua evoluzione, e con esso le dinamiche della sua filiera. La capacità di adattarsi rapidamente a questi cambiamenti, mantenendo al contempo un focus sulla sostenibilità economica e tecnicica, sarà cruciale per le aziende che intendono sfruttare appieno il potenziale dei Large Language Models e delle altre applicazioni di intelligenza artificiale. La vigilanza sulle tendenze di mercato e una pianificazione infrastrutturale proattiva saranno elementi chiave per navigare con successo in questo scenario.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!