Il monito di Nvidia sulla scelta hardware di DeepSeek

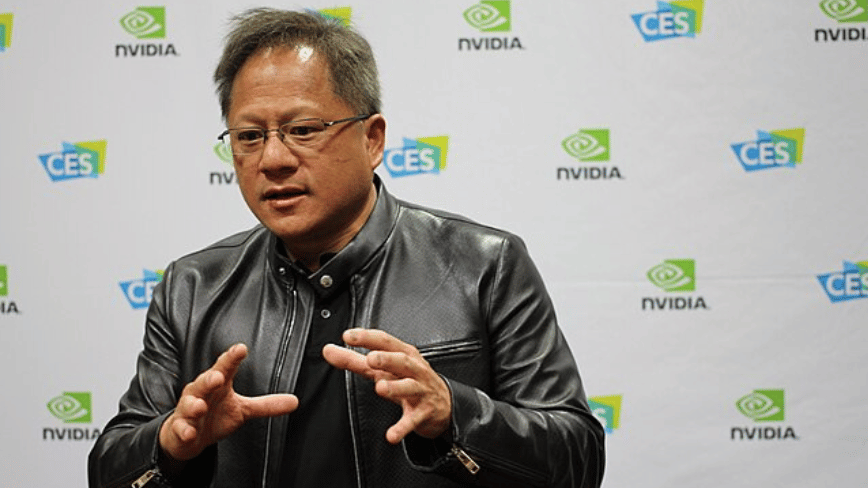

Jensen Huang, CEO di Nvidia, ha recentemente sollevato un'importante questione riguardo alle dinamiche del mercato globale dell'intelligenza artificiale. Durante una partecipazione al Dwarkesh Podcast, Huang ha espresso una chiara preoccupazione per la decisione del laboratorio cinese DeepSeek di ottimizzare i propri Large Language Models (LLM) per i chip Ascend di Huawei, piuttosto che per l'hardware di produzione americana. Questa scelta, secondo il CEO di Nvidia, rappresenterebbe un "esito orribile" per gli Stati Uniti, sottolineando le profonde implicazioni strategiche che le decisioni sull'infrastruttura AI comportano.

DeepSeek, un attore emergente nel panorama dell'intelligenza artificiale, si sta preparando a rilasciare il suo modello fondazione V4. La notizia che questo modello sarà basato sul processore Ascend 950PR di Huawei segna un punto di svolta significativo. Questa migrazione dall'hardware tradizionalmente dominante di Nvidia verso soluzioni alternative evidenzia una crescente diversificazione nel settore e solleva interrogativi sulla futura architettura dei deployment di LLM a livello globale.

Implicazioni tecniche e strategiche della scelta del silicio

La decisione di ottimizzare un LLM come il V4 di DeepSeek per un'architettura hardware specifica, come il processore Ascend 950PR di Huawei, non è banale. Richiede un investimento considerevole in termini di ingegneria e sviluppo software per garantire che il modello sfrutti al meglio le capacità del silicio sottostante. Questo include l'ottimizzazione per la VRAM disponibile, le unità di calcolo, la banda passante della memoria e le specifiche capacità di accelerazione dell'AI offerte dal chip. Un'ottimizzazione efficace può influenzare direttamente il throughput, la latenza e, in ultima analisi, il Total Cost of Ownership (TCO) di un deployment su larga scala.

Per le aziende che valutano il deployment di LLM, la scelta dell'hardware è un fattore critico. Architetture diverse presentano trade-off distinti in termini di performance, efficienza energetica e compatibilità con l'ecosistema software esistente. Mentre l'hardware di Nvidia ha storicamente dominato il mercato per il training e l'inference di LLM, l'emergere di alternative come i chip Ascend di Huawei introduce nuove variabili. Queste alternative possono essere considerate per ragioni di costo, disponibilità o, come in questo caso, per strategie di indipendenza tecnicica e sovranità dei dati, specialmente in contesti dove la compliance e gli ambienti air-gapped sono prioritari.

Contesto geopolitico e sovranità tecnicica

Il monito di Jensen Huang non si limita a una questione di competizione commerciale; si inserisce in un più ampio contesto geopolitico. La capacità di un paese di sviluppare e controllare la propria infrastruttura AI, dal silicio ai modelli fondazione, è sempre più vista come un pilastro della sovranità tecnicica. La dipendenza da fornitori esterni per componenti critici può esporre a rischi legati alla supply chain, a restrizioni commerciali o a preoccupazioni sulla sicurezza dei dati. La scelta di DeepSeek di affidarsi a Huawei può essere interpretata come un passo verso una maggiore autonomia tecnicica per la Cina nel settore dell'AI.

Questa dinamica sottolinea l'importanza per i decision-maker tecnicici di considerare non solo le specifiche tecniche e il TCO, ma anche le implicazioni a lungo termine della catena di approvvigionamento e della geopolitica. La diversificazione dei fornitori e lo sviluppo di capacità interne per il deployment di LLM diventano strategie chiave per mitigare i rischi e garantire la resilienza operativa, specialmente per carichi di lavoro sensibili o strategici che richiedono il massimo controllo sui dati e sull'infrastruttura.

Prospettive per i deployment on-premise

La situazione evidenziata dal CEO di Nvidia offre spunti significativi per le organizzazioni che valutano deployment di LLM on-premise o in ambienti ibridi. La possibilità di ottimizzare i modelli per hardware specifici, anche se non mainstream, può offrire vantaggi in termini di performance personalizzate e controllo sui costi operativi nel lungo periodo. Tuttavia, ciò comporta la necessità di investire in competenze interne per l'ottimizzazione e la gestione di stack tecnicici meno diffusi.

Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra diverse architetture hardware, i costi iniziali (CapEx) e operativi (OpEx), e le implicazioni per la sovranità dei dati e la compliance. La scelta di un'infrastruttura AI è una decisione strategica che va oltre la mera performance, abbracciando aspetti di controllo, sicurezza e indipendenza tecnicica, come dimostrato dalla mossa di DeepSeek e dalle reazioni del mercato.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!