La stabilità dei cluster GPU: la sfida cruciale per le IPO cinesi nel settore AI

L'ondata di offerte pubbliche iniziali (IPO) nel settore delle GPU in Cina sta affrontando una prova decisiva: la stabilità dei cluster. Questo aspetto, spesso sottovalutato nella fase di euforia del mercato, emerge come un fattore critico per il successo a lungo termine delle aziende che mirano a capitalizzare sulla crescente domanda di potenza di calcolo per l'intelligenza artificiale. La capacità di costruire e mantenere infrastrutture robuste e affidabili è fondamentale, specialmente in un contesto dove i carichi di lavoro basati su Large Language Models (LLM) richiedono performance costanti e senza interruzioni.

La stabilità di un cluster GPU non è un semplice dettaglio tecnico, ma un prerequisito per garantire l'efficienza operativa e la sostenibilità economica. Per le aziende che sviluppano o utilizzano LLM, un cluster instabile può tradursi in latenze elevate, throughput ridotto e, in ultima analisi, costi operativi maggiori dovuti a interruzioni e necessità di manutenzione straordinaria. Questo scenario è particolarmente rilevante per le realtà che puntano a deployment on-premise, dove il controllo diretto sull'hardware e sull'ambiente operativo è sia un vantaggio che una responsabilità.

Il Dettaglio Tecnico della Stabilità

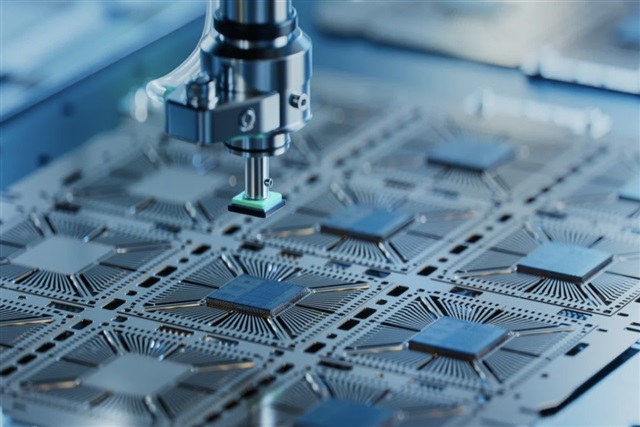

Quando si parla di stabilità dei cluster GPU, si fa riferimento a un insieme complesso di fattori che vanno oltre la semplice disponibilità delle singole unità di elaborazione. Elementi cruciali includono l'affidabilità delle interconnessioni ad alta velocità (come NVLink o InfiniBand), la gestione termica efficace per prevenire il throttling delle GPU, la stabilità dell'alimentazione elettrica e la resilienza del software di orchestrazione. Ogni componente, dalla VRAM delle singole schede alla larghezza di banda della rete, deve operare in perfetta sincronia per sostenere carichi di lavoro intensivi e distribuiti.

La gestione di un cluster di GPU per l'Inference o il Fine-tuning di LLM richiede un'ingegneria di sistema meticolosa. Problemi apparentemente minori, come fluttuazioni di tensione o errori di configurazione del Framework, possono degradare significativamente le performance complessive del cluster. Per le aziende che investono in infrastrutture self-hosted, la comprensione approfondita di questi aspetti tecnici è indispensabile per ottimizzare il TCO e garantire che l'investimento hardware si traduca in capacità di calcolo effettivamente utilizzabile e affidabile.

Implicazioni per i Deployment On-Premise

La sfida della stabilità dei cluster assume un'importanza ancora maggiore per le organizzazioni che scelgono un approccio al deployment on-premise o air-gapped. In questi contesti, la sovranità dei dati e la compliance normativa sono spesso priorità assolute, rendendo le soluzioni cloud meno adatte. Tuttavia, la gestione di un'infrastruttura AI locale richiede competenze e risorse significative per affrontare le complessità legate alla stabilità, alla scalabilità e alla manutenzione.

Per chi valuta deployment on-premise, esistono trade-off ben definiti tra il controllo totale e la complessità operativa. La stabilità del cluster influisce direttamente sulla capacità di erogare servizi AI critici, come l'elaborazione di dati sensibili o l'esecuzione di modelli proprietari. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, aiutando le aziende a comprendere i requisiti infrastrutturali e i costi associati alla costruzione di un ambiente AI robusto e affidabile, lontano dalle dipendenze del cloud.

Prospettive Future e Trade-off

Il mercato cinese delle GPU, con la sua ondata di IPO, riflette una tendenza globale verso la decentralizzazione e la specializzazione dell'hardware AI. Tuttavia, il successo di queste iniziative dipenderà non solo dalla capacità di produrre chip performanti, ma anche dalla maturità delle soluzioni infrastrutturali che li supportano. La stabilità dei cluster diventerà un Benchmark chiave per distinguere i fornitori in grado di offrire soluzioni complete e affidabili.

In un panorama tecnicico in rapida evoluzione, la capacità di garantire la stabilità operativa dei cluster GPU rappresenta un vantaggio competitivo significativo. Le aziende dovranno bilanciare l'innovazione hardware con l'ingegneria di sistema, considerando attentamente il TCO e i requisiti di affidabilità. La sfida non è solo quella di acquisire potenza di calcolo, ma di renderla costantemente disponibile e performante, un fattore che determinerà il vero valore delle nuove offerte sul mercato.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!