Hua Hong Semiconductor: una strategia focalizzata su AI e innovazione

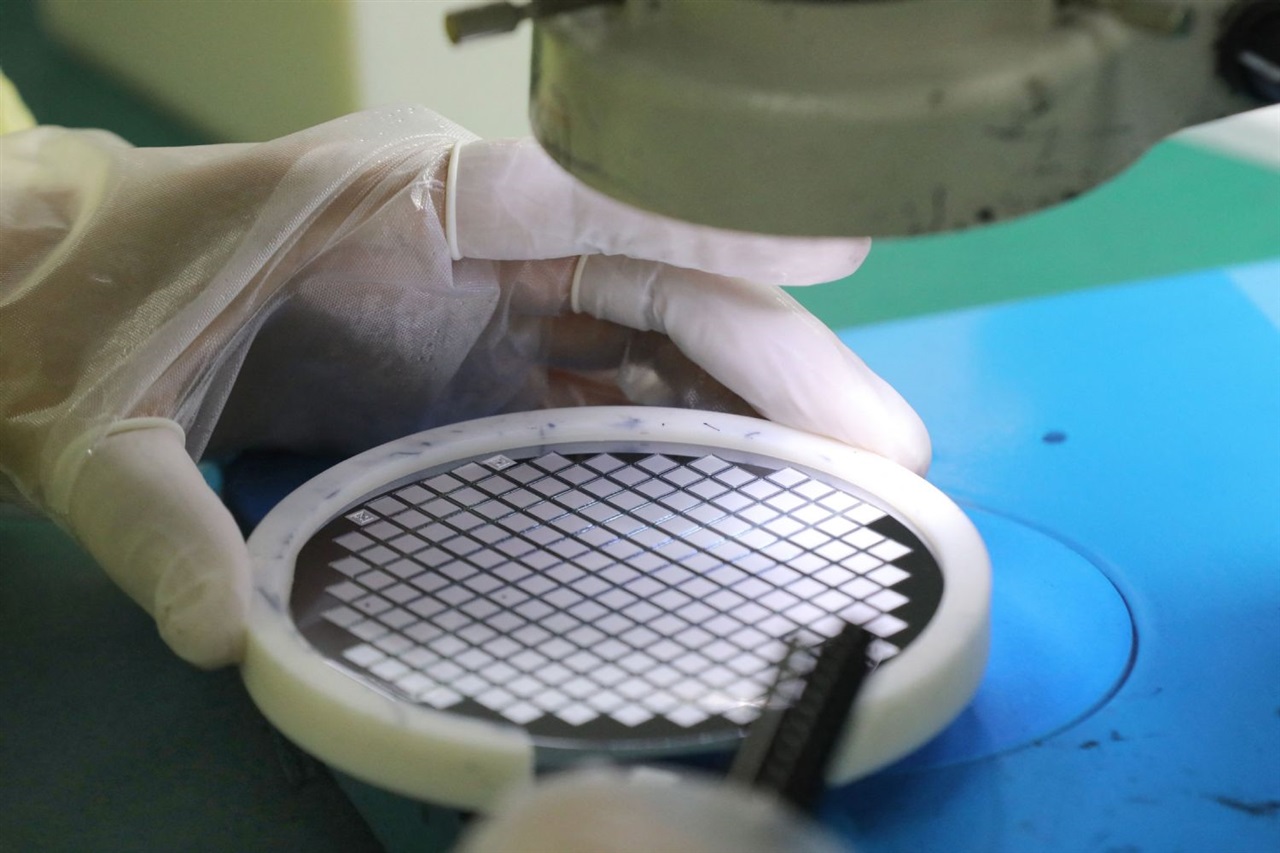

Hua Hong Semiconductor, un attore chiave nel panorama globale dei semiconduttori, ha annunciato un'evoluzione strategica che pone al centro la crescente domanda legata all'intelligenza artificiale e l'espansione delle proprie capacità tecniciche specialistiche. Questa direzione riflette un trend macroeconomico e tecnicico che vede l'AI come motore primario per l'innovazione e la crescita nel settore del silicio. La mossa sottolinea l'importanza di adattare l'offerta di chip alle esigenze sempre più complesse dei carichi di lavoro AI.

L'azienda si posiziona per capitalizzare un mercato in rapida espansione, dove la richiesta di componenti hardware specifici per l'accelerazione dell'AI è diventata una priorità. Questo approccio strategico non solo mira a rafforzare la competitività di Hua Hong, ma anche a supportare lo sviluppo di soluzioni AI più efficienti e performanti, essenziali per le imprese che cercano di implementare queste tecnicie in vari contesti.

La spinta della domanda di intelligenza artificiale

La domanda di intelligenza artificiale, in particolare per i Large Language Models (LLM), sta ridefinendo i requisiti per il silicio. Le aziende necessitano di processori con elevate capacità di calcolo, abbondante VRAM e throughput ottimizzato per gestire l'Inference e il Fine-tuning di modelli complessi. Questo è particolarmente vero per le organizzazioni che scelgono un deployment self-hosted o on-premise, dove il controllo diretto sull'hardware e la sovranità dei dati sono prioritari.

L'implementazione di infrastrutture AI on-premise presenta sfide significative, tra cui la gestione del TCO, il consumo energetico e la necessità di sistemi di raffreddamento avanzati. La disponibilità di chip ottimizzati, capaci di offrire un buon equilibrio tra performance e efficienza, diventa cruciale. Un'azienda come Hua Hong che si concentra su questa domanda può contribuire a fornire le fondamenture hardware necessarie per costruire stack AI locali robusti e scalabili, riducendo la dipendenza da soluzioni cloud e garantendo ambienti air-gapped quando richiesto.

L'espansione della tecnicia specialistica e le sue implicazioni

L'espansione della tecnicia specialistica da parte di Hua Hong Semiconductor implica un investimento in processi produttivi avanzati e nella capacità di realizzare chip con funzionalità specifiche. Questo può includere lo sviluppo di nodi tecnicici più piccoli, l'integrazione di IP (Intellectual Property) personalizzate o l'ottimizzazione per particolari tipi di memoria o interconnessioni. Per le imprese, ciò si traduce nella possibilità di accedere a silicio più adatto alle loro esigenze uniche, che siano legate a specifici algoritmi di AI, requisiti di Quantization o necessità di elaborazione a bassa latenza.

Questo focus sulla tecnicia specialistica è particolarmente rilevante per le organizzazioni che valutano un deployment on-premise. La capacità di ottenere hardware customizzato o altamente ottimizzato può migliorare significativamente le performance, ridurre il TCO a lungo termine e garantire una maggiore conformità con le normative sulla sovranità dei dati. In un mercato dominato da pochi grandi fornitori, la diversificazione dell'offerta di silicio specialistico è un fattore abilitante per l'innovazione e la competitività.

Prospettive per il panorama AI e le scelte di deployment

La strategia di Hua Hong Semiconductor evidenzia una tendenza più ampia nel settore dei semiconduttori: la crescente specializzazione per soddisfare le esigenze dell'AI. Per i CTO, i responsabili DevOps e gli architetti di infrastruttura, la disponibilità di un'offerta diversificata di silicio è fondamentale per prendere decisioni informate sul deployment. Che si tratti di scegliere tra soluzioni Bare metal, containerizzate o virtualizzate, la qualità e l'efficienza dell'hardware sottostante determinano direttamente il successo e la sostenibilità dei progetti AI.

Le aziende che considerano alternative self-hosted rispetto al cloud per i carichi di lavoro AI/LLM possono beneficiare di un ecosistema di fornitori di silicio più ampio e competitivo. Questo permette di bilanciare meglio i trade-off tra costi iniziali (CapEx) e operativi (OpEx), performance e requisiti di sicurezza. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, fornendo strumenti utili per navigare le complessità delle scelte di deployment nell'era dell'AI.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!