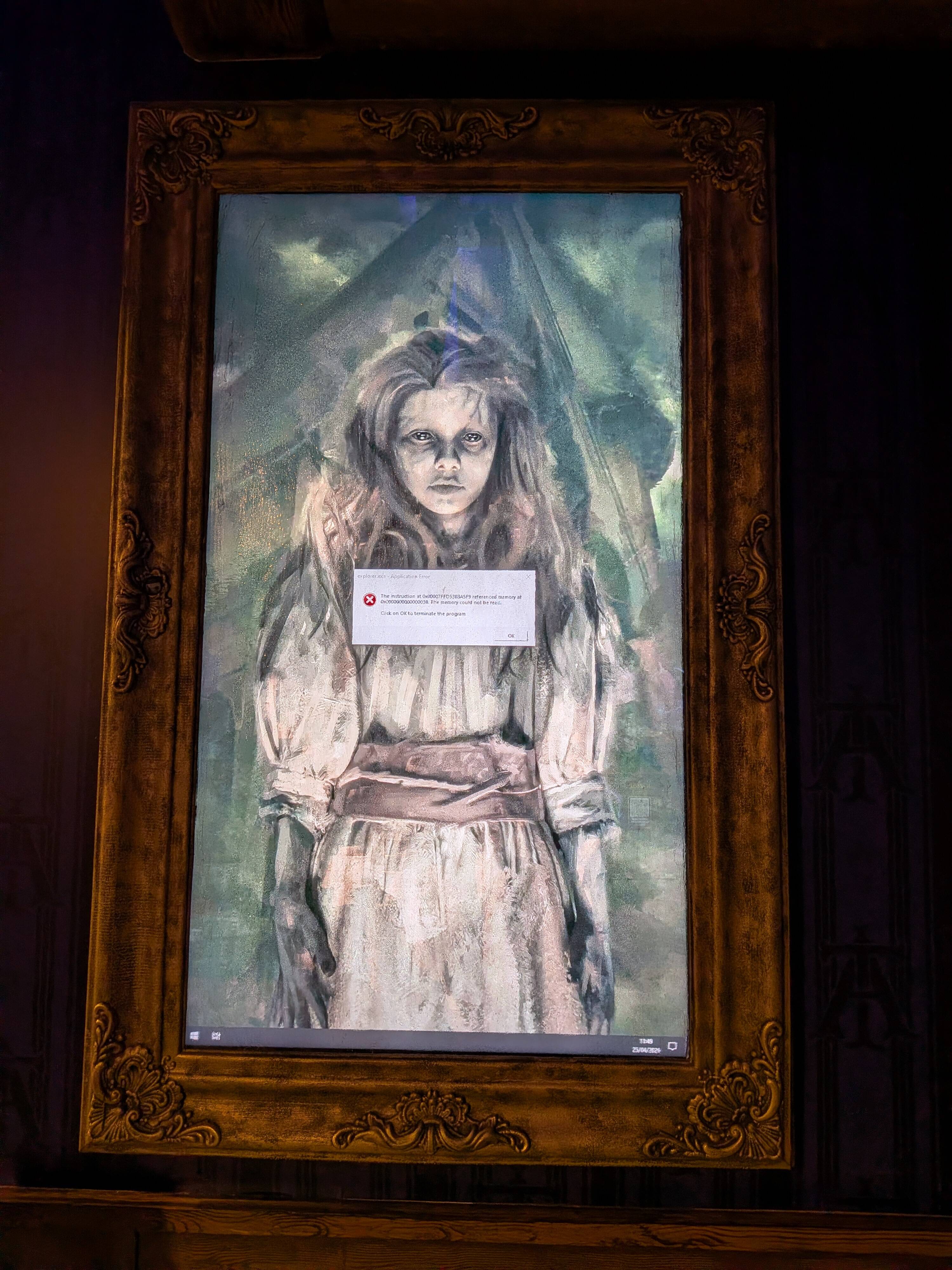

Le paure reali dell'IT: oltre il "bork"

Nel panorama tecnicico attuale, le vere "paure" per un professionista IT non risiedono in fenomeni paranormali, ma nelle complessità e nelle insidie nascoste dietro il deployment e la gestione di sistemi critici. Se un tempo era un sistema operativo instabile a generare ansia, oggi l'attenzione si sposta verso le sfide poste dall'intelligenza artificiale, in particolare i Large Language Models (LLM). Questi sistemi, pur promettendo rivoluzioni, portano con sé una serie di requisiti infrastrutturali e operativi che possono trasformarsi in veri e propri incubi se non gestiti con la dovuta attenzione.

La metafora del "bork" – quel suono o errore inaspettato che blocca un sistema – assume un significato più profondo quando si parla di carichi di lavoro AI. Non si tratta solo di un crash software, ma di un'intera catena di potenziali fallimenti: dalla carenza di VRAM su una GPU, a colli di bottiglia nel throughput di rete, fino a problemi di compatibilità tra i vari Framework. Ogni anello debole può compromettere l'intera Pipeline di inference o training, generando non solo frustrazione, ma anche costi significativi e interruzioni operative.

Le sfide del deployment on-premise per gli LLM

Il deployment di LLM in ambienti self-hosted o on-premise offre vantaggi in termini di controllo, sicurezza e sovranità dei dati, ma introduce anche notevoli complessità. La selezione dell'hardware è cruciale: la memoria VRAM delle GPU, ad esempio, è un fattore determinante per la dimensione dei modelli che possono essere eseguiti e per la dimensione del contesto. Un'errata valutazione può portare a investimenti in Silicio sottodimensionato o eccessivo, impattando direttamente sul TCO (Total Cost of Ownership).

Oltre all'hardware, la gestione dello stack software è altrettanto impegnativa. Ottimizzare le prestazioni richiede la padronanza di tecniche come la Quantization per ridurre l'impronta di memoria dei modelli, o l'implementazione di Framework di serving efficienti per massimizzare il throughput e minimizzare la latenza. La configurazione di ambienti air-gapped per requisiti di sicurezza stringenti aggiunge un ulteriore livello di complessità, richiedendo una pianificazione meticolosa per l'aggiornamento e la manutenzione dei sistemi senza compromettere l'isolamento.

Sovranità dei dati e implicazioni di sicurezza

Uno dei principali motori per la scelta di un deployment on-premise è la necessità di mantenere il pieno controllo sui dati. Settori come la finanza, la sanità o la pubblica amministrazione sono soggetti a normative rigorose (come il GDPR) che impongono requisiti specifici sulla residenza e la protezione dei dati. In questo contesto, l'idea di affidare dati sensibili a un provider cloud esterno può generare legittime "paure" riguardo alla compliance e alla sicurezza.

Gestire un'infrastruttura AI self-hosted significa assumersi la piena responsabilità della sicurezza. Questo include non solo la protezione fisica dei server e la sicurezza di rete, ma anche la gestione delle vulnerabilità software e la protezione contro attacchi mirati ai modelli stessi. Un sistema "borked" a causa di una breccia di sicurezza può avere conseguenze devastanti, ben oltre il semplice downtime, intaccando la reputazione e la fiducia degli utenti. La capacità di condurre audit interni e di mantenere un ambiente completamente isolato è un vantaggio chiave, ma richiede competenze e risorse dedicate.

Mitigare i rischi e pianificare il futuro

Per trasformare le "paure" in opportunità, è fondamentale adottare un approccio proattivo e basato sui fatti. La pianificazione strategica deve includere un'analisi approfondita dei requisiti di carico di lavoro, una valutazione comparativa delle opzioni hardware e software, e una chiara comprensione dei trade-off tra performance, costo e complessità operativa. Non esiste una soluzione unica per tutti; la scelta tra diverse GPU, Framework o strategie di deployment deve essere guidata dalle esigenze specifiche dell'organizzazione.

AI-RADAR si propone come risorsa per i decision-maker che navigano queste complessità, offrendo framework analitici su /llm-onpremise per valutare i trade-off e le implicazioni di ogni scelta. Comprendere le specifiche hardware concrete, come la VRAM necessaria per un dato modello, o le metriche di performance attese (tokens/sec, latenza), è essenziale per costruire un'infrastruttura resiliente e performante. Solo attraverso una pianificazione rigorosa e una profonda conoscenza tecnica è possibile affrontare le sfide del deployment AI on-premise, trasformando le potenziali "paure" in fiducia e controllo operativo.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!