Materiali Semiconduttori a Taiwan: Scenari Competitivi e Impatti sull'AI On-Premise

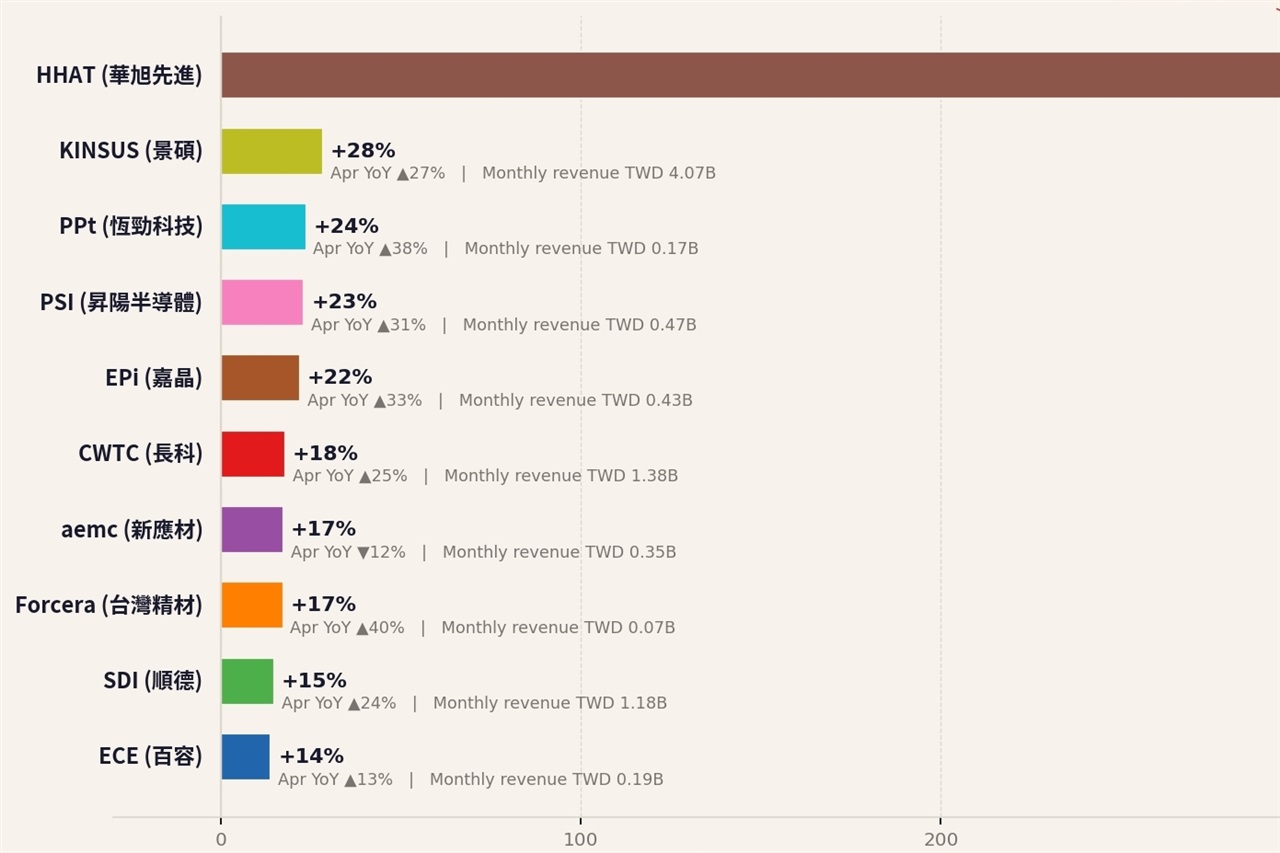

Un'analisi pubblicata da Digitimes prefigura per aprile 2026 uno scenario di crescente polarizzazione nel settore dei materiali semiconduttori a Taiwan, descrivendo una situazione di "due corse" distinte. Questa previsione suggerisce una potenziale frammentazione o una competizione intensificata all'interno di un comparto fondamentale per l'intera industria tecnicica globale. Per le organizzazioni che stanno pianificando o gestendo deployment di Large Language Models (LLM) on-premise, comprendere queste dinamiche di mercato è cruciale.

La disponibilità e il costo dei materiali semiconduttori influenzano direttamente la produzione di chip avanzati, dalle CPU alle GPU, che costituiscono la spina dorsale dell'infrastruttura AI. Un mercato in evoluzione, con possibili divergenze strategiche o tecniciche tra i principali attori, potrebbe avere ripercussioni significative sulla catena di approvvigionamento e, di conseguenza, sulle decisioni di investimento in hardware per l'intelligenza artificiale.

Il Contesto dei Materiali Semiconduttori e le "Due Corse"

I materiali semiconduttori rappresentano la base di ogni componente elettronico, dai substrati di silicio ai composti chimici utilizzati nei processi di fabbricazione. Taiwan è un epicentro globale per questa industria, ospitando alcuni dei maggiori produttori e fornitori. L'espressione "due corse" può indicare diverse tendenze: potrebbe riferirsi a una differenziazione tecnicica, con attori che investono in materiali per nodi di processo ultra-avanzati e altri che si concentrano su soluzioni più mature ma con volumi elevati.

Alternativamente, potrebbe riflettere una competizione geopolitica o una specializzazione in segmenti di mercato distinti, come i materiali per l'AI ad alte prestazioni rispetto a quelli per l'elettronica di consumo. Indipendentemente dall'interpretazione specifica, una tale dinamica introduce complessità e potenziali vincoli nella supply chain, rendendo la pianificazione strategica ancora più critica per chi dipende da questi componenti.

Implicazioni per i Deployment On-Premise di LLM

Per CTO, DevOps lead e architetti di infrastruttura, le dinamiche del mercato dei materiali semiconduttori si traducono direttamente in considerazioni pratiche per i deployment di LLM on-premise. La disponibilità di GPU con elevata VRAM, essenziale per l'inference e il fine-tuning di modelli complessi, è strettamente legata alla capacità produttiva e alla stabilità della supply chain dei materiali. Un aumento dei costi o una scarsità di questi materiali potrebbe far lievitare il Total Cost of Ownership (TCO) per l'acquisizione e la manutenzione dell'infrastruttura AI self-hosted.

In un contesto dove la sovranità dei dati e la compliance normativa (come il GDPR) spingono molte aziende verso soluzioni on-premise o air-gapped, la dipendenza da una supply chain potenzialmente instabile o polarizzata rappresenta un rischio. La scelta tra un deployment bare metal o l'utilizzo di container su infrastruttura locale diventa ancora più strategica, richiedendo un'attenta valutazione dei trade-off tra flessibilità, costo e resilienza della catena di approvvigionamento.

Prospettive Future e Strategie di Mitigazione

Lo scenario delineato da Digitimes per il 2026 sottolinea l'importanza di una strategia proattiva nella gestione dell'infrastruttura AI. Le aziende dovranno monitorare attentamente l'evoluzione del mercato dei materiali semiconduttori, valutando l'impatto su prezzi e tempi di consegna dell'hardware. Questo potrebbe includere la diversificazione dei fornitori, l'esplorazione di architetture hardware alternative o l'investimento in soluzioni di ottimizzazione software per massimizzare l'efficienza delle risorse esistenti.

Per chi valuta deployment on-premise, esistono framework analitici per valutare i trade-off tra CapEx e OpEx, la resilienza della supply chain e i requisiti di performance. La capacità di anticipare e adattarsi a queste dinamiche di mercato sarà un fattore chiave per garantire la sostenibilità e l'efficacia delle proprie strategie di intelligenza artificiale a lungo termine.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!