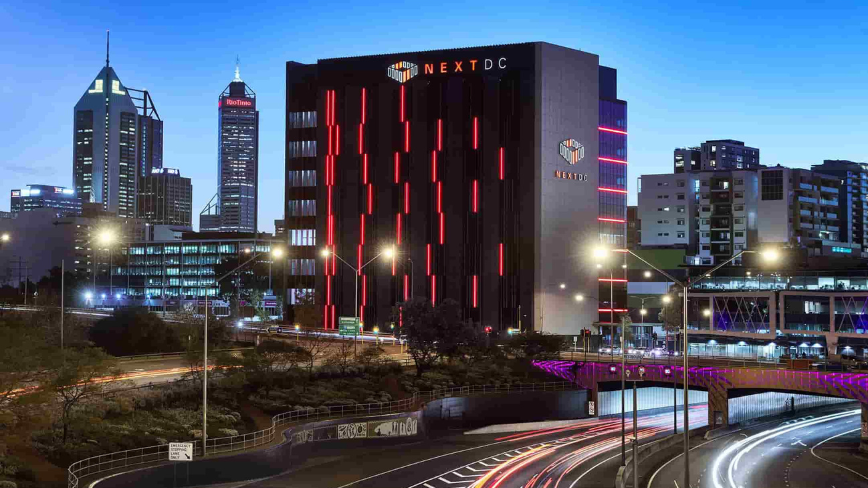

NEXTDC Rafforza la Propria Framework con un Maxi-Finanziamento da 2,2 Miliardi di AUD

NEXTDC, operatore di data center quotato all'ASX, ha annunciato un significativo piano di capitale da 2,2 miliardi di dollari australiani. Questa mossa strategica mira a sostenere l'accelerazione dello sviluppo delle sue infrastrutture, in un momento di crescente domanda per capacità di calcolo e archiviazione dati, particolarmente rilevante per i carichi di lavoro ad alta intensità come quelli legati all'intelligenza artificiale e ai Large Language Models (LLM).

L'investimento sottolinea l'importanza crescente delle infrastrutture fisiche nel panorama tecnicico odierno. Mentre il dibattito si concentra spesso sul software e sugli algoritmi, la base hardware e la rete di data center rimangono pilastri fondamentali per il deployment di soluzioni AI, sia in contesti cloud che, in particolare, on-premise. L'espansione di NEXTDC si inserisce in questo contesto, fornendo la capacità necessaria per supportare le future esigenze delle imprese.

Dettagli Finanziari e Progetti di Espansione

Il piano di finanziamento di NEXTDC si articola attraverso diverse componenti. L'azienda sta raccogliendo 1,5 miliardi di dollari australiani tramite un'offerta azionaria interamente sottoscritta, affiancata da un'espansione del suo programma di titoli ibridi per ulteriori 700 milioni di dollari australiani. Un elemento chiave di questa operazione è l'impegno di La Caisse de dépôt et placement du Québec, che ha garantito un investimento totale di 1,7 miliardi di dollari australiani, dimostrando una forte fiducia nella strategia di crescita di NEXTDC.

Questi fondi sono destinati principalmente all'accelerazione dello sviluppo del campus S4 a Western Sydney. L'espansione di un campus di data center è un'operazione complessa che richiede ingenti capitali per la costruzione di nuove strutture, l'installazione di sistemi di alimentazione e raffreddamento avanzati, e la predisposizione di connettività a banda larga. Tali investimenti sono cruciali per creare ambienti in grado di ospitare le infrastrutture di calcolo di prossima generazione, essenziali per l'inference e il training di LLM.

Implicazioni per i Carichi di Lavoro AI e il Deployment On-Premise

L'espansione di data center come il campus S4 di NEXTDC ha dirette implicazioni per le organizzazioni che valutano il deployment di carichi di lavoro AI e LLM. La disponibilità di infrastrutture locali e moderne è un fattore critico per le aziende che privilegiano soluzioni self-hosted o ibride rispetto al cloud pubblico. Questo approccio offre maggiore controllo sulla sovranità dei dati, sulla compliance normativa e sulla sicurezza, aspetti fondamentali per settori regolamentati o per applicazioni con dati sensibili.

Un data center all'avanguardia deve essere in grado di supportare l'elevata densità di potenza richiesta dalle GPU di ultima generazione, come le NVIDIA H100 o le AMD Instinct MI300X, che sono il cuore pulsante dell'inference e del training di LLM. Questo include sistemi di raffreddamento efficienti, alimentazione ridondante e una connettività di rete ad alta velocità. Per i CTO e gli architetti di infrastruttura, la scelta di un partner di data center con capacità di espansione garantisce la scalabilità necessaria per far fronte alla crescita esponenziale dei requisiti di calcolo AI, influenzando direttamente il Total Cost of Ownership (TCO) a lungo termine.

Prospettive e Contesto di Mercato

L'investimento di NEXTDC riflette una tendenza più ampia nel mercato globale, dove la domanda di infrastrutture digitali continua a superare l'offerta. L'Australia, in particolare, sta emergendo come un hub tecnicico, e la capacità di ospitare carichi di lavoro AI localmente è strategica per la sua economia digitale. La disponibilità di data center robusti e scalabili è essenziale non solo per le grandi imprese, ma anche per le startup e i centri di ricerca che sviluppano nuove applicazioni basate su LLM.

Per le aziende che considerano il deployment di LLM on-premise, la presenza di operatori come NEXTDC che investono in capacità future è un segnale positivo. Offre alternative al cloud, permettendo di bilanciare performance, costo e controllo. AI-RADAR, ad esempio, fornisce framework analitici su /llm-onpremise per aiutare le organizzazioni a valutare i trade-off tra diverse strategie di deployment, considerando fattori come la latenza, il throughput e i requisiti di VRAM per l'inference e il fine-tuning. La continua espansione delle infrastrutture fisiche è un prerequisito per l'innovazione e l'adozione diffusa dell'intelligenza artificiale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!