La corsa ai chip AI e la posizione di Nvidia

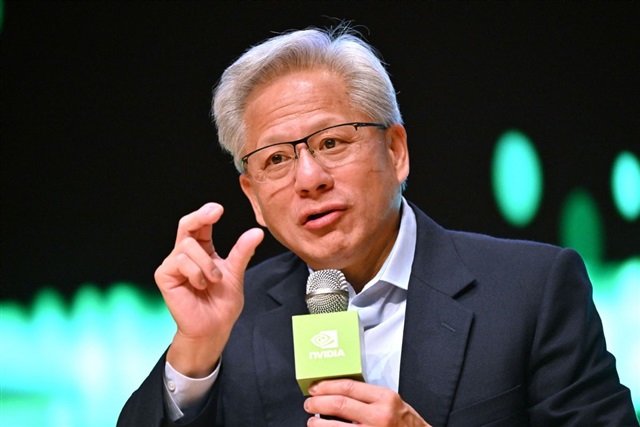

Il panorama dell'intelligenza artificiale è in costante evoluzione, alimentato da una domanda crescente di potenza di calcolo. Al centro di questa trasformazione si trova una vera e propria "corsa ai chip AI", con numerosi attori che competono per fornire le soluzioni hardware più efficienti e performanti. In questo scenario dinamico, il CEO di Nvidia ha recentemente rilasciato una dichiarazione significativa, affermando che i Tensor Processing Units (TPU) di Google non costituiscono una minaccia per la posizione dominante della sua azienda.

Questa prospettiva offre uno spaccato interessante sulla strategia di Nvidia e sulla percezione della competizione. Mentre Nvidia ha consolidato la sua leadership nel settore delle GPU, diventando un pilastro per l'addestramento e l'Inference di Large Language Models (LLM) e altri carichi di lavoro AI, Google ha sviluppato i propri acceleratori custom, i TPU, ottimizzati per le sue infrastrutture e i suoi Framework di machine learning. La dichiarazione del CEO sottolinea la fiducia di Nvidia nella propria architettura e nel proprio ecosistema.

GPU vs. TPU: architetture a confronto

La competizione tra GPU e TPU riflette approcci diversi all'accelerazione AI. Le GPU di Nvidia, come le serie A100 e H100, sono processori altamente paralleli, progettati per una vasta gamma di carichi di lavoro computazionali, inclusi quelli grafici e scientifici, oltre all'AI. Il loro successo è anche legato all'ecosistema CUDA, un Framework software robusto che ha permesso agli sviluppatori di sfruttare appieno la potenza delle GPU per l'addestramento e l'Inference di modelli complessi.

I TPU di Google, d'altra parte, sono Application-Specific Integrated Circuits (ASIC) progettati specificamente per accelerare i carichi di lavoro di machine learning all'interno dei data center di Google. Sono ottimizzati per operazioni di algebra lineare e moltiplicazione di matrici, fondamentali per l'addestramento di reti neurali. Questa specializzazione consente ai TPU di offrire un'elevata efficienza per specifici carichi di lavoro, in particolare quelli che utilizzano Framework come TensorFlow e JAX, nativi dell'ecosistema Google. La loro architettura è stata pensata per scalare all'interno dell'infrastruttura cloud di Google, offrendo performance elevate per i servizi interni e per i clienti della Google Cloud Platform.

Implicazioni per i deployment on-premise

Per le aziende che valutano deployment on-premise di LLM e altre applicazioni AI, la scelta dell'hardware è una decisione critica che va oltre le mere performance di picco. Fattori come il Total Cost of Ownership (TCO), la compatibilità con l'infrastruttura esistente, la disponibilità di VRAM, il Throughput e la facilità di integrazione con stack software locali sono fondamentali. Le GPU di Nvidia beneficiano di un ecosistema maturo e di un'ampia base di sviluppatori, rendendole una scelta versatile per ambienti self-hosted e air-gapped.

Al contrario, l'adozione di TPU al di fuori dell'ecosistema Google è più complessa, data la loro natura proprietaria e l'integrazione profonda con l'infrastruttura cloud di Google. Questo rende le GPU una soluzione più accessibile e flessibile per le organizzazioni che prioritizzano la sovranità dei dati e il controllo completo sul proprio stack tecnicico. La capacità di eseguire Fine-tuning, Inference e altre operazioni AI su hardware proprietario, senza dipendere da servizi cloud esterni, è un requisito sempre più sentito in settori regolamentati o con esigenze stringenti di compliance.

Prospettive future e trade-off decisionali

La "corsa ai chip AI" è destinata a intensificarsi, con l'emergere di nuovi attori e architetture innovative. La dichiarazione del CEO di Nvidia riflette una fiducia nella propria posizione, ma il mercato è in continua evoluzione. Per CTO, DevOps lead e architetti di infrastruttura, la decisione su quale hardware adottare per i carichi di lavoro AI non è mai semplice. Richiede un'attenta valutazione dei trade-off tra costo iniziale (CapEx) e operativo (OpEx), efficienza energetica, scalabilità, supporto software e requisiti di sicurezza.

La scelta tra soluzioni general-purpose come le GPU e acceleratori specializzati come i TPU dipende in ultima analisi dalle specifiche esigenze del carico di lavoro, dal budget e dalla strategia di deployment dell'organizzazione. AI-RADAR offre Framework analitici su /llm-onpremise per aiutare a valutare questi trade-off complessi, fornendo una guida neutrale per le decisioni che prioritizzano sovranità dei dati, controllo e TCO negli ambienti self-hosted. La capacità di scegliere l'hardware più adatto è cruciale per ottimizzare le performance e i costi a lungo termine.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!