Il Supporto di Nvidia all'AI per la Sicurezza Nazionale

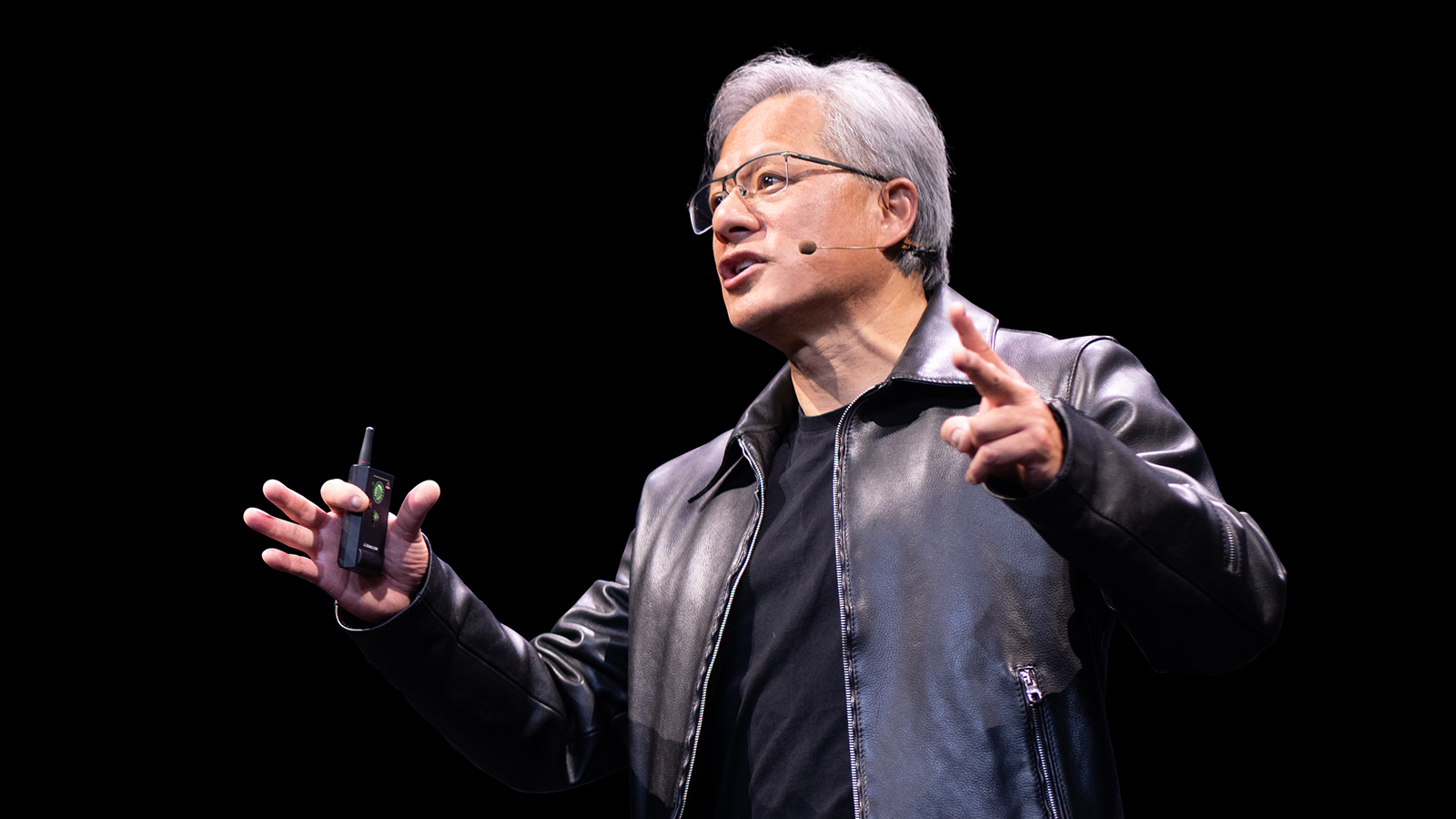

Jensen Huang, CEO di Nvidia, ha recentemente ribadito il suo sostegno all'utilizzo dell'intelligenza artificiale da parte degli Stati Uniti per scopi di sicurezza nazionale. Questa posizione sottolinea la crescente rilevanza strategica dell'AI, e in particolare dei Large Language Models (LLM), in settori critici che richiedono non solo capacità computazionali avanzate, ma anche un controllo rigoroso sui dati e sull'infrastruttura sottostante. La dichiarazione di Huang, pur esprimendo rispetto per una non meglio specificata entità, ha anche evidenziato un disaccordo su alcune delle sue posizioni, suggerendo un dibattito più ampio sulle modalità e i limiti dell'applicazione dell'AI in contesti sensibili.

Per le organizzazioni governative e le infrastrutture critiche, l'adozione di soluzioni AI pone sfide uniche. La necessità di garantire la sovranità dei dati, la conformità normativa e la sicurezza operativa spinge spesso verso architetture di deployment on-premise o air-gapped. Queste scelte, sebbene complesse, offrono un controllo senza pari sui modelli, sui dati di training e sulle pipeline di inference, aspetti fondamentali quando la posta in gioco è la sicurezza nazionale.

Implicazioni Tecniche per i Deployment Critici

L'implementazione di sistemi AI per la sicurezza nazionale richiede specifiche hardware e infrastrutturali di alto livello. Le GPU di Nvidia, come le A100 o le più recenti H100, con le loro elevate capacità di VRAM e throughput, sono spesso al centro di queste architetture, sia per il training intensivo che per l'inference a bassa latenza. La scelta tra diverse configurazioni di silicio e la gestione di requisiti come il tensor parallelism o il pipeline parallelism diventano cruciali per ottimizzare le performance e l'efficienza energetica in ambienti self-hosted.

Un deployment on-premise implica una valutazione approfondita del Total Cost of Ownership (TCO), che include non solo il CapEx iniziale per l'hardware e l'infrastruttura di rete, ma anche i costi operativi per l'energia, il raffreddamento e la manutenzione. La capacità di gestire carichi di lavoro AI in ambienti bare metal o tramite container orchestrati (ad esempio con Kubernetes) è essenziale per mantenere la flessibilità e la scalabilità necessarie, garantendo al contempo che i dati sensibili non lascino mai il perimetro di controllo dell'organizzazione. La Quantization dei modelli, ad esempio, può ridurre i requisiti di VRAM e migliorare il throughput, ma richiede un'attenta valutazione dell'impatto sulla precisione, un trade-off critico in applicazioni di sicurezza.

Contesto Strategico e Trade-off Decisionali

La posizione di Jensen Huang si inserisce in un contesto globale dove la corsa all'AI è vista come un fattore determinante per la leadership tecnicica e la sicurezza. Il dibattito sulle implicazioni etiche, sulla governance e sul controllo dell'AI è più acceso che mai. Per le entità che operano in settori ad alta sensibilità, la decisione di adottare soluzioni AI basate su cloud o di investire in infrastrutture on-premise è strategica. Se da un lato il cloud offre scalabilità e costi operativi iniziali ridotti, dall'altro le soluzioni self-hosted garantiscono la piena sovranità dei dati e la possibilità di operare in ambienti air-gapped, essenziali per prevenire accessi non autorizzati o fughe di informazioni.

Questi trade-off non sono solo tecnici, ma anche economici e strategici. La capacità di eseguire Fine-tuning su LLM proprietari con dati sensibili, mantenendo il controllo completo sulla pipeline di sviluppo e deployment, è un vantaggio competitivo e una necessità operativa per molti attori della sicurezza nazionale. La scelta del Framework di deployment e degli strumenti di orchestrazione deve bilanciare performance, sicurezza e facilità di gestione.

Prospettive Future per l'AI e la Sovranità

L'evoluzione dell'intelligenza artificiale continuerà a porre nuove sfide e opportunità per la sicurezza nazionale. La capacità di sviluppare, deployare e gestire LLM in modo sicuro e controllato sarà un pilastro fondamentale per la resilienza e l'innovazione. Le dichiarazioni di leader del settore come Huang evidenziano la complessità di questo scenario, dove l'innovazione tecnicica si scontra con esigenze di controllo e sovranità.

Per CTO, DevOps lead e architetti di infrastruttura che valutano queste alternative, AI-RADAR offre framework analitici su /llm-onpremise per comprendere i trade-off tra soluzioni self-hosted e cloud. La decisione finale dipenderà da un'attenta analisi dei requisiti specifici in termini di sicurezza, compliance, performance e TCO, con un'enfasi crescente sulla capacità di mantenere il pieno controllo sui propri asset digitali più critici.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!