Introduzione

OpenAI ha recentemente ampliato le capacità di ChatGPT con una nuova funzionalità dedicata alla finanza personale. Questa iniziativa permette agli abbonati di connettere direttamente i propri dati finanziari al chatbot, aprendo nuove frontiere per l'interazione con le informazioni bancarie e di investimento.

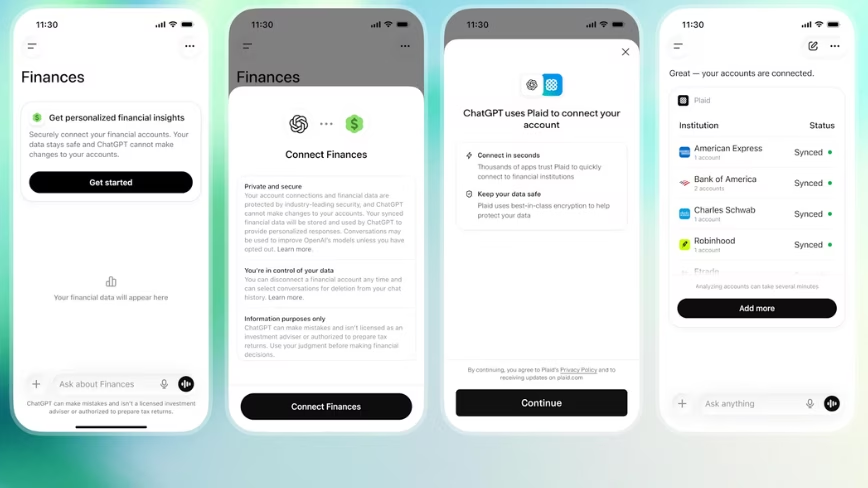

La funzione, lanciata il 15 maggio, è attualmente disponibile in anteprima per gli utenti ChatGPT Pro negli Stati Uniti, accessibile tramite le piattaforme web e iOS. L'obiettivo dichiarato è offrire una maggiore comodità nell'accesso e nell'analisi dei propri dati finanziari attraverso un'interfaccia conversazionale.

Dettagli Tecnici e Funzionalità

Nello specifico, la nuova esperienza consente agli utenti di collegare una vasta gamma di account finanziari, inclusi conti bancari, carte di credito, portafogli di investimento e conti di prestito. Una volta stabilita la connessione, gli abbonati possono porre domande a ChatGPT basate sui loro dati finanziari reali, ottenendo risposte e analisi personalizzate.

Questa integrazione rappresenta un passo significativo verso l'utilizzo degli LLM per compiti che richiedono l'elaborazione di informazioni altamente sensibili. Sebbene la fonte non specifichi i dettagli tecnici dell'integrazione, è plausibile che si basi su API di terze parti per l'accesso ai dati bancari, con un'enfasi sulla sicurezza e sulla crittografia delle comunicazioni.

Implicazioni per la Sovranità dei Dati e la Sicurezza

L'introduzione di una funzionalità che gestisce dati finanziari personali solleva immediatamente questioni cruciali in merito alla sovranità dei dati e alla sicurezza. Per le aziende e gli individui che operano in settori regolamentati o che richiedono un controllo rigoroso sulle proprie informazioni, l'idea di affidare dati così sensibili a un servizio cloud di terze parti può rappresentare una sfida significativa.

Le decisioni di deployment per LLM che elaborano dati sensibili spesso gravitano verso soluzioni self-hosted o air-gapped, proprio per mantenere il controllo completo sull'infrastruttura e sui dati. La valutazione del TCO in questi scenari include non solo i costi hardware e software, ma anche quelli legati alla compliance normativa e alla gestione del rischio. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare trade-off tra controllo, sicurezza e costi operativi.

Prospettive Future e Trade-off

Mentre la comodità offerta da un'integrazione così profonda è innegabile per l'utente finale, il compromesso tra accessibilità e sicurezza dei dati rimane un punto focale. Le organizzazioni che considerano l'adozione di LLM per applicazioni simili devono ponderare attentamente i rischi associati alla gestione di dati finanziari in ambienti non completamente controllati.

La scelta tra un approccio basato su cloud e un deployment on-premise diventa ancora più critica quando si tratta di informazioni personali e finanziarie. La capacità di mantenere i dati all'interno dei propri confini infrastrutturali, garantendo al contempo la conformità alle normative locali e internazionali, è un fattore determinante per molti decision-maker tecnicici.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!