La corsa all'infrastruttura AI rallenta: il 40% dei data center USA a rischio ritardo

La Silicio Valley sta riversando centinaia di miliardi di dollari nella costruzione di data center per l'intelligenza artificiale, infrastrutture sempre più imponenti che richiedono un fabbisogno energetico paragonabile a quello di centinaia di migliaia di abitazioni statunitensi. Tuttavia, questa massiccia espansione si trova ad affrontare sfide significative sul fronte della costruzione e dell'approvvigionamento energetico, aggravate da una crescente resistenza a livello locale. Un'analisi recente evidenzia come quasi il 40% dei progetti di data center negli Stati Uniti, con completamento previsto per il 2026, potrebbe non essere ultimato quest'anno come da programma.

Questi ritardi non solo complicano la capacità delle aziende di scalare le proprie operazioni AI, ma sollevano anche interrogativi sulla sostenibilità e sulla pianificazione a lungo termine dell'infrastruttura necessaria per alimentare la prossima generazione di Large Language Models (LLM) e altre applicazioni di intelligenza artificiale. Per le organizzazioni che valutano il deployment di LLM self-hosted, la disponibilità e i tempi di consegna delle infrastrutture fisiche diventano un fattore critico nella valutazione del Total Cost of Ownership (TCO) e nella strategia di adozione.

Dettagli dell'analisi e impatto sui giganti tech

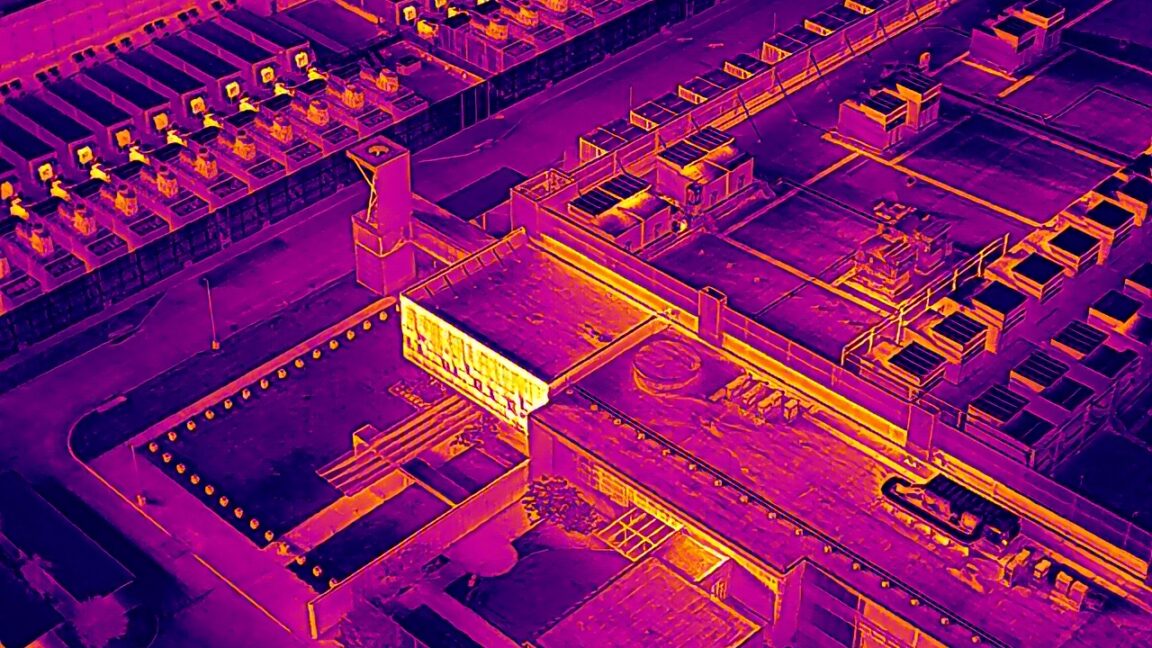

L'analisi, condotta dal Financial Times, ha utilizzato immagini satellitari fornite dalla società di analisi geospaziale SynMax per monitorare i progressi nella bonifica dei terreni e nella posa delle fondamenta per ciascun progetto di data center. I dati sono stati poi incrociati con dichiarazioni pubbliche e documenti di permesso raccolti dal gruppo di ricerca IIR Energy. Questa metodologia ha permesso di rivelare che importanti progetti di aziende tecniciche come Microsoft, Oracle e OpenAI rischiano di mancare le date di completamento di oltre tre mesi.

La precisione di queste stime, basate su dati concreti di avanzamento lavori, offre una prospettiva chiara sulle difficoltà che il settore sta incontrando. Le implicazioni sono notevoli, considerando che questi data center sono destinati a ospitare le risorse di calcolo essenziali per l'addestramento e l'inference di modelli AI sempre più complessi, influenzando direttamente la capacità del mercato di soddisfare la domanda crescente di potenza computazionale.

Le cause dei rallentamenti: manodopera, energia e burocrazia

Le interviste con oltre una dozzina di dirigenti del settore, riportate dal Financial Times, hanno messo in luce le cause principali di questi ritardi. Tra queste spiccano carenze croniche di manodopera specializzata, in particolare elettricisti e idraulici, essenziali per la complessa installazione degli impianti nei data center. A ciò si aggiungono problemi di approvvigionamento energetico e di disponibilità di attrezzature specifiche, oltre alle lungaggini nel processo di ottenimento dei permessi necessari.

Questi vincoli non sono solo di natura logistica o finanziaria, ma riflettono anche una sfida più ampia nella catena di approvvigionamento e nella pianificazione infrastrutturale. La domanda di energia per i data center AI è senza precedenti, e la capacità delle reti elettriche esistenti di supportare tale carico, insieme alla resistenza delle comunità locali all'installazione di nuove infrastrutture, rappresenta un ostacolo significativo. Per le aziende che considerano un'infrastruttura AI self-hosted, questi fattori si traducono in tempi di deployment più lunghi e costi potenzialmente più elevati.

Prospettive future e implicazioni per il deployment di LLM

I ritardi nella costruzione dei data center AI evidenziano una tensione crescente tra l'ambizione di espansione del settore tecnicico e le realtà operative sul campo. La disponibilità di infrastrutture adeguate è un prerequisito fondamentale per l'adozione su larga scala dell'intelligenza artificiale, in particolare per i carichi di lavoro che richiedono elevata potenza di calcolo e bassa latenza, come l'inference di LLM.

Questi rallentamenti potrebbero avere un impatto a cascata sull'intero ecosistema AI, influenzando la roadmap di sviluppo di nuovi modelli e la capacità delle imprese di implementare soluzioni basate su AI. Per chi valuta deployment on-premise, è cruciale considerare questi vincoli infrastrutturali nella pianificazione strategica, poiché la disponibilità di risorse hardware e la rapidità di deployment non possono più essere date per scontate. AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra diverse strategie di deployment, tenendo conto di fattori come TCO, sovranità dei dati e requisiti di performance.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!