Semiconduttori in Fosfuro di Indio: Nuovi Orizzonti per Potenza e Larghezza di Banda nell'AI

L'evoluzione dei Large Language Models (LLM) e delle applicazioni di intelligenza artificiale continua a spingere i limiti dell'hardware esistente, generando una domanda crescente di maggiore potenza di calcolo e larghezza di banda, il tutto con un'efficienza energetica ottimizzata. In questo contesto, i semiconduttori composti a base di fosfuro di indio (InP) stanno emergendo come una tecnicia chiave, promettendo di superare alcune delle barriere fondamentali che oggi limitano le performance e il consumo energetico dei sistemi AI. La capacità di questi materiali di gestire carichi di lavoro intensivi con maggiore efficienza potrebbe ridefinire le strategie di deployment per le infrastrutture AI, in particolare per quelle self-hosted.

Il Ruolo dei Semiconduttori InP nell'AI

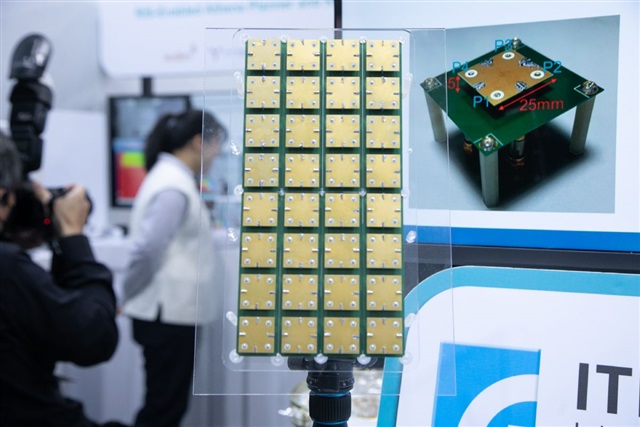

I semiconduttori tradizionali, basati sul silicio, hanno raggiunto livelli di maturità elevati, ma presentano limiti intrinseci quando si tratta di applicazioni che richiedono velocità estreme e bassi consumi energetici, come l'inference e il training di LLM. Il fosfuro di indio, invece, offre proprietà superiori in termini di mobilità elettronica e gestione del calore. Queste caratteristiche consentono ai chip basati su InP di operare a frequenze più elevate e con una dissipazione di potenza inferiore rispetto al silicio, facilitando la creazione di interconnessioni ad alta velocità e moduli fotonici integrati. Tale integrazione è cruciale per superare i colli di bottiglia della larghezza di banda, un fattore limitante sempre più evidente nelle architetture di calcolo parallelo necessarie per gli LLM. La promessa è quella di abilitare una nuova generazione di acceleratori AI capaci di elaborare un volume maggiore di token per secondo con un'efficienza energetica significativamente migliorata.

Implicazioni per i Deployment On-Premise

Per le aziende che valutano deployment on-premise di infrastrutture AI, l'introduzione di semiconduttori InP potrebbe avere un impatto trasformativo. La maggiore efficienza energetica si traduce direttamente in un TCO (Total Cost of Ownership) inferiore, riducendo i costi operativi legati all'alimentazione e al raffreddamento dei data center. Inoltre, la capacità di gestire una larghezza di banda superiore è fondamentale per scalare i carichi di lavoro AI, permettendo di utilizzare modelli più grandi o di servire un numero maggiore di utenti con latenze ridotte. Questo è particolarmente rilevante per ambienti air-gapped o per scenari dove la sovranità dei dati è una priorità assoluta, poiché consente di mantenere le operazioni AI critiche all'interno dei propri confini infrastrutturali senza compromettere le performance. La scelta di hardware basato su InP potrebbe quindi offrire un vantaggio competitivo significativo, bilanciando performance e sostenibilità economica.

Prospettive Future e Sfide

Nonostante il potenziale, l'adozione su larga scala dei semiconduttori InP nell'hardware AI presenta ancora delle sfide. La produzione di massa di chip InP è più complessa e costosa rispetto a quella del silicio, richiedendo processi di fabbricazione specializzati. Tuttavia, gli investimenti in ricerca e sviluppo stanno accelerando, con l'obiettivo di rendere queste tecnicie più accessibili e scalabili. Nel lungo termine, l'integrazione di InP potrebbe non solo migliorare le performance degli acceleratori dedicati, ma anche aprire la strada a nuove architetture di calcolo, come i sistemi neuromorfici o i computer quantistici, che potrebbero beneficiare enormemente delle proprietà uniche di questi materiali. Per i CTO e gli architetti di infrastruttura, monitorare l'evoluzione dei semiconduttori InP sarà cruciale per pianificare i futuri upgrade e per garantire che le proprie infrastrutture AI rimangano all'avanguardia.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!