L'imperativo della velocità nei server AI

La domanda di potenza di calcolo per l'intelligenza artificiale, in particolare per i Large Language Models (LLM) e l'AI generativa, sta crescendo a ritmi esponenziali. Questa spinta non riguarda unicamente l'evoluzione delle GPU, ma coinvolge l'intero stack hardware, dai processori alla memoria, fino alle interconnessioni. Per sostenere carichi di lavoro sempre più complessi e voluminosi, i server AI devono garantire performance elevate e una latenza minima.

In questo contesto, l'esigenza di server AI più veloci determina un cambiamento significativo nella progettazione e nella produzione dei componenti. Ogni elemento dell'infrastruttura deve essere ottimizzato per gestire un throughput di dati massiccio e garantire l'integrità del segnale. Le performance complessive di un sistema AI sono, infatti, la somma delle sue parti, e un singolo collo di bottiglia può compromettere l'efficienza dell'intero deployment.

Il ruolo cruciale delle tecnicie PCB avanzate

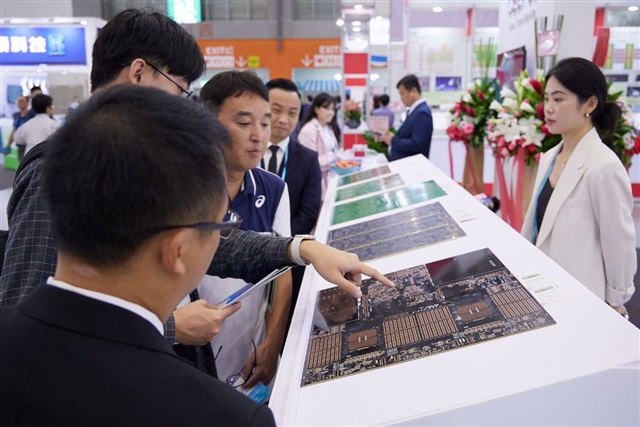

Le schede a circuito stampato (PCB) rappresentano un elemento fondamentale, spesso sottovalutato, nell'architettura dei server AI moderni. Con l'aumento delle frequenze operative e della densità dei componenti, le PCB tradizionali non sono più sufficienti. Le nuove generazioni di server AI richiedono PCB capaci di supportare una maggiore densità di segnale, mantenere l'integrità del segnale a frequenze elevate e gestire efficacemente la distribuzione della potenza e la dissipazione del calore.

Questo ha portato all'adozione di materiali dielettrici a bassa perdita, design multistrato complessi e tecniche di routing avanzate. Tali innovazioni sono essenziali per supportare interconnessioni ad alta velocità, come le recenti evoluzioni di PCIe e NVLink, che collegano GPU e altri acceleratori con bandwidth sempre maggiori. La capacità di una PCB di gestire questi requisiti influenza direttamente la velocità con cui i dati possono essere trasferiti tra la VRAM delle GPU e gli altri componenti, impattando in modo critico le performance di training e inference degli LLM.

Implicazioni per i deployment on-premise di LLM

Per le organizzazioni che scelgono un deployment on-premise o self-hosted per i propri carichi di lavoro AI, l'evoluzione delle tecnicie PCB ha implicazioni significative. L'investimento in server dotati di PCB avanzate incide sul Total Cost of Ownership (TCO), considerando non solo i costi iniziali (CapEx) ma anche l'efficienza energetica e i cicli di aggiornamento dell'hardware. Server più performanti, ma anche più complessi, richiedono una gestione più sofisticata dell'infrastruttura, inclusi sistemi di raffreddamento avanzati, maggiore spazio nel datacenter e un'alimentazione robusta.

La scelta di tecnicie hardware all'avanguardia è particolarmente rilevante per chi privilegia la sovranità dei dati, la compliance normativa e la sicurezza in ambienti air-gapped. In questi scenari, il controllo completo sull'hardware e sull'infrastruttura è paramount. La capacità di un'organizzazione di implementare e gestire efficacemente server AI con PCB avanzate diventa un fattore critico per il successo dei deployment di LLM. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra performance, costi e controllo.

Prospettive future e sfide

La spinta verso server AI sempre più performanti è destinata a continuare, e con essa l'evoluzione delle tecnicie PCB. Le sfide future includeranno la miniaturizzazione, l'integrazione di un numero crescente di componenti e l'esplorazione di nuovi materiali esotici per migliorare ulteriormente le performance elettriche e termiche. L'efficienza energetica delle PCB sarà un fattore sempre più critico, in quanto l'industria cerca di ridurre l'impronta carbonica dei datacenter e i costi operativi associati al consumo energetico.

In sintesi, la performance di un sistema AI è la somma delle sue parti, e le PCB, sebbene spesso invisibili, sono un anello critico della catena. Comprendere l'impatto delle tecnicie PCB avanzate è essenziale per CTO, DevOps lead e architetti di infrastruttura che devono prendere decisioni informate sui deployment di LLM, bilanciando performance, costi e requisiti di sovranità dei dati in un panorama tecnicico in rapida evoluzione.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!