Il Boom dei Server AI e la Domanda di Raffreddamento Avanzato

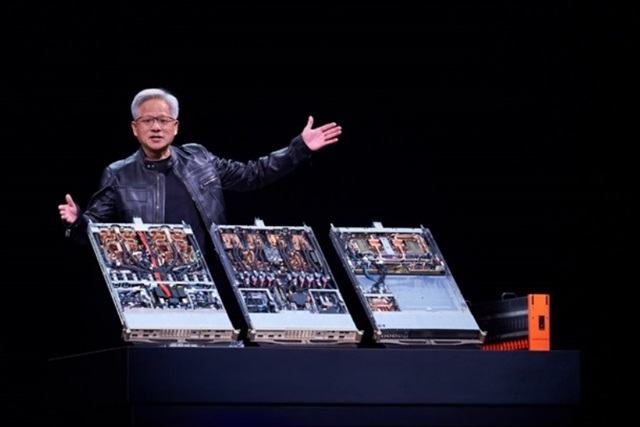

L'espansione esponenziale dell'intelligenza artificiale, in particolare dei Large Language Models (LLM), sta generando una domanda senza precedenti di server ad alte prestazioni. Questi sistemi, equipaggiati con un numero crescente di GPU potenti, sono il cuore pulsante delle operazioni di training e Inference AI. Tuttavia, la loro elevata capacità di calcolo si traduce in una produzione di calore significativa, rendendo le soluzioni di gestione termica un componente critico e spesso sottovalutato dell'infrastruttura.

In questo scenario, le aziende taiwanesi specializzate in soluzioni termiche stanno vivendo un periodo di forte crescita. Secondo le analisi di mercato, player come AVC e Auras sono posizionati per guidare un'ondata di espansione entro il 2026, capitalizzando sul fabbisogno di sistemi di raffreddamento sempre più sofisticati per i server AI di nuova generazione. Questo trend sottolinea l'importanza strategica della supply chain per l'hardware AI.

Il Ruolo Cruciale del Raffreddamento nell'AI On-Premise

Per le organizzazioni che scelgono di implementare carichi di lavoro AI, inclusi LLM, in ambienti self-hosted o air-gapped, l'efficienza del raffreddamento è un fattore determinante. GPU come le NVIDIA A100 o H100, con le loro elevate quantità di VRAM e la densità di calcolo, possono generare centinaia di watt di calore ciascuna. Senza un'adeguata dissipazione, le temperature operative possono superare i limiti, portando a throttling delle performance, instabilità del sistema e, nel lungo termine, a guasti hardware.

La scelta tra raffreddamento ad aria e soluzioni a liquido, come il direct-to-chip liquid cooling, diventa quindi una decisione architetturale chiave. Mentre il raffreddamento ad aria è più semplice da implementare, le soluzioni a liquido offrono una capacità di dissipazione termica superiore, essenziale per server ad altissima densità e per mantenere un throughput costante durante sessioni intensive di training o Inference. Questa scelta ha un impatto diretto non solo sulle performance ma anche sulla longevità dell'hardware e sull'affidabilità complessiva del deployment.

Implicazioni per l'Framework e il TCO

L'integrazione di sistemi di raffreddamento avanzati ha profonde implicazioni per la progettazione e la gestione dell'infrastruttura AI. A livello di CapEx, le soluzioni a liquido possono richiedere un investimento iniziale maggiore, ma possono anche consentire una maggiore densità di calcolo per rack, ottimizzando lo spazio nel data center. A livello di OpEx, l'efficienza energetica dei sistemi di raffreddamento incide direttamente sui costi operativi, in particolare sul consumo elettrico, che rappresenta una componente significativa del Total Cost of Ownership (TCO) per le infrastrutture AI su larga scala.

La gestione termica non riguarda solo la prevenzione del surriscaldamento, ma anche il mantenimento di temperature ottimali per massimizzare la vita utile dei componenti e garantire prestazioni predittive. Per CTO e architetti di infrastruttura, valutare attentamente le opzioni di raffreddamento è fondamentale per bilanciare performance, costi e sostenibilità a lungo termine del deployment AI. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise che possono aiutare a valutare questi trade-off.

Prospettive Future e Sovranità dei Dati

Il trend di crescita delle aziende taiwanesi nel settore delle soluzioni termiche evidenzia una componente critica della catena di fornitura tecnicica per l'AI. Man mano che le organizzazioni cercano di implementare LLM e altre applicazioni AI in ambienti controllati, per ragioni di sovranità dei dati, compliance o sicurezza air-gapped, la capacità di gestire efficacemente il calore generato dall'hardware diventa un fattore abilitante.

The availability of robust and scalable cooling solutions is therefore essential to support the widespread adoption of self-hosted AI infrastructures. The thermal solutions market, led by innovators like AVC and Auras, is set to play an increasingly central role in shaping the future of AI deployments, ensuring that the necessary computational power can operate reliably and efficiently, regardless of workload complexity or specific deployment requirements.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!