La Crescita di Viking AI e le Sfide della Supply Chain

Viking AI ha recentemente annunciato un incremento del 12% nei suoi ricavi, un dato che sottolinea la continua espansione del settore dell'intelligenza artificiale e la capacità dell'azienda di capitalizzare su questa tendenza. Questo risultato positivo si inserisce in un contesto di forte domanda per soluzioni AI, che spinge molte organizzazioni a investire in infrastrutture dedicate, sia in cloud che on-premise.

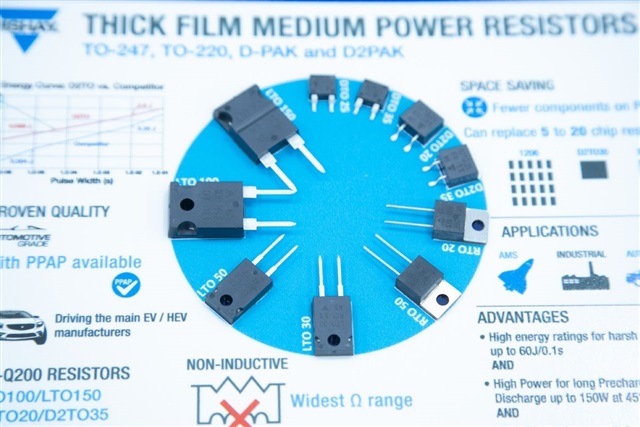

Tuttavia, il successo di Viking AI emerge in un panorama industriale caratterizzato da crescenti complessità. Parallelamente all'annuncio dei ricavi, si registra un significativo allungamento dei tempi di consegna per i resistori, componenti elettronici fondamentali. Questi tempi si sono estesi fino a 15 settimane, un segnale preoccupante per l'intera catena di approvvigionamento tecnicica.

L'Impatto dei Tempi di Consegna sui Componenti Critici

L'estensione dei tempi di consegna per componenti come i resistori non è un fenomeno isolato, ma riflette una pressione più ampia sulla supply chain globale. I resistori, pur essendo elementi relativamente semplici, sono ubiquitari in quasi ogni dispositivo elettronico, dai server ai sistemi embedded, e la loro scarsità può avere un effetto a cascata sulla produzione di hardware più complesso.

Per le aziende che sviluppano o implementano soluzioni AI, questo significa potenziali ritardi nella produzione di schede madri, GPU, unità di alimentazione e altri moduli essenziali. Tali ritardi possono a loro volta influenzare la capacità di scalare le infrastrutture AI, sia per il training di Large Language Models che per l'Inference su larga scala. La disponibilità di silicio e altri componenti è un fattore critico per mantenere la competitività e rispettare le roadmap di sviluppo.

Implicazioni per i Deployment On-Premise di LLM

Per i CTO, i responsabili DevOps e gli architetti di infrastruttura che valutano deployment on-premise di LLM, l'allungamento dei tempi di consegna dei componenti rappresenta una sfida diretta. La decisione di ospitare l'infrastruttura AI in locale è spesso motivata da esigenze di sovranità dei dati, compliance normativa, controllo sui costi a lungo termine (TCO) e la necessità di ambienti air-gapped. Tuttavia, questi vantaggi possono essere mitigati se l'acquisizione dell'hardware necessario subisce ritardi prolungati.

La pianificazione strategica diventa quindi cruciale. Le organizzazioni devono considerare non solo le specifiche tecniche delle GPU (come VRAM e throughput), ma anche la resilienza della supply chain dei fornitori hardware. Questo potrebbe significare ordini anticipati, diversificazione dei fornitori o la necessità di mantenere scorte di sicurezza, tutti fattori che influenzano il TCO complessivo e la velocità di deployment. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare trade-off complessi tra disponibilità, costo e controllo.

Prospettive Future e Strategie di Mitigazione

Di fronte a queste sfide, l'industria sta esplorando diverse strategie per mitigare i rischi legati alla supply chain. Alcune aziende stanno investendo in una maggiore integrazione verticale, producendo internamente più componenti, mentre altre cercano di diversificare la loro base di fornitori geograficamente. La progettazione di hardware con maggiore flessibilità nell'uso dei componenti, permettendo la sostituzione con alternative più disponibili, è un'altra via.

La resilienza della supply chain è destinata a rimanere un tema centrale per il settore tecnicico, in particolare per l'AI, che è fortemente dipendente da hardware specializzato. La capacità di un'azienda come Viking AI di crescere in questo contesto evidenzia l'importanza di una gestione agile e proattiva delle risorse e delle relazioni con i fornitori, aspetti che saranno sempre più determinanti per il successo nel panorama competitivo dell'intelligenza artificiale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!