Tesla AI5: Un Passo Cruciale Verso la Produzione di Chip AI

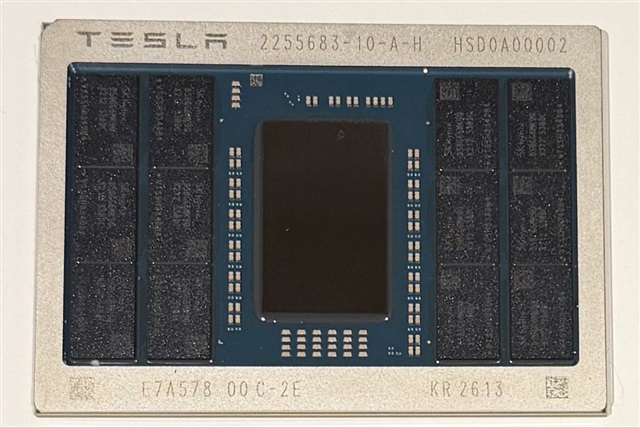

Tesla ha annunciato un traguardo significativo nello sviluppo del suo chip dedicato all'intelligenza artificiale, l'AI5: il raggiungimento del "tape-out". Questo termine, fondamentale nel settore della progettazione di semiconduttori, indica che il design del chip è stato completato e validato, ed è ora pronto per essere inviato alla fonderia per la produzione fisica. Si tratta di una fase critica che segna il passaggio dalla progettazione concettuale alla realizzazione concreta dell'hardware.

L'annuncio, condiviso da fonti vicine all'azienda come @elonmusk, sottolinea l'impegno di Tesla nel rafforzare le proprie capacità interne per l'elaborazione di carichi di lavoro AI. Lo sviluppo di silicio proprietario è una strategia sempre più adottata da grandi aziende tecniciche per ottimizzare le performance, ridurre i costi operativi a lungo termine e garantire un controllo più stringente sull'intera pipeline tecnicica, aspetti cruciali per chi valuta deployment on-premise di Large Language Models (LLM).

Dettagli Tecnici e Implicazioni della Memoria

Un dettaglio emerso dai primi campioni del chip AI5 è l'integrazione di memoria SK Hynix. Questa scelta non è casuale e ha implicazioni dirette sulle prestazioni e sull'efficienza del processore. La memoria è un componente vitale per i carichi di lavoro AI, in particolare per gli LLM, dove la quantità di VRAM e la sua larghezza di banda determinano la capacità di gestire modelli di grandi dimensioni e di elaborare un elevato throughput di token.

La selezione di un fornitore specifico come SK Hynix suggerisce una strategia mirata a bilanciare performance, costo e disponibilità nella supply chain. Per le aziende che considerano un deployment self-hosted di infrastrutture AI, la scelta della memoria e del silicio sottostante è un fattore determinante per il Total Cost of Ownership (TCO) e per la capacità di scalare le operazioni mantenendo la sovranità dei dati e la compliance normativa.

Contesto e Prospettive per i Deployment AI

Lo sviluppo di chip AI proprietari come l'AI5 di Tesla si inserisce in un trend più ampio che vede le aziende cercare soluzioni hardware ottimizzate per le proprie esigenze specifiche. Questo approccio contrasta con l'affidamento esclusivo a GPU general-purpose, offrendo potenzialmente vantaggi in termini di efficienza energetica, latenza e costi per carichi di lavoro AI specifici. Per i CTO e gli architetti di infrastrutture, la disponibilità di silicio specializzato apre nuove opportunità per ottimizzare i deployment on-premise.

La capacità di controllare l'hardware a livello di chip permette alle organizzazioni di creare ambienti air-gapped o altamente sicuri, essenziali per settori con stringenti requisiti di privacy e sovranità dei dati. Tuttavia, la progettazione e la produzione di chip sono processi complessi e costosi, che richiedono investimenti significativi e competenze specialistiche, rappresentando un trade-off rispetto alla flessibilità e alla disponibilità delle soluzioni cloud.

Il Ruolo di AI-RADAR e le Decisioni Strategiche

L'evoluzione dell'hardware AI, come dimostrato dal chip AI5 di Tesla, rende ancora più critica la valutazione delle opzioni di deployment per le aziende. La scelta tra infrastrutture cloud e soluzioni self-hosted, o un approccio ibrido, dipende da una moltitudine di fattori, inclusi il TCO, le esigenze di performance, i vincoli di sicurezza e la sovranità dei dati.

AI-RADAR si propone di fornire framework analitici e approfondimenti tecnici per supportare i decision-maker in questo processo. Comprendere le specifiche hardware, le implicazioni della supply chain e i trade-off tra le diverse architetture è fondamentale per costruire infrastrutture AI resilienti e performanti. Per chi valuta deployment on-premise, AI-RADAR offre risorse e analisi su /llm-onpremise per approfondire questi aspetti e prendere decisioni informate.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!