Tesla AI5: Un Nuovo Capitolo per il Calcolo AI

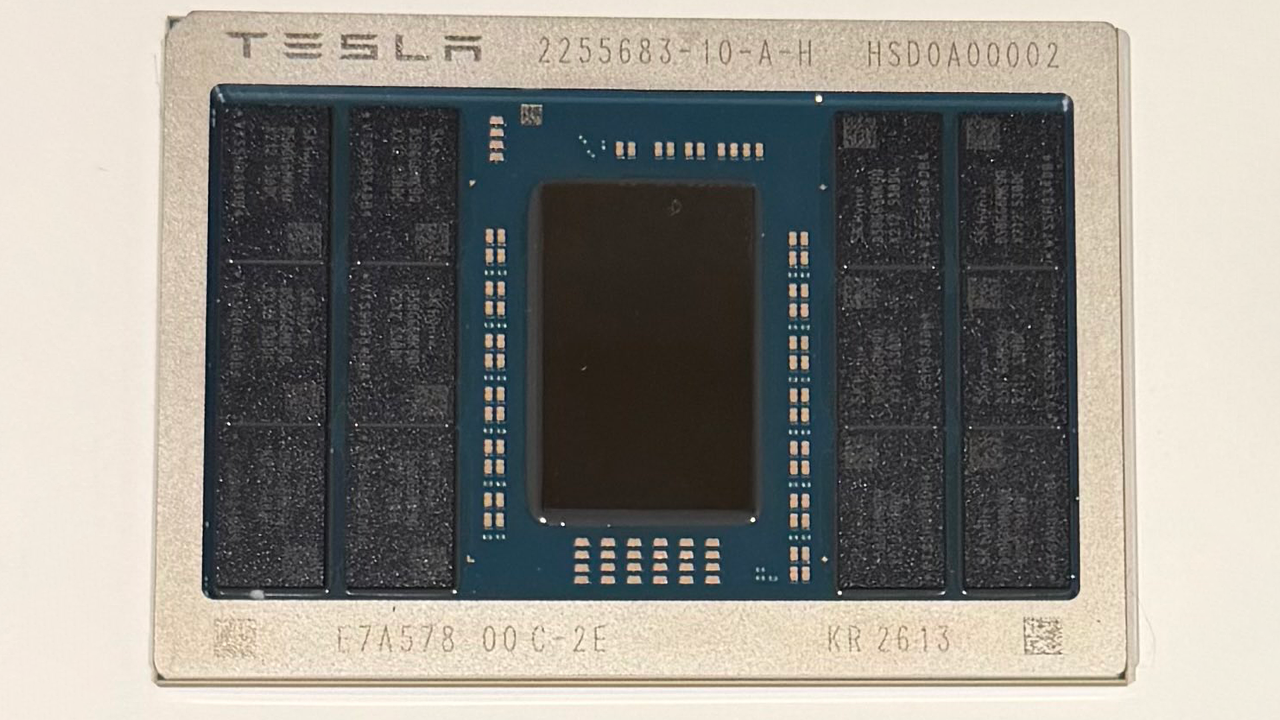

Elon Musk ha recentemente svelato il primo esemplare del processore Tesla AI5, un chip che promette di ridefinire le capacità di calcolo dell'azienda nel campo dell'intelligenza artificiale. Durante la presentazione, Musk ha annunciato un incremento prestazionale sbalorditivo, pari a 40 volte rispetto al suo predecessore. L'evento è stato anche caratterizzato da un piccolo lapsus, con il CEO di Tesla che ha ringraziato "TSC" invece di "TSMC", il colosso taiwanese della produzione di semiconduttori.

Questo annuncio sottolinea l'impegno di Tesla nello sviluppo di silicio proprietario, una strategia che mira a ottimizzare l'hardware per le sue specifiche esigenze di AI, in particolare per i sistemi di guida autonoma e i carichi di lavoro di training e Inference dei Large Language Models. La capacità di progettare e, potenzialmente, produrre chip in-house offre un controllo senza precedenti sull'intera pipeline tecnicica, dalla progettazione all'integrazione software.

Implicazioni Tecniche e Prestazionali

Un balzo prestazionale di 40 volte rappresenta un traguardo significativo nel settore dei semiconduttori. Per i carichi di lavoro AI, questo si traduce in una maggiore efficienza nel training di modelli complessi e in una latenza ridotta per le operazioni di Inference. La capacità di elaborare più Token per secondo o di gestire batch size maggiori è cruciale per applicazioni che richiedono risposte in tempo reale e per l'ottimizzazione del Throughput complessivo.

Per le organizzazioni che valutano il deployment di LLM on-premise, l'emergere di processori altamente specializzati come il Tesla AI5 offre nuove opportunità. Questi chip possono ridurre drasticamente i requisiti di VRAM per singolo modello o consentire l'esecuzione di modelli più grandi e complessi localmente, affrontando le sfide legate alla scalabilità e ai costi operativi. La scelta di hardware dedicato è spesso un fattore chiave per raggiungere un TCO competitivo rispetto alle soluzioni basate su cloud.

Controllo, Sovranità e Deployment On-Premise

Lo sviluppo di silicio proprietario da parte di aziende come Tesla riflette una tendenza più ampia nel settore tecnicico: la ricerca di un maggiore controllo sull'intera stack hardware e software. Questa strategia è particolarmente rilevante per le aziende che gestiscono dati sensibili o che operano in ambienti con stringenti requisiti di compliance e sovranità dei dati. Il deployment di infrastrutture AI self-hosted, magari in ambienti air-gapped, diventa più fattibile e performante con hardware ottimizzato.

La possibilità di disporre di un chip con prestazioni così elevate può influenzare profondamente le decisioni di deployment. Invece di affidarsi a GPU generiche o a servizi cloud, le aziende possono considerare l'investimento in infrastrutture bare metal equipaggiate con silicio specializzato, ottenendo vantaggi in termini di sicurezza, personalizzazione e, a lungo termine, TCO. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi iniziali, operativi e benefici in termini di controllo e performance.

Prospettive Future per l'Ecosistema AI

L'introduzione di processori come il Tesla AI5 segna un'evoluzione significativa nel panorama dell'hardware per l'intelligenza artificiale. Mentre la corsa allo sviluppo di LLM continua, la disponibilità di silicio sempre più potente ed efficiente è fondamentale per sbloccare nuove capacità e rendere l'AI più accessibile e performante anche in contesti di deployment locali.

Questi progressi spingono le aziende a riconsiderare le proprie strategie infrastrutturali, bilanciando la flessibilità del cloud con i vantaggi di controllo, sicurezza e ottimizzazione dei costi offerti dalle soluzioni self-hosted. La scelta del giusto hardware e della corretta architettura di deployment rimarrà un fattore critico per il successo delle iniziative AI a livello enterprise.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!