Crescono i divieti per i data center AI negli Stati Uniti

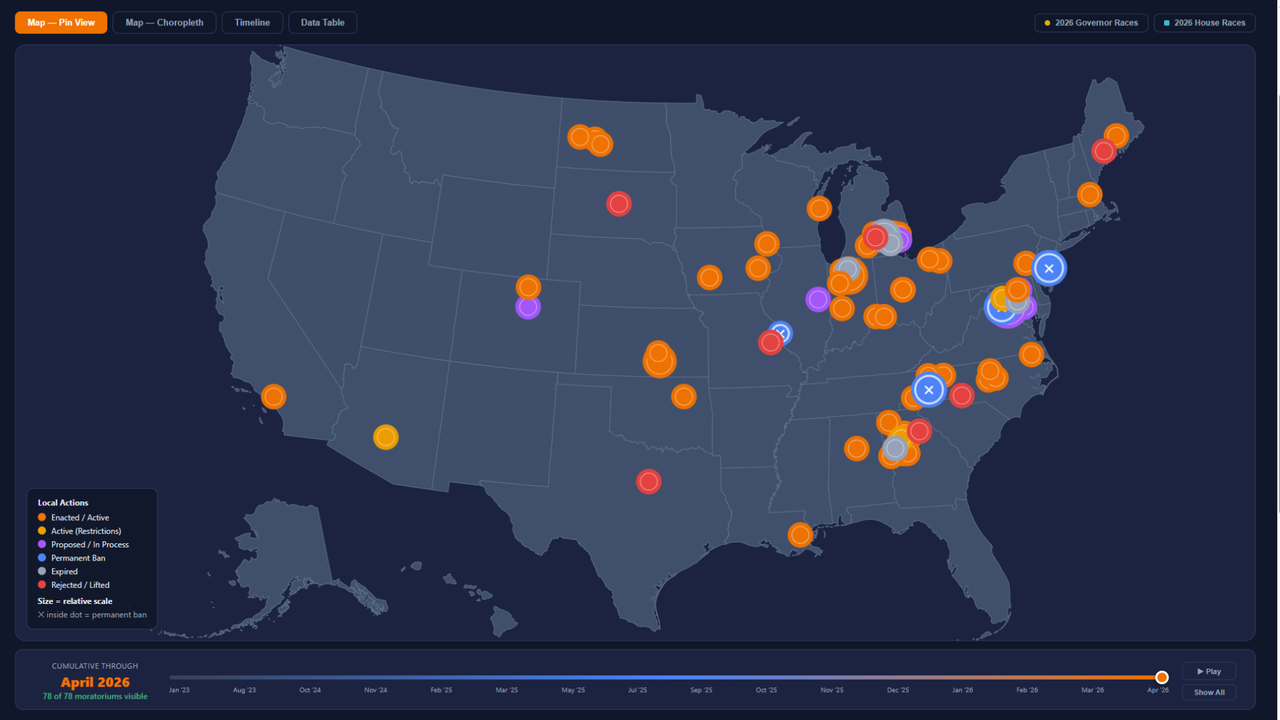

Il panorama infrastrutturale per l'intelligenza artificiale negli Stati Uniti sta affrontando una nuova e significativa sfida: un'ondata di moratorie e divieti sulla costruzione di nuovi data center. Secondo un monitoraggio recente, ben 69 giurisdizioni locali hanno imposto blocchi temporanei o permanenti a queste nuove edificazioni. Di questi, quattro provvedimenti sono stati resi definitivi, segnalando una crescente resistenza a livello comunitario.

Questa tendenza riflette una preoccupazione sempre più diffusa riguardo all'impatto che i moderni data center, in particolare quelli ottimizzati per carichi di lavoro AI, hanno sulle risorse locali. Le questioni principali includono il consumo energetico, l'utilizzo di risorse idriche per il raffreddamento e l'impatto acustico, tutti fattori che stanno spingendo le comunità a riconsiderare l'espansione di queste infrastrutture sul proprio territorio.

Le sfide dei data center per l'intelligenza artificiale

I data center dedicati all'AI si distinguono dalle strutture tradizionali per alcune caratteristiche chiave che ne amplificano l'impatto. Richiedono una densità di potenza significativamente maggiore per alimentare array di GPU ad alte prestazioni, essenziali per l'addestramento e l'Inference di Large Language Models (LLM) e altri modelli complessi. Questa elevata densità energetica si traduce in un maggiore fabbisogno di raffreddamento, spesso tramite sistemi a liquido o ad aria che consumano ingenti quantità di acqua ed energia.

L'infrastruttura necessaria per supportare questi carichi di lavoro, che include server con VRAM elevata e sistemi di networking ad alta velocità, pone sfide considerevoli in termini di pianificazione e gestione. Le aziende che valutano deployment on-premise per i propri carichi di lavoro AI devono considerare non solo i costi iniziali (CapEx) e operativi (OpEx), ma anche la disponibilità di energia, acqua e terreno, oltre alle normative locali che possono variare drasticamente.

Implicazioni per il deployment on-premise e la sovranità dei dati

L'aumento dei divieti sui data center AI ha implicazioni dirette per le organizzazioni che considerano strategie di deployment on-premise o ibride. La difficoltà di trovare siti idonei e l'incertezza normativa possono aumentare il Total Cost of Ownership (TCO) e prolungare i tempi di implementazione. Per le aziende con requisiti stringenti di sovranità dei dati, compliance o per ambienti air-gapped, il deployment on-premise rimane spesso l'unica opzione praticabile.

Tuttavia, queste nuove restrizioni sottolineano la necessità di una pianificazione infrastrutturale ancora più meticolosa. La scelta di un sito, la negoziazione con le autorità locali e la progettazione di sistemi energeticamente efficienti diventano fattori critici. AI-RADAR offre framework analitici su /llm-onpremise per aiutare le aziende a valutare questi trade-off complessi, considerando aspetti come la scalabilità, la latenza e i requisiti di sicurezza in un contesto di crescente scrutinio ambientale e normativo.

Prospettive future e trade-off decisionali

La proliferazione di divieti sui data center AI indica un punto di svolta nel settore. Le comunità stanno diventando più consapevoli e reattive all'impronta ecologica e infrastrutturale dell'intelligenza artificiale. Questo scenario spinge le aziende a riconsiderare le proprie strategie di deployment, bilanciando la necessità di potenza computazionale con la sostenibilità e la conformità normativa.

Mentre il cloud offre flessibilità e scalabilità apparentemente illimitate, il controllo sui dati e l'ottimizzazione del TCO a lungo termine spesso favoriscono soluzioni self-hosted. La sfida per il futuro sarà trovare un equilibrio tra l'innovazione tecnicica e la responsabilità ambientale e sociale, garantendo che l'espansione dell'infrastruttura AI avvenga in modo sostenibile e accettabile per le comunità locali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!